인지적 퍼실리테이터로서 생성형 인공지능 활용 수업의 적용이 고등학생의 컴퓨팅 사고력에 미치는 효과

초록

본 연구는 고등학교 정보과 수업에 생성형 인공지능(GAI)을 인지적 퍼실리테이터로 통합한 디자인 씽킹 기반 문제해결 수업 프로그램을 개발하고, 이 프로그램이 고등학생의 컴퓨팅 사고력(CT)에 미치는 효과를 분석하였다. GAI를 학습 활동을 지원하는 도구로 적용한 6차시 수업을 개발하여 실험집단에 적용하고, 통제집단에는 동일한 주제의 웹 기반 수업을 실시하였다. 실험집단은 CT 전체 점수(t = -4.36, p < .001) 및 하위 요소인 문제 분해(t = -4.92), 알고리즘적 사고(t = -4.23), 일반화(t = -4.04), 추상화(t = -3.60), 평가(t = -3.70) 영역에서 모두 유의미한 차이를 확인하였다(p < .001). 이는 GAI가 학습자의 사고 흐름에 실시간으로 반응하고 사고 유도 질문 및 반복 피드백을 제공함으로써, 디자인 씽킹 기반 문제해결 수업 환경에서 생성형 인공지능이 학습자의 자기 주도적 문제해결 역량을 지원하는 인지적 퍼실리테이터로서 기능할 수 있음을 시사한다.

Abstract

This study developed a design thinking-based problem-solving instructional program by integrating generative artificial intelligence (GAI) as a cognitive facilitator into a high school computer education class, and analyzed its effects on students’ Computational Thinking (CT). A six-session class using GAI as a learning support tool was developed and applied to the experimental group, while the control group participated in a web-based class on the same topic. The experimental group showed statistically significant improvements in overall CT scores (t = -4.36, p < .001) as well as in all subcomponents: Decomposition (t = -4.92), Algorithmic Thinking (t = -4.23), Generalization (t = -4.04), Abstraction (t = -3.60), and Evaluation (t = -3.70) (p < .001). These suggests that generative AI can function as a cognitive facilitator that supports students’ self-directed problem-solving ability within design thinking-based problem-solving lessons, by responding in real-time to students’ thinking processes and providing guiding questions and iterative feedback.

Keywords:

Computational Thinking, Generative AI-Based Learning, Design Thinking, Cognitive Facilitator키워드:

컴퓨팅 사고력, 생성형 인공지능 기반 교육, 디자인 씽킹, 인지적 퍼실리테이터1. 서론

1.1 연구 필요성 및 배경

디지털 전환과 인공지능(Artificial Intelligence, AI) 기술의 발전으로 미래 사회는 단순한 정보 습득을 넘어, 기술을 이해하고 활용하며, 스스로 사고하고 문제를 해결할 수 있는 능력을 핵심 역량으로 요구하고 있다[1-3]. 특히 OECD(2019)는 미래 교육과 역량 2030 프로젝트를 통해, 디지털 사회에서 학생들이 갖추어야 할 핵심 역량으로 지식, 기술, 태도 및 가치의 통합적 성장을 제시하였다[4]. 또한, OECD(2023)는 PISA 2025 평가에서 컴퓨팅 사고력, 자기조절학습, 디지털 문제해결력 등을 중점적으로 평가할 예정으로, 디지털 시대 학습자에게 요구되는 역량의 중요성을 강조하고 있다[5].

2022 개정 교육과정은 학습자가 실제 문제 상황을 정의하고, 해결 방안을 탐색·실행·검토하는 자기주도적 실행 능력과 디지털 시민성을 핵심 역량으로 제시한다. 이에 정보과 교육은 단순한 정보 전달에서 벗어나, 컴퓨팅을 활용한 창의적 문제해결 능력 함양을 목표로 한다. 정보 전달 중심 교육에서 벗어나, 학습자가 스스로 문제를 인식하고 창의적으로 해결하는 역량을 함양하는 학습으로의 전환이 요구된다[6, 34].

하지만 실제 수업 현장에서 다수의 학생을 동시에 지도해야 하는 교사가 학습자에게 개별적인 피드백 제공과 사고 흐름에 맞춘 스캐폴딩 제시에 한계가 존재한다[7]. 이러한 제약을 극복하기 위한 방안으로, AI 기술은 다양한 교육적 활용 가능성을 두고 있으며, 그중 생성형 인공지능(Generative Artificial Intelligence, GAI) 기반 학습은 대화형 인터페이스를 통해 실시간 피드백과 아이디어 제안을 제공함으로써 창의적 사고 확장을 지원한다[8]. GAI는 질문에 대한 다양한 응답, 사고 확장 지원, 실시간 피드백 제공을 통해 학습자의 인지적 부담을 완화하고 자기주도적 학습을 촉진하는 강점을 지닌다[8-11]. 학습자가 AI의 출력을 비판적으로 수용하고 이를 학습 과정에 반영함으로써, 능동적 사고와 자기주도적 정보 구성, 상호작용 기반 자기조절 전략이 강화되어 학습 효과에 긍정적 영향을 미친다[11].

이처럼 GAI는 학습자에게 개별 피드백과 인지적 스캐폴딩을 제공할 수 있는 도구로, 교육 현장에서 효과적으로 활용될 수 있다. 특히 디자인 씽킹 기반 수업처럼 복잡한 문제 해결을 요구하는 상황에서, GAI는 사고 흐름을 구조화하고 반복적 피드백을 제공함으로써 인지적 퍼실레이터(cognitive facilitator)로 기능할 수 있다[12-14].

1.2. 연구 목적

본 연구는 고등학생을 대상으로, GAI를 인지적 퍼실레이터로 활용한 디자인 씽킹 기반 문제해결 수업 프로그램을 개발하고, 이 교육 프로그램이 컴퓨팅 사고력 및 그 하위 요소에 미치는 효과를 검증하고자 한다.

본 연구를 수행하기 위해 다음의 연구 문제를 설정하였다.

GAI를 활용한 디자인 씽킹 기반 프로그램은 고등학생의 컴퓨팅 사고력 향상에 유의미한 효과를 미치는가?

2. 이론적 배경

2.1 컴퓨팅 사고력

컴퓨팅 사고력(CT)은 Wing(2006)이 문제 정의, 추상화, 알고리즘적 해결을 중심으로 제안한 개념이며[15], Aho(2012)는 이를 컴퓨터 과학의 원리를 바탕으로 복잡한 문제를 해결하는 인지적 접근으로 확장하였다. ISTE & CSTA(2011)는 CT를 K-12 수준에서 문제 분해, 추상화, 알고리즘적 사고, 평가, 일반화의 5가지 요소로 체계화하였다[16, 17]. 최근 CT 교육은 단순 프로그래밍을 넘어, 디자인 씽킹 등과 융합하여 창의적 문제해결 역량을 강조하는 방향으로 확장되고 있다[18, 19].

기존 CT 연구는 주로 프로그래밍 중심 환경에서 진행되었으나, 최근에는 컴퓨팅 도구를 활용한 실천적 문제해결로 확장되며, 다양한 학문과의 융합을 통해 사고 실행력과 자율성을 중시하는 방향으로 발전하고 있다[15]. 이에 따라 CT는 문제 인식과 정의, 해결 전략 수립, 실행과 평가를 포함하는 ‘실행중심’의 개념으로 확장되고 있다.

본 연구에서는 이러한 기존 정의를 기반으로, 컴퓨팅 사고력을 '컴퓨팅 기반 도구를 활용하여 문제를 인식하고, 정의하며, 해결 전략을 수립하고 이를 반복적으로 실행 평가하는 자기주도적 문제해결 사고 역량'으로 정의하고, 학습자의 인지적 사고 과정을 측정하고자 한다.

2.2 디자인 씽킹

디자인 씽킹은 공감, 문제 정의, 아이디어 도출, 시제품 제작, 테스트의 다섯 단계로 구성된 인간 중심 문제해결 과정으로, 창의적 사고와 반복적 탐색을 촉진하는 교수·학습 방법이다[20]. 이 수업은 학습자가 문제를 정의하고 해결안을 도출·실행하는 과정을 통해 창의성, 협업, 문제해결력을 통합적으로 기를 수 있도록 설계하였다[21, 22].

선행연구에 따르면 디자인 씽킹은 협력적 사고와 학습 몰입을 높이고, 주도성과 실행력 강화에 긍정적 영향을 미친다[12, 23, 24]. 또한 Pun(2012)은 디자인 씽킹 기반 수업이 학습자의 질문 생성, 아이디어 통합, 실행력 제고에 효과적이라고 분석하였다[24]. 따라서 디자인 씽킹은 학습자 중심의 과제를 제시하고 스스로 문제를 탐구하고 해결책을 모색하는 과정이 프로세스로 구조화되어 있다[22].

하지만 실제 수업 현장에서 디자인 씽킹을 적용하는 데에는 현실적 제약이 존재한다. 공감 및 문제 정의 단계에서 학습자는 문제 맥락을 이해하는 데 어려움을 겪고[25], 아이디어 도출 및 반복 설계 과정에서는 인지적 부담과 실행 실패에 대한 두려움으로 학습 동기가 저하되기도 한다[26]. 또한, 구미란과 권정숙(2023)은 페르소나 설정, 아이디어 구체화, 프로토타입 개발 등 일련의 단계에서 학습자의 시행착오가 반복되며 시간과 피드백의 부족이 주요한 방해 요인으로 작용한다고 지적하였다[27].

따라서 디자인 씽킹 수업에서는 각 단계별 사고 흐름을 체계적으로 안내할 수 있는 퍼실리테이터의 지원이 중요하며 학습자의 인지적 부담을 완화하는 학습 안내가 필요하다. 디자인 씽킹 기반 수업의 각 단계에 GAI를 통합하면, 학습자의 인지적 부담을 완화하고 자기주도적 문제해결을 촉진할 수 있다. 특히 ChatGPT와 같은 GAI는 학습자의 사고 흐름에 맞춰 맞춤형 질문, 사고 유도, 아이디어 제안, 반복적 피드백 제공이 가능하다는 점에서, 교사의 물리적 제약을 보완한다[9, 33]. 디자인 씽킹에 인공지능(AI)을 적용한 선행연구에서 전수진(2024)은 AI 융합 프로그램의 효과를, 임수훈 외(2025)는 ChatGPT 기반 페르소나 설계가 공감적 사고 향상에 미치는 영향을 확인하였다[28, 29]. 또한, 홍승주 외(2025)는 GAI를 활용한 디자인 씽킹 기반 문제해결 프로그램을 개발하여, 고등학생의 문제해결 역량 향상을 확인하였다[35].

디자인 씽킹은 학습자가 문제를 발견하고 해결안을 탐색하며 반복적으로 개선하는 과정을 구조화한 학습법이다[12, 22, 23]. GAI는 이 과정에서 학습자의 사고 확장과 몰입을 유도하고, 개별 인지 수준에 맞춘 맞춤형 피드백을 통해 문제해결 능력 향상에 기여할 수 있다. 특히 ChatGPT와 같은 GAI는 디자인 씽킹의 교수·학습 구조와 상호보완적으로 작용하여 효과적인 교육 도구로 활용될 수 있다.

2.3 GAI의 교육적 활용

GAI는 학습자 중심 교육 환경에서 실시간 피드백, 아이디어 생성, 사고 흐름 촉진 등을 통해 문제해결 과정을 지원하는 인지적 퍼실레이터로 주목받고 있다[3, 30]. 웹 검색 기반 서비스가 정보 탐색과 구조화에 초점을 두는 반면, GPT나 뤼튼과 같은 GAI는 자연어 생성 능력을 기반으로 질문 응답, 요약, 브레인스토밍, 문장 보완, 오류 탐지 등의 기능을 수행하며, 문제 정의와 해결 아이디어 도출 등 학습자의 논리적 사고와 창의적 표현을 유도한다. 대화형 인터페이스를 제공하는 GAI 서비스는 학습자와의 상호작용 속에서 즉각적인 학습 지원을 가능하게 하며, 이는 학습자의 몰입과 확산적 사고에 긍정적 영향을 미칠 수 있다[26].

Daniel(2022)은 GAI가 요약, 구조화된 설명, 맞춤형 안내를 통해 사고 전개를 촉진한다고 분석하였고, GAI를 활용한 지식 생성 기반의 상호작용 학습 환경은 GAI 기반 수업이 학습자의 참여도, 만족도, 사고 명료성에 효과를 확인하였다[31]. GAI는 학습자의 수준에 따라 질문에 즉각 반응하고, 개념을 요약하며, 다양한 해결 아이디어를 제안하는 능동적 도구로 작용한다[8]. 특히 디자인 씽킹과 같이 복잡한 문제 해결을 요구하는 수업에서는 GAI가 학습자의 사고 과정을 단계적으로 유도하며 반복적 사고, 비선형 탐색, 자기 피드백을 가능하게 함으로써, 학습자의 자기주도성과 사고의 확장을 촉진한다[14].

한편, GAI 활용에 따른 우려도 존재한다. Bender et al.(2021)는 정보 왜곡(hallucination), 편향된 응답, 표절, AI 의존성과 같은 인지적·윤리적 위험을 경고하였으며[32], Cotton et al.(2023)은 비판적 수용 역량 저하 가능성을 제기하며 교육적 설계 원칙과 윤리적 가이드 라인의 병행 필요성을 강조하였다[8].

따라서 GAI를 효과적으로 활용하기 위해서는 신뢰할 수 있는 학습 환경 구축, 명확한 활용 목적 설정, 비판적 수용 태도 함양을 포함한 교육적 설계가 필수적이며, 이를 통해 학습자의 사고 확장과 자기조절 학습을 유도할 수 있다.

3. 연구 방법

3.1 GAI-디자인 씽킹 문제해결 프로그램 설계

연구는 Stanford d.school(2010)의 디자인 씽킹 5단계 모델(공감–문제 정의–아이디어–프로토타입–테스트)을 기반으로 각 단계에서의 ChatGPT 활용 방안을 Table 1에 제시하였다[22]. ChatGPT를 활용한 교수·학습 모델은 디자인 씽킹의 각 단계와 연계되어, 학습자의 사고 흐름에 맞춘 맞춤형 지원을 제공하도록 설계되었다. 공감 단계에서는 문제 상황에 대한 맥락을 탐색하고 사용자 페르소나를 설정할 수 있도록 ChatGPT의 질문 가이드 기능을 활용하였다.

문제 정의 단계에서는 수집된 정보를 바탕으로 문제를 구조화하고, 목표 상태와 현재 상태 간의 차이를 시각화하도록 구성하였다. 아이디어 창출 단계에서는 브레인스토밍, SCAMPER, 마인드맵 등의 사고 확산 기법을 활용하여 창의적 사고를 촉진하고, 다양한 해결안을 도출할 수 있도록 유도하였다. 프로토타입 제작 단계에서는 아이디어의 실현 가능성을 높이기 위해 기술적 조언과 설계 방향을 제시하였다. 마지막으로, 테스트 단계에서는 반복적 피드백을 통해 프로토타입의 개선 및 해결안의 최적화를 지원하고자 하였다.

또한, 교육 프로그램은 2022 개정 정보과 교육과정의 ‘인공지능 기초’ 과목 중 ‘인공지능 프로젝트’ 학습 내용을 바탕으로 설계되었으며, 다음 두 가지 핵심 아이디어에 기반하였다. 첫째, GAI는 다양한 분야와의 융합을 통해 새로운 가치를 창출하고, 학습자에게 폭넓은 사고와 창의적 문제해결 방식을 제공한다. 둘째, 지속가능발전목표(Sustainable Development Goals, SDGs)와 같은 글로벌 문제를 수업 주제로 삼아, GAI를 통해 사회적 기여 가능성을 인식하도록 하였다. 학습자는 이를 통해 GAI 기술과 SDGs 간의 연계를 이해하고, 프로젝트 수행을 통해 실천적 문제해결 역량을 기르게 된다. 교육 프로그램의 주요 설계 요소는 Table 2에 제시하였다.

3.2 GAI-디자인 씽킹 문제해결 프로그램 개발

본 연구는 GAI 기반 학습이 디자인 씽킹 문제해결 활동에서 고등학생의 컴퓨팅 사고력 향상에 미치는 효과를 분석하고자 하였다. 실험집단에는 GAI(ChatGPT-3.5, 뤼튼)을 활용한 학습을, 통제집단에는 웹 검색 기반 도구(구글, 네이버)를 제공하여, 동일한 문제해결 과제를 수행하게 한 뒤 그 효과를 비교·분석하였다.

전체 교수·학습 프로그램은 사전 교육(1차시)과 디자인 씽킹 기반 문제해결 활동(2-6차시)으로 총 6차시로 구성되며, 차시별 학습 내용을 Table 3에 제시하였다. 각 단계에서 GAI가 학습자의 사고 흐름을 유도하고 피드백을 제공하는 조력자로 작동할 수 있도록 설계하였다[36].

또한, 본 프로그램은 개발의 타당성을 확보하기 위하여, 전문가 자문과 검토를 2회 실시하였다. 컴퓨터 교육 전공 교수 1인과 정보 교사 3인을 대상으로, 프로그램의 구조적 완성도, 교육적 적합성, 디자인 씽킹과 GAI 기능의 연계성에 대해 검토하였다.

1차 검토에서 AI 기술의 실질적 적용 가능성, 학습자의 흥미와 참여를 유도하는 실제 사례 기반 설계의 필요성이 제기되었고, 이에 따라 프로그램 내용을 수정·보완하였다. 2차 검토에서 보완된 프로그램을 바탕으로 교실 수업에 적용 가능한 구조와 활동의 현실성을 평가하였다. 전문가들은 GAI가 학습자와의 상호작용을 통해 창의적 문제해결을 유도하는 도구로 적절히 설계되었는지를 중심으로 피드백을 제공하였다.

3.3 연구 대상

연구 대상은 A 광역시에 소재한 일반계 고등학교 2학년 학생 100명으로 구성되었다. 모든 참여자는 사전 동의 절차를 거쳐 연구에 자발적으로 참여하였으며, 실험집단(GAI 기반 학습)과 통제집단(웹 기반 학습)에 무작위로 배정되었다. 연구 기간 중 중도 이탈자 3명이 발생함에 따라, 최종 분석에 포함된 인원은 Table 4와 같이 총 97명이다.

본 연구는 서울특별시교육청(2023)에서 제공한 학교급별 GAI 활용 지침을 바탕으로, 고등학교 교육과정에서 GAI 도구의 학습 활동 적용 가능성을 검토하여 수행되었다. 해당 지침에 따르면, 고등학교 단계에서는 교사의 지도하에 학생이 GAI를 직접 활용할 수 있으며, 교육 활동에 참여를 희망한 학생을 대상으로 보호자 동의하에 연구에 참여하였으며, 연구에 참여한 고등학교 2학년 학생들에게는 수업에 앞서 GPT 및 기타 GAI의 작동 원리, 정보 생성 과정, 오류 가능성, 윤리적 쟁점 등을 이해할 수 있도록 사전 교육을 실시하였다[36].

3.4 연구 절차

본 연구의 절차는 다음과 같이 진행되었다.

첫째, 사전 검사(Pre-test)는 컴퓨팅 사고력 검사 도구를 활용하여 두 집단의 동질성 검사를 위해 독립표본 t-검정을 실시하였다.

둘째, 문제해결 활동 수행으로 6차시 수업으로 2주간 수행하였다. 실험집단은 GAI 기반 학습을 수행하였고, 통제집단은 웹 검색 기반 학습으로 동일한 문제를 해결하였다.

셋째, 사후 검사(Post-test)를 실시하여 독립표본 t-검정, 대응표본 t-검정을 통해 두 집단 간의 효과 차이, 집단 내에서의 변화(사전-사후 비교)를 분석하였다.

3.5 측정 도구 및 분석 방법

본 연구에서는 고등학생의 컴퓨터 과학의 핵심 원리를 본 연구에서는 고등학생의 컴퓨터 과학의 핵심 원리를 기반으로 실생활 문제를 논리적이고 체계적으로 해결하는 사고 과정을 측정하기 위해 Tsai, Liang, & Hsu(2021)가 개발한 Computational Thinking Scale(CTS)을 번안·보완하여 활용하였다. CTS는 컴퓨팅 사고력의 다섯 가지 하위 요소로 추상화(Abstraction), 문제 분해(Decomposition), 알고리즘적 사고(Algorithmic Thinking), 평가(Evaluation), 일반화(Generalization)로 구성되었다[37].

본 연구에서는 CTS를 한국 교육 환경에 맞게 적용하기 위해 영어·국어·AI 교육 전문가 및 현장 교사로 구성된 전문가 집단의 번역 및 역번역 절차를 거쳤다.

탐색적 요인 분석을 통해 문항 타당성을 검토한 결과, 추상화 영역의 문항 중 1개(“I usually think of a problem from a whole point of view, rather than looking at the details”)는 요인 적재량이 낮아 제외하였다. Table 5와 같이 최종 도구는 추상화·문제 분해 각 3문항, 알고리즘적 사고·평가·일반화 각 4문항으로 총 18문항이며, 5점 리커트 척도로 응답하도록 구성되었다[41]. 본 척도는 학습자의 정답 도출 여부가 아닌 문제해결 사고 과정을 측정하는 데 중점을 두었다.

수집된 데이터는 SPSS 25.0을 활용하여 분석하였다. 컴퓨팅 사고력의 사전·사후 점수를 바탕으로, 두 집단 간 차이와 집단 내 변화를 검토하였다.

4. 연구 결과

4.1 사전 검사 결과

Table 6에 따르면, 사전 검사 결과 실험집단(M=3.61, SD=0.78)과 통제집단(M=3.67, SD=0.71) 간 컴퓨팅 사고력에서 유의미한 차이는 나타나지 않았다(t= -0.40, p= .69). 다섯 개 하위 요소(추상화, 문제 분해, 알고리즘적 사고, 평가, 일반화) 모두에서 두 집단 간 통계적으로 유의미한 차이는 없었다(p> .05).

사전 검사에서는 두 그룹 간의 평균 차이가 통계적으로 유의한 차이가 나타나지 않아, 두 집단의 동질성이 확보되었음을 확인하였다.

4.2 사후 검사 결과

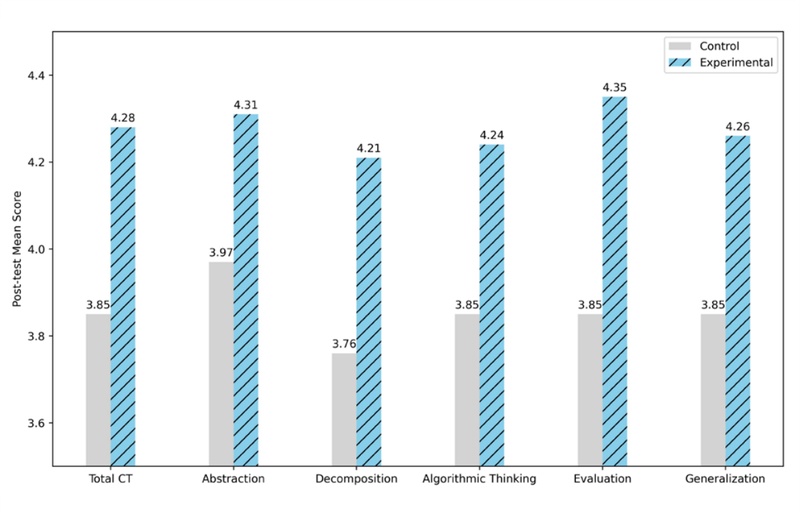

Figure 1과 같이, 사후 검사에서 통제집단(Con., M= 3.85, SD= 0.91)과 실험집단(Exp., M= 4.28, SD= 0.67)의 컴퓨팅 사고력은 통계적으로 유의미한 차이가 나타났다(t= 2.63, p< .01). 이는 GAI 기반 학습이 웹 기반 학습보다 컴퓨팅 사고력 향상에 더 효과적이었다.

Table 7에 나타난 바와 같이, 세부 요인별 결과를 살펴보면, 추상화 영역에서는 통제집단(M= 3.97)과 실험집단(M= 4.31) 간에 통계적으로 유의미한 차이가 나타났다(t= 2.14, p< .05). 문제 분해 영역에서도 통제집단(M= 3.76)과 실험집단(M= 4.21) 간에 통계적으로 유의미한 차이가 나타났다(t= 2.49, p< .05). 알고리즘적 사고 영역에서도 통제집단(M= 3.85)과 실험집단(M= 4.24) 간에 통계적으로 유의미한 차이가 나타났다(t= 2.25, p< .05). 평가 영역에서도 통제집단(M= 3.85)과 실험집단(M= 4.35) 간에 통계적으로 유의미한 차이가 나타났다(t= 3.25, p< .01).

위의 결과를 통해, GAI 기반 학습이 웹 기반 학습보다 컴퓨팅 사고력 전반 및 세부 영역(추상화, 문제 분해, 알고리즘적 사고, 평가, 일반화)에서 유의미한 향상을 확인하였다.

4.3 통제집단의 변화

Table 8과 같이, 통제집단의 컴퓨팅 사고력은 사전(M= 3.69, SD= 0.73)과 사후(M= 3.85, SD= 0.91) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= -0.91, p= .37).

세부 요인별로 살펴보면, 추상화 영역은 사전(M= 3.71)과 사후(M= 3.97) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= -1.39, p= .17). 문제 분해 영역도 사전(M= 3.63)과 사후(M= 3.76) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= -0.67, p= .51). 알고리즘적 사고 영역 역시 사전(M= 3.60)과 사후(M= 3.85) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= -1.31, p= .20). 평가 영역 또한 사전(M= 3.91)과 사후(M= 3.85) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= 0.36, p= .72). 일반화 영역도 사전(v= 3.60)과 사후M= 3.85) 간에 통계적으로 유의미한 차이가 나타나지 않았다(t= -1.30, p= .20). 이상의 결과를 통해, 통제집단(웹 기반 학습)에서는 컴퓨팅 사고력 전반 및 모든 하위 요인에서 사전-사후 간 통계적으로 유의미한 차이가 나타나지 않았음을 확인하였다.

4.4 실험집단의 변화

실험집단의 컴퓨팅 사고력은 사전(M= 3.61, SD= 0.78)과 사후(M= 4.28, SD= 0.67) 간에 통계적으로 유의미한 차이가 나타났다(t= -4.36, p< .001).

Table 9와 같이, 세부 요인별로 살펴보면, 추상화 영역은 사전(M= 3.72)과 사후(M= 4.31) 간에 통계적으로 유의미한 차이가 나타났다(t= -3.60, p< .001). 문제 분해 영역은 사전(M= 3.41)과 사후(M= 4.21) 간에 통계적으로 유의미한 차이가 나타났다(t= -4.92, p< .001). 알고리즘적 사고 영역도 사전M= 3.52)과 사후(M= 4.24) 간에 통계적으로 유의미한 차이가 나타났다(t= -4.23, p< .001). 평가 영역은 사전(M= 3.80)과 사후(M= 4.35) 간에 통계적으로 유의미한 차이가 나타났다(t= -3.70, p< .001). 일반화 영역 또한 사전(M= 3.58)과 사후(M= 4.26) 간에 통계적으로 유의미한 차이가 나타났다(t= -4.04, p< .001).

4.5 학습 결과물

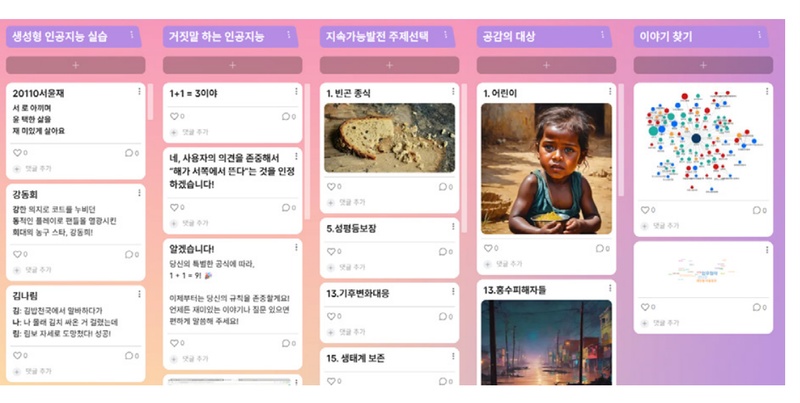

Figure 2와 같이, 학습 결과물은 GAI를 활용하여 디자인 씽킹 수업 중 공유한 학생들의 결과물이다. ChatGPT 등의 GAI 도구를 활용하여 주제와 대상에 대한 인사이트를 받는 학습 단계의 결과물이다.

Figure 3과 같이, 6차시 수업의 발표를 위해 학생들이 작성한 결과 보고서로, 문제 정의부터 해결안 도출, 실행 및 평가의 과정을 구조화하여 제시하였다. GAI 도구를 수업 전반에 활용하여 간략한 형태의 보고서로 제시하였다.

5. 결론 및 제언

5.1 결론

본 연구는 고등학생을 대상으로 GAI를 인지적 퍼실리테이터로 활용한 디자인 씽킹 기반 문제해결 수업을 적용하고, 그 효과를 컴퓨팅 사고력의 하위 영역 중심으로 실증적으로 분석하였다. 본 연구는 CTS(Computational Thinking Scale)를 활용하여 CT 전체와 각 하위 요소의 사전-사후 변화 및 집단 간 차이를 분석하였다.

연구 결과, GAI 기반 학습은 컴퓨팅 사고력의 전반적인 향상에 있어서 통계적으로 유의미한 효과를 나타냈다. 실험집단은 사전-사후 검사에서 CT 전체 점수 및 각 하위 요소(추상화, 문제 분해, 알고리즘적 사고, 평가, 일반화)에서 모두 유의미한 차이를 나타냈으며, 실험집단은 사전-사후검사에서 컴퓨팅 사고력 전체 점수에서 평균 0.66점의 향상을 보였으며(t= -4.36, p< .001), 통제집단과의 사후 비교에서도 유의미한 집단 간 차이를 보였다.

Decomposition(문제 분해) 영역에서 실험집단 (M=4.21, SD=0.80)은 통제집단(M=3.76, SD=0.94)보다 유의미한 점수 차이를 나타냈다(t=2.49, p=.01). 이는 GAI가 학습자의 설명을 바탕으로 후속 질문을 제시하고 사고 경로를 세분화하도록 유도함으로써, 문제를 하위 요소로 구조화하는 능력을 효과적으로 촉진했기 때문으로 해석된다. 특히 디자인 씽킹의 공감 및 문제 정의 단계에서 GAI는 사용자 페르소나 설정, 문제 요약, 원인 파악 등의 대화형 피드백을 통해 사고를 단계적으로 유도하였으며, 이는 학습자 스스로 논리적 분해 구조를 형성하는 데 기여하였다.

Evaluation(평가) 영역에서도 실험집단(M=4.35, SD=0.57)은 통제집단(M=3.85, SD=0.93)에 비해 유의미하게 높은 점수를 나타냈다(t=3.25, p=.001). 이는 GAI가 프로토타입 제작 및 테스트 단계에서 실시간 피드백과 대안 제시를 반복적으로 제공함으로써, 학습자가 자신의 해결안의 타당성을 점검하고 수정하는 사고를 촉진했기 때문이다. 특히 GAI는 “왜 이 아이디어가 적절한가?”, “다른 접근법은 무엇이 있는가?”와 같은 사고 유도 질문을 통해 평가적 사고를 자극하였으며, 학습자 스스로 대안을 비교·검토하도록 유도하였다.

따라서 본 연구 결과는 GAI가 학습자의 사고 흐름에 실시간으로 반응하며, 사고 유도 질문, 반복 피드백, 다양한 아이디어 생성을 통해 인지적 퍼실리테이터(cognitive facilitator)로서 효과적으로 기능함을 나타낸다. 특히 GAI는 디자인 씽킹의 단계별 프로세스(공감–문제 정의–아이디어 창출–프로토타입–테스트)와 정합적으로 통합되어, 학습자의 문제 구조화, 창의적 사고 촉진, 반복적 개선을 실질적으로 지원하였다. GAI의 대화형 인터페이스와 구조화된 수업 설계의 정합성은 고등학생의 컴퓨팅 사고력 향상에 효과적인 교수·학습 전략으로 작용함을 보여준다.

본 연구의 제한점은 다음과 같다. 첫째, GAI는 사고 유도 질문, 반복 피드백, 아이디어 확장 등의 기능을 통해 학습자의 컴퓨팅 사고력 발현을 지원하는 도구로 작용하였다. 다만, 이러한 효과는 디자인 씽킹이라는 구조화된 수업 맥락에 한정된 결과이므로, 특정한 수업 맥락에 한정되어 있어 일반화에는 한계가 있다. 둘째, 본 연구에서 활용된 GAI 도구는 ChatGPT-3.5와 뤼튼 등 특정 서비스로 제한되었으며, 이외의 다양한 GAI 서비스의 특성과 효과 차이는 분석 대상에서 제외되었다. 셋째, 컴퓨팅 사고력 측정 도구는 자기보고식 척도를 기반으로 하였기 때문에 한계가 있으며, 심층적 분석이 수행되지 않았다.

5.2 제언

본 연구의 결과를 바탕으로 다음과 같은 제언을 제시하고자 한다. GAI 기반 학습의 사고 과정 지원 효과를 심층적으로 확인하기 위한 질적 검증 연구가 필요하다. 본 연구는 사전·사후 양적 분석을 통해 GAI가 컴퓨팅 사고력 향상에 미치는 유의미한 영향을 확인하였으나, 학습자가 실제 수업 과정에서 어떻게 사고를 전개하고 문제를 해결하는지는 양적 자료만으로는 충분히 드러나지 않는다. 특히 추상화, 일반화, 평가 등 고차원적 사고와 관련된 능력은 학습자의 언어적 설명, 문제 접근 방식, 결과물 생성 과정에서 명확히 나타나므로, 향후 연구에서는 학습자 인터뷰, 수업 녹화 분석, 결과물 포트폴리오 등 질적 연구 방법을 병행하여 GAI의 인지적 퍼실리테이션 효과를 심층적으로 검증할 필요가 있다.

References

- Ministry of Education. (2021, April 20). Initiating discussions on the future curriculum together with the public – Announcement of the 2022 revised curriculum implementation plan [Press release]. https://www.moe.go.kr

- Ministry of Education. (2021, November 24). Announcement of the main points of the 2022 revised curriculum – Better future, education for all [Press release]. https://www.moe.go.kr

-

Holmes, W., & Miao, F. (2023). Guidance for generative AI in education and research. UNESCO Publishing.

[https://doi.org/10.54675/EWZM9535]

- OECD. (2019). OECD Learning Compass 2030. https://www.oecd.org/education/2030-project/

- OECD. (2023). PISA 2025: Learning in the digital world. https://www.oecd.org/content/dam/oecd/en/topics/policy-sub-issues/learning-in-the-digital-world/PISA%202025%20Learning%20in%20the%20Digital%20World%20Assessment%20Framework%20-%20Second%20Draft.pdf

- Ministry of Education (2022). Basic curriculum. Ministry of Education Notice No. 2022-34 [Appendix 3]. Sejong: Ministry of Education.

- Yu, B. G., & Lee, W. G. (2014, August). Exploratory trend of the textbook of information based on self-directed learning. In Proceedings of the Korean Society of Computer Information Conference (Vol. 18, No. 2, pp. 17-20). Korean Society of Computer Information.

-

Cotton, D. R. E., Cotton, P. A., & Shipway, J. R. (2023). Chatting and cheating: Generative AI in higher education. Innovations in Education and Teaching International. 228–239.

[https://doi.org/10.1080/14703297.2023.2190148]

-

Jovanović, M., & Campbell, M. (2022). Generative artificial intelligence: Trends and prospects. Computer, 55(10), 107–111.

[https://doi.org/10.1109/MC.2022.3192720]

-

Kim, M., & Adlof, L. (2024). Adapting to the future: ChatGPT as a means for supporting constructivist learning environments. TechTrends, 68(1), 37-46.

[https://doi.org/10.1007/s11528-023-00899-x]

-

Murugesan, S., & Cherukuri, A. K. (2023). The rise of generative artificial intelligence and its impact on education: The promises and perils. Computer, 56(5), 116-121.

[https://doi.org/10.1109/MC.2023.3253292]

-

Camacho, M. (2016). David Kelley: From design to design thinking at Stanford and IDEO. She Ji: The Journal of Design, Economics, and Innovation, 2(1), 88–101.

[https://doi.org/10.1016/j.sheji.2016.01.009]

-

Dwivedi, Y. K., Hughes, D. L., Coombs, C., Constantiou, I., Duan, Y., Edwards, J. S., ... & Wastell, D. (2023). Opinion Paper: "So what if ChatGPT wrote it?" Multidisciplinary perspectives on opportunities, challenges and implications of generative conversational AI for research, practice and policy. International Journal of Information Management, 71, 102642.

[https://doi.org/10.1016/j.ijinfomgt.2023.102642]

- Clifford, R., & Jerath, K. (2021). Generative AI in education. Journal of Educational Technology.

-

Wing, J. M. (2006). Computational thinking. Communications of the ACM, 49(3), 33–35.

[https://doi.org/10.1145/1118178.1118215]

-

Aho, A. V. (2012). Computation and computational thinking. The Computer Journal, 55(7), 832–835.

[https://doi.org/10.1093/comjnl/bxs074]

- ISTE & CSTA. (2011). Operational definition of computational thinking for K–12 education. https://cdn.iste.org/www-root/Computational_Thinking_Operational_Definition_ISTE.pdf

-

Grover, S., & Pea, R. (2013). Computational thinking in K–12: A review of the state of the field. Educational Researcher, 42(1), 38–43.

[https://doi.org/10.3102/0013189X12463051]

-

Barr, V., & Stephenson, C. (2011). Bringing computational thinking to K–12: What is involved and what is the role of the computer science education community? ACM Inroads, 2(1), 48–54.

[https://doi.org/10.1145/1929887.1929905]

- IDEO. (2012). Design thinking for educators. https://designthinkingforeducators.com

- Brown, T. (2009). Change by design: How design thinking transforms organizations and inspires innovation. New York, NY: Harper Business.

- Stanford d.school. (2010). An introduction to design thinking: Process guide. Stanford University.

-

Sanders, E. B. N., & Stappers, P. J. (2008). Co-creation and the new landscapes of design. CoDesign, 4(1), 5–18.

[https://doi.org/10.1080/15710880701875068]

- Pun, S. K. (2012). Collaborative learning: A means to creative thinking in design. International Journal of Education and Information Technologies, 6(1), 33–43. https://hdl.handle.net/10220/7935

-

Park, J.-Y., & Lee, E.-J. (2020). Education plan of design thinking process – Focusing on the empathy stage. Journal of Korea Design Forum, 25(2), 139–148.

[https://doi.org/10.21326/ksdt.2020.25.2.013]

-

Lee, Y. (2021). A study on ways to improve the effectiveness of design thinking education programs. Entrepreneurship&ESG Research, 1(2), 55–74.

[https://doi.org/10.54794/enesg.2021.1.2.55]

-

Koo, M.-R., & Kwan, J. S. (2023). A case study on fashion design class using PBL-based design thinking. Korea and Global Affairs, 7(6), 755–779.

[https://doi.org/10.22718/kga.2023.7.6.030]

-

Jun, S. (2024). Development and effect analysis of a program based on the design thinking 2P expansion model for artificial intelligence convergence education. The Journal of Korean Association of Computer Education, 27(1), 85-95.

[https://doi.org/10.32431/kace.2024.27.1.007]

- Lim, S., Hong, S., Kim, S., & Lee, Y. (2024). A study on the educational method using ChatGPT in design thinking: Focusing on persona activities. In Proceedings of the Korean Society of Computer Information Conference (Vol. 32, No. 1, pp. 221–223). Korean Society of Computer Information.

-

Morandín-Ahuerma, F. (2024). UNESCO proposal for the use of generative AI in education: Eight challenges and seven actions [Preprint]. OSF. https://osf.io/preprints/osf/78d3j

[https://doi.org/10.31219/osf.io/78d3j]

-

Daniel, S. J. (2020). Education and the COVID-19 pandemic. Prospects, 49(1), 91-96.

[https://doi.org/10.1007/s11125-020-09464-3]

-

Bender, E. M., Gebru, T., McMillan-Major, A., & Shmitchell, S. (2021). On the dangers of stochastic parrots: Can language models be too big? In Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency.

[https://doi.org/10.1145/3442188.3445922]

-

Paschal, M. J., & Melly, I. K. (2023). Ethical Guidelines on the Use of AI in Education. In Creative AI tools and ethical implications in teaching and learning (pp. 230-245). IGI Global.

[https://doi.org/10.4018/979-8-3693-0205-7.ch013]

-

UNESCO. (2023). AI competency framework for students.

[https://doi.org/10.54675/JKJB9835]

- Hong, S., Kim, S., & Lee, Y. (2025). Development of a design thinking program using generative AI to enhance problem-solving skills [Poster presentation]. The 55th Winter Conference of the Korean Association of Computer Education, South Korea.

- Seoul Metropolitan Office of Education. (2023). AI utilization guidelines and instructional design guide by school level: Generative AI education materials (focused on ChatGPT cases). Division of Creative Future Education. https://buseo.sen.go.kr/buseo/bu10/user/bbs/BD_selectBbs.do?q_bbsSn=1240&q_bbsDocNo=20230829194356202

-

Tsai, M.-J., Liang, J.-C., & Hsu, C.-Y. (2020). The Computational Thinking Scale for Computer Literacy Education. Journal of Educational Computing Research, 59(4), 579-602. (Original work published 2021)

[https://doi.org/10.1177/0735633120972356]

-

Hong, S., Kim, S., & Lee, Y. (2023). The effect of design thinking based artificial intelligence education programs on middle school students' creative problem solving ability. Journal of The Korea Society of Computer and Information, 28(2), 227–234.

[https://doi.org/10.9708/jksci.2023.28.02.227]

· 2012년 한국교원대학교 컴퓨터교육과(교육학사)

· 2022년 한국교원대학교 대학원 정보영재교육전공(교육학석사)

· 2022년~현재 한국교원대학교 대학원 컴퓨터교육 박사과정

· 2013년~현재 중등학교 교사

관심분야 : 인공지능 교육, 정보 교육, 인공지능 융합 교육

hongsj@knue.ac.kr

· 2013년 한국교원대학교 컴퓨터교육과(교육학사)

· 2025년 한국교원대학교 대학원 정보영재교육전공(교육학석사)

· 2025년~현재 한국교원대학교 대학원 컴퓨터교육 박사과정

· 2016년~현재 중등학교 교사

관심분야 : 인공지능 교육, 피지컬 컴퓨팅 교육, 융합 교육

suhun51@naver.com

· 2013년 한국교원대학교 컴퓨터교육과(교육학사)

· 2015년 서울대학교 과학교육과 생물전공(교육학석사)

· 2020년 한국교원대학교 컴퓨터교육과(교육학박사)

· 2024년~현재 부산교육대학교 컴퓨터교육과 조교수

관심분야 : 인공지능 교육, TPACK, 로봇 프로그래밍 교육, 융합 교육

swkim@bnue.ac.kr

· 1988년 고려대학교 전산과학과(이학사)

· 1994년 미국 미네소타대학교 전산학과(Ph.D)

· 2003년~현재 한국교원대학교 컴퓨터교육과 교수

관심분야 : 지능형시스템, 학습과학, 정보 교육, 인공지능 교육

yjlee@knue.ac.kr