디지털 기반 학습 매체의 효과성 분석을 위한 인지 기반 학습 프레임워크 및 평가 척도 연구

초록

최근 에듀테크 기술의 발달과 함께 디지털 교과서를 포함한 다양한 디지털 도구가 교육 현장에 도입되었으나, 이론적 기반과 효과성 평가 도구의 제시가 부족하다는 사회적 우려가 있다. 본 연구에서는 디지털 기반 학습 매체의 효과성을 구조적으로 해석하고, 학습자의 인지 활동 변화 양상을 측정할 수 있는 프레임워크와 평가 척도를 연구하였다. 본 연구의 프레임워크는 전통적인 인지 학습 이론과 디지털 학습 환경의 특성을 통합하여, 교수 전략, 학습 전략, 자기조절 과정, 지식 획득 과정을 설명하는 이론적 구조를 제공하며 이를 바탕으로 개발된 평가 척도는 디지털 기반 학습 매체의 설계에 내포된 인지과학적 원리의 구현 정도를 평가함으로써 디지털 기반 학습 매체의 효과성을 진단하는 기준을 제공한다. 본 연구의 제한점은 예비 척도 개발 연구로서, 추후 델파이 검증 및 구인 타당도와 신뢰도 검증을 위한 후속 연구가 필요하다.

Abstract

Despite the recent proliferation of educational technologies, there remains a lack of theoretical foundations and metrics for analyzing their effectiveness. In response, this study establishes a framework to structurally interpret the effectiveness of digital media and develops preliminary metrics to measure changes in learners' cognitive activities. This framework integrates traditional cognitive learning theories with the characteristics of digital learning environments, explaining the relationships among instructional strategies, learning strategies, self-regulated learning, and knowledge acquisition. Furthermore, the evaluation metrics derived from this framework provide a systematic standard for diagnosing effectiveness by assessing the degree to which cognitive science principles are implemented in design. As a preliminary scale development, further research is required for Delphi validation and to examine construct validity and reliability.

Keywords:

digital learning media, cognitive learning, visual framework, evaluation metrics development, AI-based digital textbooks, integration of traditional cognitive theory and digital learning키워드:

디지털 기반 학습 매체, 인지 기반 학습, 시각적 프레임워크, 평가 척도 개발, 인공지능 기반 디지털 교과서, 전통적 인지 학습 이론과 디지털 학습 방법 통합1. 서론

1.1 연구의 배경과 필요성

디지털 기술과 인공지능의 급격한 발전은 교육 현장의 학습 환경에 혁신적 변화를 가져왔으며, 인공지능 기반 디지털 교과서와 같은 디지털 기반 학습 매체는 학습자의 반응과 행동 데이터를 기반으로 맞춤형 학습을 제공할 수 있는 가능성을 지니고 있어 학교 현장의 관심도 증가하고 있다. 그러나 충분한 이론적 검토나 교육적 준비 없이 기술이 도입될 경우, 학습 효과를 저해할 수 있다는 사회적 염려가 존재하며 기술의 단순한 도입이 직접적인 학습 효과로 이어진다고 보기는 어렵다[1]. 다수의 선행 연구에서는 에듀테크가 지닌 잠재력은 인정하면서도, 실제 학습 성과는 교사의 교수 전략, 학습자의 인지적 활동, 학습 맥락 등 다양한 요인과의 상호작용에 따라 결정된다고 본다[2, 3].

최근 한국교육학술정보원에서 제시한 『AI 디지털교과서 개발 가이드라인』은 디지털 기반 학습 매체의 피드백 기능을 다채롭게 제안하고 있다[4]. 그러나 현행 가이드라인은 Sedrakyan[5]이 제시한 학습 과학 기반 피드백 이론과 비교할 때 구조적 연계성과 이론적 정합성 측면에서 보완이 필요하다. 예를 들어, 가이드라인에서는 학습자의 정오 여부에 따른 정답 확인, 긍정적·부정적 피드백 제공, 보상 기능 등의 요소는 포함되어 있으나, 이러한 피드백이 학습자의 자기조절 학습 단계(계획-실행-모니터링-적응)와 어떻게 연계되어야 하는지에 대한 설명은 충분히 제시되지 않는다. Sedrakyan[5]의 이론에서 강조하는 인지적 피드백(예: 학습 내용의 이해를 돕는 설명 중심 피드백)과 행동적 피드백(목표 달성 정도에 대한 진행 안내)의 구분, 피드백의 적시성과 반복적 수정 가능성 등의 원칙 역시 현행 가이드라인에서는 명시적으로 제시되어 있지 않다.

가이드라인과 학습 기반 피드백 이론의 차이는 디지털 기반 학습 매체의 설계와 실제 교수·학습 상황 간의 이론적 간극을 초래할 수 있으며, 인공지능 기반 교수전략의 효과를 이론적으로 분석하고 설계적 측면에서 보완할 수 있는 인지 기반 프레임워크의 필요성을 시사한다[5].

디지털 기반 학습 매체의 효과성을 평가하려면 단순한 학업 성취 결과가 아니라 학습 과정에서 발생하는 인지적, 메타인지적 활동을 분석할 필요가 있으며[6], 이를 가능하게 하는 이론적 프레임워크가 필요하다. Reinhold[7]은 전통적인 인지 학습이론과 디지털 학습 환경을 연결하는 모델이 부재한 상황에서, 학습 메커니즘을 설명할 수 있는 통합적인 이론적 모델이 요구된다고 보았다. Azevedo[8]는 학습자의 사고나 인지 과정은 외현화되지 않기 때문에 그 효과를 진단하려면 인지 활동을 구조화하고 관찰 가능한 지표로 전환할 수 있는 평가 척도를 개발해야 한다고 지적하였다. 이에 본 연구는 프레임워크에 기반하여 학습자의 인지적 활동을 분석할 수 있는 평가 척도를 함께 연구하였으며, 이를 통해 디지털 기반 학습의 효과성을 실증적으로 진단하고, 향후 교수·학습 전략을 정교화할 수 있는 실천적 도구를 제안하고자 한다.

1.2 연구 목적과 질문

본 연구의 목적은 인공지능 기반 디지털 교과서를 포함한 디지털 기반 학습 매체의 효과성을 분석하기 위해 인지 기반 학습 프레임워크를 개발하고, 이를 이론적으로 정립하는 동시에 해당 프레임워크에 근거한 평가 척도를 개발하는 데에 있다. 제안된 프레임워크와 평가 척도는 학습자의 인지 및 메타인지 과정에 영향을 미치는 교수·학습 전략 간의 관계를 구조화하고, 디지털 학습 환경에서의 효과성을 이론적으로 설명하고 실천적으로 진단할 수 있는 기반을 제공한다. 이를 바탕으로 다음과 같은 연구 질문을 설정하였다:

RQ1) 디지털 기반 학습 매체의 교수·학습전략은 학습자의 인지 과정에 어떻게 영향을 미치는가?

RQ2) 디지털 기반 학습 매체를 사용하는 환경에서 학습자의 학습 효과성을 진단하기 위한 인지 기반 평가 척도는 어떻게 구성할 수 있는가?

RQ3) 본 연구의 인지 기반 프레임워크와는 실제 교육 현장에서 어떻게 적용될 수 있으며, 이에 기반한 평가 척도는 디지털 기반 학습 매체 학습의 효과를 어떻게 진단할 수 있는가?

2. 이론적 배경

2.1 디지털 기반 학습 매체와 교수·학습 전략

Reinhold[7]은 디지털 기반 학습 매체에 포함된 교수적 기능들(예: 적응형 피드백, 문제 제시, 시뮬레이션 등)이 학습자의 인지적 참여를 유도하며, 단순한 정보 전달을 넘어선 교육적 기능을 수행한다고 보았다. 이러한 전략들은 교사의 수업 설계에 따라 유연하게 조합될 수 있으며, 학습자의 사전 지식 수준, 과제 난이도, 목표 인식 정도에 따라 다양한 방식으로 작동한다. Reinhold[7]의 CoDiL 모델에서 교수 전략은 디지털 환경에서 학습자의 인지 활동을 유도하는 설계 요소로, 문제 제시, 피드백, 시뮬레이션 등이 포함된다. 학습 전략은 학습자가 목표 달성을 위해 사용하는 인지적·메타인지적 접근으로, 자기점검이나 전략 조정이 이에 해당한다. 이 두 전략은 상호작용하며 학습자의 인지 처리 과정을 구조화하고, 지식 획득에 기여한다.

2.2 과정 데이터 기반 학습 분석과 자기조절 학습

Sedrakyan[5]은 학습 과정에서 발생하는 행동 데이터를 분석하여 학습자의 자기조절 학습(Self-Regulated Learning: SRL)을 지원하는 대시보드 설계를 제안하였다. 과정 데이터는 단순히 학습 시간을 기록하는 데 그치지 않고, 학습자가 목표를 설정하고 전략을 조절하는 방식까지도 파악할 수 있는 핵심적인 정보 자원으로 간주된다. 학습 초기 전략과 수정 전략, 목표 달성 여부, 피드백 수용 여부 등의 데이터를 분석하면 학습의 질을 보다 심층적으로 해석할 수 있다. 이러한 데이터는 학습자가 자신의 비효율적인 전략을 인식하고 수정하도록 돕는 한편, 교수자가 학습자의 경로와 반응을 분석하여 교수 전략이나 피드백을 조정할 수 있는 근거로도 활용된다. 즉, Sedrakyan[5]의 모델은 학습자와 교수자가 모두 과정 데이터를 바탕으로 전략을 유연하게 수정함으로써, 자기조절 학습을 강화하는 상호작용적 메커니즘을 형성한다.

2.3 인지 및 메타인지 이론과 디지털 매체의 역할

인지 및 메타인지 이론에 따르면 학습자는 능동적인 정보처리자로서, 새로운 정보를 기존 지식 구조와 통합하며 의미를 구성한다[6]. 이러한 과정에서 메타인지 전략(예: 자기점검, 자기설명, 오류 수정 등)은 학습 전반에 걸쳐 중요한 조절 요인으로 작용한다. 자기조절 학습은 학습자가 주도적으로 목표 설정, 전략 실행, 자기 성찰을 통해 학습의 전 과정을 관리하고 통제해나가는 순환적인 과정을 의미한다. 디지털 매체는 전략 사용을 촉진하고 강화할 수 있는 잠재력을 지니며, 실시간 피드백과 시각화된 대시보드 제공을 통해 학습자가 자신의 전략을 인식하고 조절할 수 있도록 지원한다.

2.4 디지털 학습 프레임워크: CoDiL

Reinhold[7]은 CoDiL(Cognitive Process Framework for Digital Learning)을 제안하며, 디지털 학습 환경에서 학습 활동을 설명할 수 있는 구조적 모델을 제시하였다. 이 모델은 디지털 교수 전략 → 학습 활동 → 인지 처리 과정 → 지식 획득이라는 일련의 경로를 설명하며, 교수전략이 학습자의 구체적 학습 활동을 매개하여 인지적 결과로 이어진다는 점을 강조한다. CoDiL 프레임워크는 학습 활동의 유형에 따라 유발되는 인지 처리 과정의 깊이가 달라진다는 점에 주목하며, 이를 통해 특정 디지털 교수전략의 효과를 체계적으로 분석하고 예측한다.

2.5 Sedrakyan의 대시보드 기반 피드백 모델과 AIDT 가이드라인 비교 분석

Sedrakyan[5]의 연구는 학습자가 학습 중 어느 시점에서 어떤 유형의 피드백이 필요한지를 결정하는 기준을 제시한다. 이들은 피드백을 인지적 피드백과 행동적 피드백으로 구분하며, 피드백이 자기조절 학습의 각 단계(계획, 실행, 모니터링, 적응)에 적시에 연결되어야 함을 강조한다. 특히 학습자의 목표 대비 진행 상태를 실시간으로 판단해주는 on-track 피드백이 학습자가 자신의 전략을 인식하고 적시에 조정하도록 지원하는 역할을 한다.

한편 한국교육학술정보원[4]은 디지털 교과서 콘텐츠 개발자를 대상으로 『AI 디지털교과서 개발 가이드라인』을 제시하고 있으며, 학습자의 성취도에 따른 정오 판단, 피드백, 보상 기능, 자기성찰을 위한 대시보드 제공 등을 포함한다. 이 두 관점은 디지털 학습에서 피드백의 중요성을 공통적으로 인식하고 있으나, 자기조절 학습과의 구조적 연계, 피드백의 시기 및 구분, 과정 데이터의 해석 범위 등에서 차이를 보인다.

Table 1은 AIDT 가이드라인과 Sedrakyan 모델을 중심으로 피드백 기능, 시점, 데이터 활용, 자기조절 연계, 이론적 정합성 항목에 따라 비교한 결과를 정리한 것이다.

AIDT 가이드라인은 Sedrakyan의 모델과 실시간 피드백 및 학습 참여 보상 등을 제공한다는 점에서 일치하나, 피드백이 계획, 실행, 모니터링, 적응의 자기조절 학습 단계와 어떻게 구조적으로 연결되는지에 대한 이론적 설명은 부족하다. 이러한 차이는 디지털 기반 학습 매체 설계와 실제 학습 메커니즘 간의 간극을 발생시키며, 이를 보완하기 위한 통합적 프레임워크의 제시가 필요하다.

본 연구에서는 Reinhold의 CoDiL 프레임워크와 Sedrakyan의 자기조절학습 모델을 바탕으로 『AI 디지털교과서 개발 가이드라인』을 분석함으로써, 디지털 기반 학습 매체 설계에 있어 이론적 타당성과 실천적 활용 가능성을 제고하기 위한 시사점을 도출하고자 한다. Reinhold와 Sedrakyan의 이론을 바탕으로 과정 데이터 기반의 전략 수정 및 교수 피드백 구성을 프레임워크에 반영하고자 한다.

3. 연구 설계 및 방법론

3.1 연구 방법

본 연구는 디지털 기반 학습 매체의 인지적 효과를 분석함에 있어, 학습자의 실제 행동 데이터를 실험적으로 통제하거나 조작하는 방식만으로는 학습 과정 전반의 인지적 메커니즘과 매체의 구조적 영향을 설명하는데 한계가 있다는 점을 전제로 한다. 따라서 본 연구는 단편적인 실증 검증이 아니라, 선행 이론의 핵심 개념과 메커니즘을 비교·통합하여 인지 과정의 구조적 관계를 설명하고, 이를 토대로 디지털 학습 맥락에 적합한 이론적 준거틀을 구축하는 것을 핵심 목적으로 하였다. 연구 목적을 실현을 위해, 복합적 인지변인 간 상호작용을 이론적으로 구조화하고 설명적 타당성을 확보하기에 적합한 방법인 이론적 모델 개발 연구 방법(Theoretical Model Development)을 적용하였다[9, 10].

본 연구는 첫째, 디지털 학습과 인지이론에 대한 주요 문헌을 분석하여 프레임워크의 핵심 구성 요소를 도출하였다. 둘째, 도출된 구성 요소 간의 논리적 관계를 구조화하여 프레임워크 초안을 설계하였다. 마지막으로, 완성된 프레임워크를 기반으로 디지털 기반 학습 매체의 효과를 진단할 수 있는 예비 평가 척도를 개발하였다.

3.2 문헌 분석 절차

프레임워크의 이론적 기반 구축을 위해, 본 연구는 체계적 문헌 분석을 수행하였다. 문헌 선정은 연구 질문과의 연관성 및 이론적 기여도를 고려하여 Table 2와 같은 기준을 적용하였다.

본 연구는 RQ1과 RQ2의 이론적 기반을 확립하기 위해 디지털 교수·학습 전략(기준 ⒜)과 인지·자기조절 학습 연구(기준 ⒝)를 핵심 대상으로 선정하였으며, RQ3의 현장 적용 가능성을 검증하기 위해 평가 척도 개발과 교육 맥락 적합성(기준 ⒞, ⒟)을 추가로 포함하였다.

분석 절차는 총 3단계로 진행되었다. 첫째, 개념적 탐색 단계에서는 디지털 기반 학습 환경과 관련된 주요 이론과 실증 연구를 탐색하여 연구의 이론적 배경을 확립하였다. 둘째, 구성 요소 추출 단계에서는 Table 2의 선정 기준에 따라 선별된 핵심 문헌에서 교수·학습 전략, 자기조절 메커니즘 등 프레임워크의 잠재적 구성 요소를 도출하고 분류하였다. 셋째, 구조 비교 및 통합 단계에서는 도출된 구성 요소들을 핵심 이론 모델 중심으로 비교 분석하고, 모델 간 논리적 관계를 통합하여 본 연구의 프레임워크 초안을 설계하였다.

분석 과정을 통해 최종적으로 선정된 문헌과 각 문헌이 프레임워크 개발에 기여한 핵심 요소는 Table 3과 같다. Table 3에 제시된 개념적 요소들은 4장에서 제안할 프레임워크의 핵심 구성 요소와 작동 원리를 뒷받침하는 이론적 토대가 된다.

3.3 프레임워크 및 평가 척도 개발 절차

본 연구는 3.2절의 문헌 분석 결과를 토대로, Table 4에 제시된 4단계의 절차에 따라 인지 기반 학습 프레임워크를 개발하였다. 디지털 기반 학습 매체의 효과성을 조작적으로 측정하기 위하여, 프레임워크의 요소를 도출하여 예비 평가 척도를 설계하였다.

프레임워크에 기반한 예비 평가 척도는 향후 실증 연구에서의 활용 가능성을 확보하기 위해 Table 5의 기준을 준수하였다.

평가 척도 문항 설계는 Panadero와 Alonso-Tapia[52]가 제안한 자기조절 학습 기반 평가 설계 원칙을 반영하였다. 첫째, 문항이 자기조절의 순환 과정(계획, 실행, 모니터링, 반성)을 포괄하도록 범주를 구성하였다. 둘째, 학습자의 전략 사용을 추상적 개념이 아닌 관찰 가능한 구체적 행동 진술로 구체화하였다. 셋째, 교사와 학생의 관점에서 다각적으로 평가할 수 있도록 문항을 이원화하여 병렬 설계하였다.

4. 인지 기반 학습 프레임워크 제안

4.1 프레임워크 구성 개요

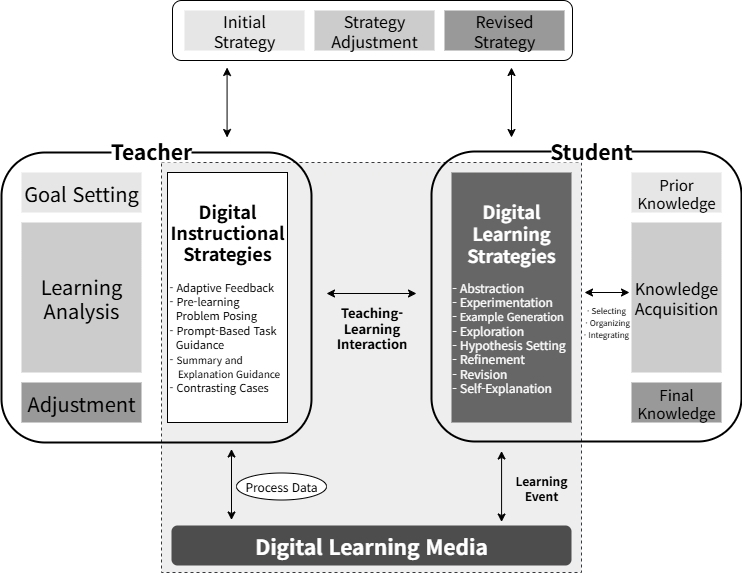

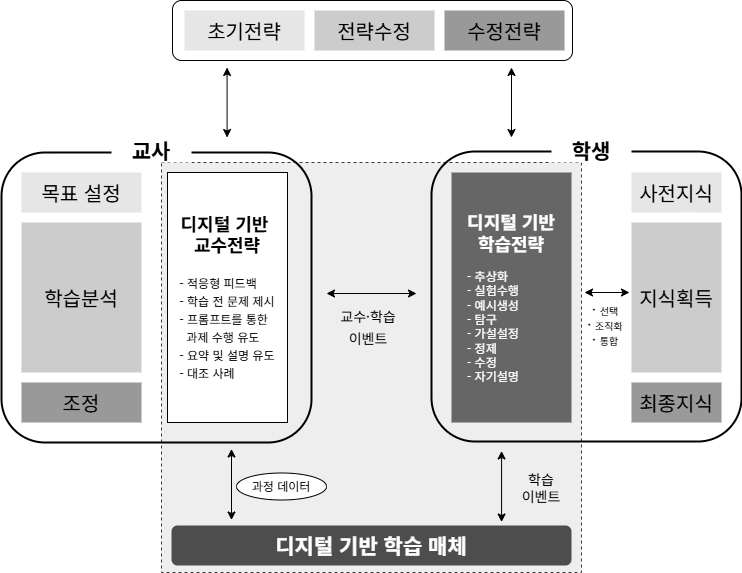

본 연구는 디지털 학습 환경에서 발생하는 교수·학습의 복합적인 인지 과정을 설명하기 위한 통합적 모델로서 Fig. 1의 인지 기반 학습 프레임워크(Cognitive Learning Framework)를 제안한다.

기존 연구들은 CoDiL, Sedrakyan, Zimmerman, Mayer 이론을 각각 독립된 관점에서 제시하였으나, 본 연구에서는 이들을 상보적으로 통합하였다. CoDiL은 교수전략과 학습활동의 구조적 틀을, Sedrakyan은 과정 데이터 기반의 피드백 루프를, Zimmerman은 학습자 수준의 자기조절 조정 과정을, Mayer는 지식의 인지적 통합 과정을 담당한다. 이 네 가지 기능은 서로 위계적·순환적으로 연결되어 학습 과정의 동적 메커니즘을 설명한다.

프레임워크의 기본 골격은 Reinhold[7]의 CoDiL 모델이 제시하는 교수 전략, 학습 활동, 인지 처리라는 선형적 흐름을 따른다. 그러나 CoDiL 모델만으로는 학습 과정에서 실시간으로 발생하는 상호작용과 전략의 변화를 설명하기에 한계가 있다. 해당 한계를 극복하기 위해, 본 프레임워크는 다음과 같은 이론적 통합을 시도하였다. 첫째, Sedrakyan[5]의 학습 분석 모델을 통합하여, 과정 데이터(Process Data)에 기반한 순환적 피드백 루프를 구현하였다. 교사와 학생 모두가 데이터를 근거로 자신의 전략을 조정하는 동적 상호작용이 가능해진다. 둘째, Zimmerman[6]의 자기조절 학습 이론을 학생의 전략 변화 과정에 적용하여, 피드백을 바탕으로 스스로 전략을 수정(Strategy Adjustment)하고 점검하는 내적 인지 과정을 구체화하였다. 셋째, Mayer[50]의 SOI 모델을 지식 획득(Knowledge Acquisition) 과정에 연결하여, 새로운 정보가 기존의 사전 지식(Prior Knowledge)과 결합하여 최종 지식(Final Knowledge)으로 통합하는 인지 처리 단계를 명시하였다.

결론적으로 본 프레임워크는 교사, 학생, 디지털 기반 학습 매체(Digital Learning Media)라는 세 요소를 중심으로, 학생의 초기 전략(Initial Strategy) 수행부터 데이터 기반의 피드백을 통한 전략 수정(Strategy Adjustment)을 거쳐 최종적인 지식 획득(Knowledge Acquisition)에 이르는 순환적이고 동적인 학습 메커니즘을 설명한다. 각 구성 영역의 역할은 Table 6에 제시한다.

4.2 프레임워크 구성 원리

본 프레임워크는 4.1절에서 언급한 이론적 통합을 바탕으로, 디지털 학습 환경의 동적 특성을 반영하는 다음 세 가지 핵심 원리에 따라 설계되었다.

첫째, 교수·학습 전략 간의 순환적 상호작용을 구조화하였다. 기존의 인지 학습 모델이 주로 학생의 전략 사용과 조정 과정에 주목했다면[6, 12], 본 프레임워크는 교사의 디지털 기반 교수 전략(Digital Instructional Strategies)이 학생의 디지털 기반 학습 전략(Digital Learning Strategies) 수행에 직접적으로 개입하고, 그 결과가 다시 교사의 학습 분석(Learning Analysis)에 영향을 미치는 순환적 구조를 제시한다. Reinhold[7]의 CoDiL 모델의 선형적 모델을 확장하여, 피드백를 매개로 한 상호작용이 지속적인 전략 수정(Strategy Adjustment)으로 이어지는 과정을 설명한다.

둘째, 과정 데이터 기반의 동적 조정 원리를 강조하였다. 학습 및 교수 전략이 미리 설계된 대로 고정되는 것이 아니라, 학습 과정에서 실시간으로 생성되는 과정 데이터(Process Data)를 근거로 지속해서 수정 및 정교화되어야 한다는 원칙이다. 본 프레임워크는 Sedrakyan[5]의 피드백 모델을 확장하여, 과정 데이터가 학습자와 교수자 모두에게 전략을 동적으로 조정하게 하는 핵심 근거로 기능해야 함을 이론적 원리로 삼는다.

셋째, 자기조절 학습에 기반한 학생의 전략 수정 및 지식 획득 과정을 구체화하였다. 본 프레임워크는 Zimmerman[6]의 이론에 따라 학생이 계획, 실행, 성찰의 순환 과정을 통해 자기조절 학습을 수행하고, 이 과정에서 제공되는 피드백을 바탕으로 자신의 학습 전략을 수정(Strategy Adjustment)한다고 본다[52]. 수정된 전략을 통해 재구성된 정보는, Mayer[50]의 인지 이론에 따라 기존의 사전 지식(Prior Knowledge)과 통합되어 더 정교한 최종 지식(Final Knowledge)을 형성하는 지식 획득(Knowledge Acquisition)으로 이어진다.

세 가지 구성 원리는 디지털 환경에서 학생과 교사 모두가 데이터를 기반으로 한 단계 성장하는 학습 주체임을 보여준다. 기존 모델들이 갖는 단방향적, 선형적 설명에서 벗어나, 디지털 환경에서 순환적 상호작용을 중심으로 교수·학습을 분석하고 설계할 수 있는 이론적 기반을 제공한다.

4.3 인지 기반 학습 프레임워크의 메커니즘

본 절에서는 제안된 프레임워크의 세 가지 핵심 구성 요소인 교사, 학생, 디지털 기반 학습 매체가 어떻게 상호작용하며 순환적인 학습 메커니즘을 형성하는지 구체적으로 설명한다.

프레임워크의 교사 영역은 학생의 학습 과정 데이터를 분석하여 최적인 교육 전략을 실행하고 동적으로 조정(Adjustment)하는 역할을 수행한다. 본 연구에서 제시하는 디지털 기반 교수 전략(Digital Instructional Strategies)은 세 가지 기준에 따라 선정되었다. 첫쨰, 선행 연구를 통해 인지 및 자기조절 학습 촉진 효과가 검증된 전략(효과성). 둘째, 실제 디지털 학습 환경에서 기술적으로 구현 가능한 전략(적용 가능성). 셋째, 프레임워크의 다른 구성 요소들과 유기적으로 상호작용하는 전략(체계성)이다[6, 11, 12, 14].

교사는 목표 설정(Goal Setting) 후 Table 7과 같은 디지털 기반 교수 전략을 실행한다. 이 과정에서 디지털 학습 매체를 통해 수집된 과정 데이터(Process Data)를 바탕으로 학생의 상태를 진단하는 학습 분석(Learning Analysis)을 수행하고, 분석 결과를 토대로 교육 전략의 내용과 시점을 지속적으로 조정(Adjustment)한다[5, 7, 54].

학생 영역은 사전 지식(Prior Knowledge)을 바탕으로 초기 전략을 실행하고, 교사와 매체로부터 피드백을 받아 자신의 전략을 능동적으로 수정(Strategy Adjustment)하며 지식을 구성해나가는 과정을 설명한다. Table 8에 제시된 디지털 기반 학습 전략 역시 교사의 교육 전략과 동일한 기준인 효과성, 적용 가능성, 체계성에 따라 선정되었다.

학생은 초기 전략(Initial Strategy)을 사용하여 학습을 시작한다. 이후 교수·학습 상호작용(Teaching -Learning Interaction)과정에서 제공되는 피드백을 통해 자신의 인지 과정을 점검하고, 비효율적인 부분을 개선하기 위한 전략 수정(Strategy Adjustment)을 수행한다. 이 과정을 통해 형성된 수정 전략(Revised Strategy)은 최종적으로 새로운 지식을 내면화는 지식 획득(Knowledge Acquisition)으로 이어진다[6].

본 연구에서 제시한 교수 전략(Table 7)과 학습 전략(Table 8)은 상호 독립적인 목록이 아니라, Fig. 1에서 제시한 순환적 학습 구조 내에서 위계적으로 연결된다.

교수 전략은 학습자의 전략실행을 촉발하고, 피드백을 통해 전략조정(adjustment) 으로 이어지는 상위 조절 기능을 수행하며, 학습 전략은 이러한 교수 전략의 유도 하에 전략 실행–피드백수용–자기조정–지식획득의 단계를 거치며 작동한다.

디지털 기반 학습 매체(Digital Learning Media)는 단순히 학습 콘텐츠를 전달하는 도구를 넘어, 교사와 학생 간의 상호작용을 매개하고 프레임워크 전체의 동적 메커니즘을 구동시키는 핵심적인 역할을 한다[5]. 디지털 기반 학습 매체는 두 가지 핵심적인 순환 경로를 생성한다. 첫째, 학생의 모든 학습 이벤트(Learning Event)를 클릭 경로, 반응 시간 등의 과정 데이터(Process Data)로 수집하여 교사에 게 제공한다. 교사는 이를 학습 분석(Learning Analysis)의 근거로 삼아 자신의 교육 전략을 조정(Adjustment)할 수 있다[5]. 둘째, 교사의 교육 전략과 시스템의 알고리즘을 바탕으로 학생에게 개인화된 피드백을 제공한다. 학생은 피드백을 통해 자신의 전략을 수정(Strategy Adjustment)하는 자기조절 학습을 수행할 수 있게 된다[16]. 매체는 데이터와 피드백의 지속적인 순환을 통해 전체 프레임워크의 동적 상호작용을 완성시킨다.

4.4 프레임워크 기반 사례 분석

본 절에서는 제안된 프레임워크가 실제 학습 현상을 어떻게 설명하고 분석하는지를 보여주기 위한 예시로서 세 학습자의 사례를 제시한다. 이 분석은 효과성을 통계적으로 검증하기 위함이 아니라, 프레임워크의 설명력과 실천적 유용성을 탐색적으로 보여주는 것을 목적으로 한다.

사례 분석은 초등학교 3학년 '곱셈' 단원을 중심으로 구성된 디지털 기반 수업 장면에서 이루어졌다. 수업은 반복 덧셈을 통해 곱셈 개념을 도입하고, 곱셈식을 활용한 문제 해결로 확장되는 구조로 설계되었다. 수업에서 사용된 디지털 기반 학습 매체는 시각적 모델, 자동 피드백, 프롬프트 제공 등의 기능을 포함하고 있었으며, 교사는 이 도구를 활용해 학생 개개인에게 맞춤형 교수 전략(Instructional Strategies)을 제공하였다.

세 명의 학습자 A, B, C는 동일한 초기 전략(Initial Strategy)을 사용하였으나, 이후 교수 전략, 피드백 수용, 전략 수정(Strategy Adjustment)의 흐름에서 서로 다른 양상을 보렸으며, 이는 최종 지식 획득(Knowledge Acquisitiozn)에도 영향을 주었다.

세 학생의 학습 과정 차이를 프레임워크의 핵심 구성 요소에 따라 분석한 결과는 Table 9와 같다. Table 9는 각 학생의 학습 경로가 프레임워크의 순환적 메커니즘과 어떻게 상호작용하는지 보여준다.

본 절의 사례 분석은 교사전략(Instructional Strategy), 학생의 초기전략(Initial Strategy), 피드백 수용(Feedback Acceptance), 전략조정(Strategy Adjustment), 지식획득(Knowledge Acquisition)의 다섯 구성 요소를 기준으로 프레임워크의 순환 구조를 검증하였다.

학습자 A는 교사의 효과적인 전략 제시와 적극적인 피드백 수용 및 전략 조정을 통해 모든 요소가 완전하게 작동한 사례이며, 학습자 B는 교사 전략과 전략 조정 간의 연결이 약화된 사례, 학습자 C는 피드백 수용 요소에서 단절이 발생하여 순환 구조가 유지되지 못한 사례로 볼 수 있다. 각 사례는 프레임워크 구성 요소의 작동 정도를 명시적으로 대응시켜 학습 성과의 차이를 설명한다.

학습자 A의 성공은 프레임워크의 모든 구성 요소가 유기적으로 작동한 결과로 해석할 수 있다. 교사의 효과적인 디지털 기반 교수 전략(요약 및 설명유도)은 학생의 적극적인 피드백 수용을 이끌었고, 이는 고차원적인 전략 수정(추상화 및 예시 생성)으로 연결되어 성공적인 지식 획득을 가능하게 했다.

반면, 학습자 B와 C의 실패는 이 순환 구조의 특정 지점이 단절되거나 비효율적으로 작동했기 때문이다. 학습자 B는 교사의 디지털 기반 교수 전략(단순 힌트 제공)이 부적절하여, 학생의 전략 수정(Strategy Adjustment)이 개념적 이해로 나아가지 못하고 표면적인 수준에 머물렀다. 학습자 C의 경우, 학생이 피드백 수용을 거부하면서 교사의 디지털 기반 교수 전략과 학생의 전략 수정 사이의 연결 자체가 단절되어 학습이 진전되지 않았다.

사례 분석은 제안된 프레임워크가 학습 결과를 예측하는 것을 넘어, 성공과 실패에 이르는 과정의 핵심적인 메커니즘과 그 원인을 각 구성 요소의 상호작용을 통해 체계적으로 진단할 수 있는 분석틀로서 기능할 수 있음을 시사한다.

5. 인지 기반 디지털 학습 매체 평가 척도

본 연구는 앞서 제시한 문헌 분석 절차와 프레임워크 및 평가 척도 개발 과정을 토대로 디지털 기반 학습 매체의 효과성을 분석하기 위한 다섯 가지 핵심 평가 범주(학습 전략 유도, 피드백 적절성, 지식 획득 지원, 과정 데이터 활용 가능성, 자기조절 학습 지원)를 도출하였다.

‘학습 전략 유도’와 ‘자기조절 학습 지원’은 모두 학습자의 주도적 활동을 다루지만, 각각 인지적 실행과 메타인지적 조절이라는 상이한 학습 과정의 층위를 측정하도록 설계되었다. 전자는 디지털 기반 학습 매체가 학습자로 하여금 자기 설명, 추론, 정교화와 같은 인지적 학습 전략을 적극적으로 활용하도록 유도하는 정도에 초점을 두며, 후자는 학습자가 스스로 학습 목표를 설정하고 학습 전략을 점검·조정하며 학습 결과를 성찰하는 메타인지적 조절 과정을 지원하는 정도에 중점을 둔다.

이를 통해 개발된 척도는 인공지능 기반 디지털 교과서를 포함한 다양한 디지털 기반 학습 매체의 교육적 효과성을 정량적으로 분석할 수 있는 기준을 제공한다. 즉, 단순한 학업 성취 결과뿐만 아니라 학습 과정에서 발생하는 인지적·메타인지적 활동까지 포괄하여 도구의 효과성을 평가하도록 설계되었다. Table 10·11에 척도의 다섯 가지 범주와 그 의미를 요약하고, 각 범주별 문항 예시를 제시한다.

이상의 다섯 범주를 종합함으로써, 개발된 평가 척도는 디지털 학습 매체의 전반적인 교육적 효과성을 측정할 수 있다. 본 평가 척도를 통해 인공지능 기반 디지털 교과서와 같은 지능형 디지털 학습 매체의 학습 전략 유도 수준, 피드백의 적절성, 학습자의 지식 획득 및 자기조절 학습 지원 효과를 정량적으로 검토할 수 있다. 결론적으로, 본 연구의 척도는 디지털 도구 설계에 내포된 인지과학적 원리의 구현 정도를 평가함으로써 도구의 효과성을 진단하는 체계적 기준을 제공한다.

또한 본 연구의 평가 척도는 문헌 분석과 이론적 근거를 바탕으로 평가 척도의 개념적 타당성을 확보하는 데 중점을 두었다. 향후 연구에서는 델파이 검증 및 탐색적 요인분석을 통해 평가 척도의 구인 타당도와 신뢰도를 검증할 계획이다. 이를 통해 본 연구의 평가 척도가 디지털 기반 학습 매체의 효과성을 진단하는 실증적 도구로 발전할 수 있도록 지속적인 타당화 과정을 추진하고자 한다.

6. 결론 및 제언

6.1 기존 이론과의 비교 및 차별성

본 연구의 프레임워크가 기존 이론들과 갖는 주요 비교 및 차별성은 Table 12에 요약하여 제시한다.

기존 이론과 본 연구의 프레임워크의 비교를 요약하면 다음과 같다.

첫째, Reinhold[7]의 CoDiL 모델이 디지털 교수 전략에서 지식 획득까지의 선형 경로를 중심으로 설명한다면, 본 프레임워크는 이러한 경로에 과정 데이터 기반의 상호 피드백 루프와 순환 구조를 추가하여 학습자의 전략 수정 및 인지 전환 과정을 강조한다.

둘째, 본 프레임워크는 Sedrakyan[5]의 대시보드 기반 피드백 설계 모델과는 달리 학습 분석(log data analytics)의 관점을 확대하여, 디지털 기반 학습 매체에서 수집되는 다양한 과정 데이터를 학습 설계 및 평가와 직접 연결할 수 있는 구조를 제시한다는 점에서 확장된 구조를 갖는다.

셋째, Zimmerman[6]의 자기조절 학습 이론의 목표 설정, 전략 사용, 자기점검과 같은 핵심 요소를 포함하되 디지털 교수·학습 전략의 개입과 메타인지적 피드백 개입의 시각적 구조화를 통해 실천적 적용 가능성을 높였다.

마지막으로, 본 프레임워크는 SOI모델[53]과 KLI 프레임워크[11] 이론들의 핵심 구조를 계승하면서도, 앞서 언급한 CoDiL[7] 및 Sedrakyan[5] 이론과의 통합을 통해 디지털 환경에서 수집가능한 과정 데이터를 중심으로 실천적 적용성과 분석 가능성을 높였다는 점에서 종합적인 차별성을 갖는다.

이러한 비교를 통해 본 연구의 프레임워크는 기존 이론의 핵심 구조를 계승 및 통합하면서도, 디지털 환경에서의 과정 데이터 기반 순환적 상호작용, 실천적 적용성, 분석 가능성을 강화했다는 점에서 학술적 의의가 있다. 나아가 본 프레임워크는 인공지능 기반 학습 도구의 효과 분석, 디지털 학습 설계 평가, 데이터 기반 피드백 시스템 개발 등에 활용 가능한 개념적 도구로 확장될 수 있다.

6.2 실천적 시사점

본 절에서는 연구 결과를 근거로 교사, 디지털 기반 학습 매체 개발자, 교육 행정가 측면에서 적용 가능한 실천적 시사점을 논의한다.

첫째, 교사 측면에서는 인공지능 기반 디지털 교과서 수업에서 수집되는 학습 로그와 자기 설명 데이터 등을 분석하여 학습자의 상태를 진단하고, 피드백 제공의 시점과 내용을 조정할 필요가 있다. 이는 학습자 A, B, C의 전략 수정 여부와 피드백 수용 태도에 따라 학습 결과가 달라졌다는 본 연구의 사례 분석 결과(Table 9)와 직접적으로 연결된다. 따라서 교사는 과정 데이터를 단순한 기록이 아니라 전략 조정과 성취 차이를 설명하는 근거 자료로 활용함으로써, 학습 목표 달성에 실질적으로 기여할 수 있을 것이다.

둘째, 디지털 기반 학습 매체 개발자 측면에서는 학습자의 자기조절 학습 과정을 자연스럽게 유도할 수 있도록 단계별 전략 안내와 사고 촉진형 상호작용을 강화해야 한다. 본 연구의 사례 분석(Table 9)에서 학습자 A는 피드백을 적극 수용하며 전략을 수정해 개념적 이해를 심화한 반면, 학습자 C는 피드백을 회피하여 전략 전환에 실패하였다. 이러한 차이는 학습 매체가 학습자의 인지적 전략 수행과 메타인지적 조절 과정을 동시에 지원해야 함을 보여준다. 따라서 디지털 기반 학습 매체 개발자는 본 연구에서 제안한 평가 척도(Table 10·11)를 설계 지침으로 삼아, 학습자의 전략 선택과 조정 과정을 체계적으로 진단·지원할 수 있는 기능(예: 인지적 피드백, 학습 경로 분석)을 구현할 필요가 있다.

셋째, 교육 행정가 측면에서는 디지털 기반 학습 매체의 효과적 활용을 위해 인지적 설계 원리가 학교 현장에 안정적으로 적용될 수 있도록 정책적 가이드라인을 마련해야 한다. 이는 본 연구에서 AIDT 가이드라인과 Sedrakyan[5]의 피드백 이론을 비교 분석한 결과, 현행 지침이 자기조절 학습 단계와의 구조적 연계성이 부족하다는 점이 확인된 데에 근거한다. 따라서 교사 연수에는 디지털 도구 활용 역량뿐만 아니라 학습자 데이터 해석 및 피드백 설계 역량이 포함되어야 한다. 아울러 본 연구에서 제안한 인지 기반 학습 프레임워크는 이러한 정책적 진단과 환류를 가능하게 하는 실증적·이론적 도구로 기능할 수 있을 것이다.

교사, 디지털 기반 학습 매체 개발자, 교육 행정가 수준의 시사점은 디지털 교과서가 실제 교육 현장에서 효과적으로 활용되고, 교육적 성과로 이어질 수 있는 기반을 마련하는 데 기여할 것으로 기대된다.

6.3 정책적·교육적 함의

본 연구는 인공지능 기반 디지털 교과서 도입과 관련한 교육 정책 및 제도 설계에 다음과 같은 정책적·교육적 함의를 제공한다.

첫째, 디지털 교과서 개발·보급 정책에는 피드백 설계, 학습분석 기능, 자기조절 지원 요소가 포함되어야 하며, 이는 Table 9에서 확인된 바와 같이 피드백 수용과 전략 수정이 학습 성과에 직접적 영향을 미친다는 결과에 근거한다. 또한 이러한 결과는 Sedrakyan[5]의 피드백 이론이 제시한 적시성과 정교성 원리가 실제 학습 효과를 매개한다는 선행 연구의 논지를 뒷받침한다. 이를 실현하기 위해서는 교실 인프라 구축, 교사 역량 강화, 개인정보 보호를 위한 제도적 지원이 필요하다.

둘째, 디지털 기반 학습 매체 개발 가이드라인에는 인지과학 기반 피드백 설계 원리를 반영해야 한다. 왜냐하면 본 연구의 프레임워크에 의하면 기존 AIDT 가이드라인에서 간과되었던 자기조절 학습 지원 및 과정 데이터 활용 요소를 강화함으로써, 디지털 기반 학습 매체가 단순한 콘텐츠 전달 도구가 아닌 학습자의 사고 과정을 촉진하는 매체로 설계할 수 있도록 하기 때문이다. 따라서 AIDT 지침과 Sedrakyan[5] 모델 비교 결과 드러난 한계를 보완하기 위해 정책 차원에서 피드백 유형과 단계별 설계를 구체적으로 권장해야 한다. 이를 위해 국가 표준화, 교사 연수, 개발사 가이드라인 준수 평가가 병행되어야 한다.

셋째, 본 연구의 프레임워크와 평가 척도는 디지털 기반 학습 매체 개발에 관한 정책 진단과 디지털 기반 학습 매체 평가 도구로 활용 가능하다. 이를 통해 학습자 데이터 기반의 맞춤형 학습 지원 체계를 구축하는 논리적 근거를 제공할 수 있다.

6.4 한계 및 후속 연구

본 연구는 인지 기반 학습 프레임워크의 이론적 정립과 사례 분석을 통해 인공지능 기반 디지털 교과서 활용 가능성을 제시하였으나, 다음과 같은 한계가 존재한다.

첫째, 본 연구는 인지 기반 학습 프레임워크와 평가 척도를 모델 제안 단계에서 제시하는 데 의의를 두었으며, 이에 따라 전문가 집단 검토와 통계적 타당성 분석이 이루어지지 못하였다. 따라서 후속 연구에서는 전문가 검토와 델파이 기법을 활용하여 척도의 타당성과 신뢰성을 확보할 필요가 있다.

둘째, 본 연구는 대규모 연구의 특성상 모든 과제를 한 번에 수행하기 어려워, 제안–검증–확산으로 이어지는 순차적 연구 과정이 요구된다. 이에 따라 후속 연구에서는 실제 수업 맥락에서 교사와 학습자를 대상으로 한 현장 연구를 통해 척도의 적용 가능성과 실효성을 검증할 필요가 있다.

궁극적으로, 제안된 인지 기반 학습 프레임워크는 이러한 연구 과제의 축적을 통해 디지털 학습 환경에서의 교수·학습 설계와 학습자 지원을 위한 신뢰도 높은 기준점으로 자리매김할 수 있을 것이다.

Acknowledgments

본 논문은 2025년도 교육부의 재원으로 한국과학창의재단의 지원을 받아 수행된 성과물임

This work was supported by the Korea Foundation for the Advancement of Science and Creativity(KOSAC) grant funded by the Korea government(MOE)

References

- Kim, S. (2024, July 9). "Realizing personalized education” vs. “Concerns about side effects”: Debate intensifies ahead of next year’s introduction of the AI digital textbook [“맞춤교육 실현”vs“부작용 우려”…'AI 디지털 교과서' 내년 도입 앞두고 찬반 논란 가열], News Balance. https://www.newsbalance.co.kr/news/view/1065555711439222

-

Clark, R. E. (1994). Media will never influence learning. Educational Technology Research and Development, 42(2), 21–29.

[https://doi.org/10.1007/BF02299088]

-

Kozma, R. B. (1994). Will media influence learning? Reframing the debate. Educational Technology Research and Development, 42(2), 7–19.

[https://doi.org/10.1007/BF02299087]

- Korea Education and Research Information Service (KERIS). (2023). AI digital textbook development guidelines[AI Digital Textbook Development Guidelines (GM 2023-14). Korea Education and Research Information Service.

-

Sedrakyan, G., Malmberg, J., Verbert, K., Järvelä, S., & Kirschner, P. A. (2020). Linking learning behavior analytics and learning science concepts: Designing a learning analytics dashboard for feedback to support learning regulation. Computers in Human Behavior, 107, Article 105512.

[https://doi.org/10.1016/j.chb.2018.05.004]

-

Zimmerman, B. J. (2002). Becoming a self-regulated learner: An overview. Theory into Practice, 41(2), 64–70.

[https://doi.org/10.1207/s15430421tip4102_2]

-

Reinhold, F., Leuders, T., Loibl, K., Nückles, M., Beege, M., & Boelmann, J. M. (2024). Learning mechanisms explaining learning with digital tools in educational settings: A cognitive process framework. Educational Psychology Review, 36, Article 14.

[https://doi.org/10.1007/s10648-024-09845-6]

-

Azevedo, R. (2009). Theoretical, conceptual, and methodological issues in research on metacognition and self-regulated learning: A discussion. Metacognition and Learning, 4(1), 87–95.

[https://doi.org/10.1007/s11409-009-9035-7]

-

Lynham, S. A. (2002). The general method of theory-building research in applied disciplines. Advances in Developing Human Resources, 4(3), 221–241.

[https://doi.org/10.1177/1523422302043002]

-

Rocco, T. S., & Plakhotnik, M. S. (2009). Literature reviews, conceptual frameworks, and theoretical frameworks: Terms, functions, and distinctions. Human Resource Development Review, 8(1), 120–130.

[https://doi.org/10.1177/1534484309332617]

-

Koedinger, K. R., Corbett, A. T., & Perfetti, C. (2012). The knowledge-learning-instruction framework: Bridging the science-practice chasm to enhance robust student learning. Cognitive Science, 36(5), 757–798.

[https://doi.org/10.1111/j.1551-6709.2012.01245.x]

-

Winne, P. H., & Hadwin, A. F. (1998). Studying as self-regulated learning. In D. J. Hacker, J. Dunlosky, & A. C. Graesser (Eds.), Metacognition in educational theory and practice(pp. 277–304). Lawrence Erlbaum Associates.

[https://doi.org/10.4324/9781410602350]

-

Cronbach, L. J., & Meehl, P. E. (1955). Construct validity in psychological tests. Psychological Bulletin, 52(4), 281–302.

[https://doi.org/10.1037/h0040957]

-

Borko, H., Whitcomb, J. A., & Liston, D. (2009). Wicked problems and other thoughts on issues of technology and teacher learning. Journal of Teacher Education, 60(1), 3–7.

[https://doi.org/10.1177/0022487108328488]

-

Aleven, V., McLaughlin, E. A., Glenn, R. A., & Koedinger, K. R. (2017). Instruction based on adaptive learning technologies. In R. E. Mayer & P. A. Alexander (Eds.), Handbook of research on learning and instruction(2nd ed., pp. 522–560). Routledge.

[https://doi.org/10.4324/9781315736419]

-

Reinhold, F., Hoch, S., Werner, B., Richter-Gebert, J., & Reiss, K. (2020). Learning fractions with and without educational technology: What matters for high-achieving and low-achieving students? Learning and Instruction, 65, Article 101264.

[https://doi.org/10.1016/j.learninstruc.2019.101264]

-

Boomgaarden, A., Loibl, K., & Leuders, T. (2023). The trade-off between complexity and accuracy: Preparing for computer-based adaptive instruction on fractions. Interactive Learning Environments, 31(10), 6379–6394.

[https://doi.org/10.1080/10494820.2022.2038636]

-

Kapur, M. (2008). Productive failure. Cognition and Instruction , 26(3), 379–424 .

[https://doi.org/10.1080/07370000802212669]

-

Loibl, K., Roll, I., & Rummel, N. (2017). Towards a theory of when and how problem solving followed by instruction supports learning. Educational Psychology Review, 29(4), 693–715.

[https://doi.org/10.1007/s10648-016-9379-x]

-

Holmes, N. G., Day, J., Park, A. H. K., Bonn, D. A., & Roll, I. (2014). Making the failure more productive: Scaffolding the invention process to improve inquiry behaviors and outcomes in invention activities. Instructional Science, 42(4), 523–538.

[https://doi.org/10.1007/s11251-013-9300-7]

-

Fiorella, L., & Mayer, R. E. (2016). Eight ways to promote generative learning. Educational Psychology Review, 28(4), 717–741.

[https://doi.org/10.1007/s10648-015-9348-9]

- Weinstein, C. E., & Mayer, R. E. (1986). The teaching of learning strategies. In M. C. Wittrock (Ed.), Handbook of research on teaching (3rd ed., pp. 315–327). Macmillan.

-

Berthold, K., Nückles, M., & Renkl, A. (2007). Do learning protocols support learning strategies and outcomes? The role of cognitive and metacognitive prompts. Learning and Instruction, 17(5), 564–577.

[https://doi.org/10.1016/j.learninstruc.2007.09.007]

-

Chi, M. T. H., Bassok, M., Lewis, M. W., Reimann, P., & Glaser, R. (1989). Self-explanations: How students study and use examples in learning to solve problems. Cognitive Science, 13(2), 145–182.

[https://doi.org/10.1207/s15516709cog1302_1]

-

Nückles, M., Hübner, S., & Renkl, A. (2009). Enhancing self-regulated learning by writing learning protocols. Learning and Instruction, 19(3), 259–271.

[https://doi.org/10.1016/j.learninstruc.2008.05.002]

-

Hofer, S. I., Schumacher, R., Rubin, H., & Stern, E. (2018). Enhancing physics learning with cognitively activating instruction: A quasi-experimental classroom intervention study. Journal of Educational Psychology, 110(8), 1175–1191.

[https://doi.org/10.1037/edu0000266]

-

Reinhold, F., Strohmaier, A., Hoch, S., Reiss, K., Böheim, R., & Seidel, T. (2020). Process data from electronic textbooks indicate students' classroom engagement. Learning and Individual Differences, 83-84, Article 101934.

[https://doi.org/10.1016/j.lindif.2020.101934]

-

Ma, N., Qian, J., Gong, K., & Lu, Y. (2023). Promoting programming education of novice programmers in elementary schools: A contrasting cases approach for learning programming. Education and Information Technologies, 28, 9117–9147.

[https://doi.org/10.1007/s10639-022-11565-9]

-

Schalk, L., Schumacher, R., Barth, A., & Stern, E. (2018). When problem-solving followed by instruction is superior to the traditional tell-and-practice sequence. Journal of Educational Psychology, 110(4), 596–610.

[https://doi.org/10.1037/edu0000234]

-

Arnon, I., Cottrill, J., Dubinsky, E., Oktaç, A., Roa Fuentes, S., Trigueros, M., & Weller, K. (2014). APOS theory: A framework for research and curriculum development in mathematics education.Springer.

[https://doi.org/10.1007/978-1-4614-7966-6]

- Lehtinen, E., & Repo, S. (1996). Activity, social interaction, and reflective abstraction: Learning advanced mathematical concepts in computer-environment. In S. Vosniadou, E. De Corte, R. Glaser, & H. Mandl (Eds.), International perspectives on the psychological foundations of technology-based learning environments(pp. 105–128). Lawrence Erlbaum Associates.

-

Renkl, A. (2023). Exemplars. In R. Tierney, F. Rizvi, & K. Ercikan (Eds.), International Encyclopedia of Education (4th ed., pp. 612–622). Elsevier.

[https://doi.org/10.1016/B978-0-12-818630-5.14067-9]

-

Rittle-Johnson, B., & Star, J. R. (2011). The power of comparison in learning and instruction: Learning outcomes supported by different types of comparisons. In J. P. Mestre & B. H. Ross (Eds.), Psychology of learning and motivation, 55, 199–225. Academic Press.

[https://doi.org/10.1016/B978-0-12-387691-1.00007-7]

-

Hart, C., Mulhall, P., Berry, A., Loughran, J., & Gunstone, R. (2000). What is the purpose of this experiment? Or can students learn something from doing experiments? Journal of Research in Science Teaching, 37(7), 655–675.

[https://doi.org/10.1002/1098-2736(200009)37:7<655::AID-TEA3>3.0.CO;2-E]

-

Lazonder, A. W., & Harmsen, R. (2016). Meta-analysis of inquiry-based learning: Effects of guidance. Review of Educational Research, 86(3), 681–718.

[https://doi.org/10.3102/0034654315627366]

-

Wörner, S., Kuhn, J., & Scheiter, K. (2022). The best of two worlds: A systematic review on combining real and virtual experiments in science education. Review of Educational Research, 92(6), 911–952.

[https://doi.org/10.3102/00346543221079417]

-

Guerrero, T. A., Griffin, T. D., & Wiley, J. (2024). The effects of generating examples on comprehension and metacomprehension. Journal of Experimental Psychology: Applied, 30(2), 318–330.

[https://doi.org/10.1037/xap0000490]

-

Watson, A., & Mason, J. (2002). Student-generated examples in the learning of mathematics. Canadian Journal of Science, Mathematics and Technology Education, 2(2), 237–249.

[https://doi.org/10.1080/14926150209556516]

- Lachner, M., Künsting, J., Leuders, T., & Wessel, L. (2022). Exploring and discovering—productive for learners with different learning prerequisites. Der Mathematikunterricht, 2, 40–51.

-

Klahr, D., & Dunbar, K. (1988). Dual space search during scientific reasoning. Cognitive Science, 12(1), 1–48.

[https://doi.org/10.1207/s15516709cog1201_1]

-

Park, J. (2006). Modelling analysis of students' processes of generating scientific explanatory hypotheses. International Journal of Science Education, 28(5), 469–489.

[https://doi.org/10.1080/09500690500404540]

-

Booth, J. L., McGinn, K. M., Barbieri, C., Begolli, K. N., Chang, B., Miller-Cotto, D., Young, L. K., & Davenport, J. L. (2017). Evidence for cognitive science principles that impact learning in mathematics. In D. C. Geary, D. B. Berch, R. J. Ochsendorf, & K. M. Koepke (Eds.), Acquisition of complex arithmetic skills and higher-order mathematics concepts(pp. 297–325). Academic Press.

[https://doi.org/10.1016/B978-0-12-805086-6.00013-8]

- Chi, M. T. H. (2008). Three types of conceptual change: Belief revision, mental model transformation, and categorical shift. In S. Vosniadou (Ed.), International handbook of research on conceptual change(pp. 89–110). Routledge.

-

Duit, R., & Treagust, D. F. (2003). Conceptual change: A powerful framework for improving science teaching and learning. International Journal of Science Education, 25(6), 671–688.

[https://doi.org/10.1080/09500690305016]

-

Schroeder, N. L., & Kucera, A. C. (2022). Refutation text facilitates learning: A meta-analysis of between-subjects experiments. Educational Psychology Review, 34(2), 957–987.

[https://doi.org/10.1007/s10648-021-09656-z]

-

Vosniadou, S. (1994). Capturing and modeling the process of conceptual change. Learning and Instruction, 4(1), 45–69.

[https://doi.org/10.1016/0959-4752(94)90018-3]

-

Bisra, K., Liu, Q., Nesbit, J. C., Salimi, F., & Winne, P. H. (2018). Inducing self-explanation: A meta-analysis. Educational Psychology Review, 30(3), 703–725.

[https://doi.org/10.1007/s10648-018-9434-x]

-

Renkl, A., Stark, R., Gruber, H., & Mandl, H. (1998). Learning from worked-out examples: The effects of example variability and elicited self-explanations. Contemporary Educational Psychology, 23(1), 90–108.

[https://doi.org/10.1006/ceps.1997.0959]

-

Chi, M. T. H. (2009). Active-constructive-interactive: A conceptual framework for differentiating learning activities. Topics in Cognitive Science, 1(1), 73–105.

[https://doi.org/10.1111/j.1756-8765.2008.01005.x]

-

Mayer, R. E. (2014). Cognitive theory of multimedia learning. In R. E. Mayer (Ed.), The Cambridge handbook of multimedia learning(2nd ed., pp. 31–48). Cambridge University Press.

[https://doi.org/10.1017/CBO9781139547369.005]

-

Lee, S., & Jeon, J. (2024). 디지털 기반 학습환경에서의 자기 조절학습 척도 예비문항 개발 연구 [A study on preliminary items for self-regulated learning scale development in digital-based learning environment].Journal of Research and Practice in Educational Community, 6(1), 235–260.

[https://doi.org/10.23108/decrc.2024.6.1.235]

-

Panadero, E., & Alonso-Tapia, J. (2013). Self-assessment: Theoretical and practical connotations. When it happens, how is it acquired and what to do to develop it in our students. Electronic Journal of Research in Educational Psychology, 11(2), 551–576.

[https://doi.org/10.14204/ejrep.30.12200]

-

Cha, H., Kye, B., & Jeong, K. (2017). Analysis of impacts of digital-textbooks on learners' self-regulated learning and problem-solving competency. Korean Contents Association Journal, 17(2), 13–25.

[https://doi.org/10.5392/JKCA.2017.17.02.013]

-

Schunk, D. H., & Greene, J. A. (Eds.). (2018). Handbook of self-regulation of learning and performance(2nd ed.). Routledge.

[https://doi.org/10.4324/9781315697048]

Appendix

저자 소개

· 2021년 진주교육대학교 초등교육학과(교육학사)

· 2021년 ~ 현재 의정부교육지원청 동암초등학교 교사

관심분야 : AI교육, 에듀테크, 영재교육

sctclyl00@korea.kr

· 2020년 경인교육대학교 초등교육학과(교육학사)

· 2021년~현재 의정부교육지원청 회룡초등학교 교사

관심분야 : AI 교육, 에듀테크

guswls377@korea.kr

· 2020년 경인교육대학교 초등교육학과(교육학사)

· 2021년 ~ 현재 의정부교육지원청 새말초등학교 교사

관심분야 : AI 융합교육, 에듀테크

limh6350@korea.kr

· 1991년 서울교육대학 초등교육(교육학사)

· 1995년 고려대학교 전자공학 (공학사)

· 2023년 고려대학교 컴퓨터교육학과 (이학사)

· 2024년~현재 남양주다산초 수석교사

관심분야 : 교육과정평가, AI 교육, 에듀테크

E-mail: gfea@gfea.educationr