인공지능 기반 음악 창작 실습 교육 프로그램 평가와 제언

초록

현재 인공지능(AI)을 활용한 교육 프로그램이 다양한 분야에서 개발되고 있으며 음악 분야에서도 그 활용이 빠르게 확산하고 있다. AI와 접목된 음악 창작 플랫폼은 창작 과정에서 새로운 가능성을 열어주고 특히, 음악적 배경이 없는 비전문가들도 창의적 활동을 할 수 있도록 지원하고 있지만, 비전문가들이 ‘음악적으로’ 개입할 수 있는 여지는 굉장히 부분적이다. 개발된 인공지능 기반 음악 창작 실습 프로그램은 음악 비전공자들을 대상으로 하여 진행되었으며 이들이 창작의 주체가 되어 자신의 음악적 아이디어를 실현할 수 있게 하는 점에서 큰 의미가 있다. AI를 활용하여 음악 창작 과정을 더 쉽게 이해하고 몰입할 수 있도록 돕고 교육 사후 조사를 통해 수업의 효과를 평가하였다. 본 교육 프로그램은 학습자들이 AI와의 상호작용을 통해 스스로 음악적 아이디어를 구체화하는 능력을 키우는 데 중점을 두었기 때문에 향후 실습 중심의 창·제작 교육 기획을 위한 기초 자료로 활용될 수 있기를 기대한다.

Abstract

Currently, educational programs utilizing artificial intelligence (AI) are being developed across various fields, and its use is rapidly expanding in the music domain as well. AI-integrated music creation platforms are opening new possibilities in the creative process, particularly by supporting non-experts without a musical background to engage in creative activities. However, the extent to which non-experts can "musically" intervene remains quite limited. The developed AI-based music creation practice program was conducted with non-music majors, and it holds significant meaning in that it enables them to become the main agents of creation and realize their own musical ideas. By utilizing AI, the program helps learners more easily understand and immerse themselves in the music creation process, and the effectiveness of the class was evaluated through post-education surveys. This educational program focuses on enhancing learners' ability to materialize their musical ideas through interaction with AI, and it is expected that it can serve as foundational data for planning future practice-based creative and production education programs.

Keywords:

Artificial Intelligence, Music Creation, Practice Education, Educational Evaluation, Creativity키워드:

인공지능, 음악 창작, 실습 교육, 교육 평가, 창의성1. 서론

테크놀로지의 발달은 음악예술 분야 자체 뿐만 아니라 음악교육의 발전과도 긴밀하게 연관되어 있다[1]. 지난 몇 년 동안 음악 분야에 도입되고 있는 AI 기반 기술들이 고도화됨에 따라 해외 음악교육 전문가들은 미래 교육의 패러다임의 변화를 예견한다[2]. 특히 음악 같은 경우, 악기 연주가 뒷받침되어야 하는 분야이기 때문에 타 예술보다 진입장벽이 높은 편이다. 그러나 AI 기술을 활용하여 이러한 시간적, 기능적 한계를 뛰어넘고 있으며 비전문가가 음악을 창작하고 표현할 수 있는 경로가 제공되고 있다. 인공지능에 적용된 데이터베이스는 작곡가의 전 생애를 통해 축적된 그만의 작곡 양식과 시대적 특징, 사회적 변화를 기반으로 조합된 형태의 작곡 과정을 만들어 내며[3], 엄청난 경제적 가치를 앞세워 다양한 플랫폼에 적용되고 있다.

본 교육 프로그램은 AI 도구를 활용하여 음악 창작의 과정을 단순화하고, 음악에 대한 지식이나 연주 기술이 부족한 비전공자들도 자신만의 음악을 창작할 수 있도록 돕는 것을 목표로 한다. 특히 음악 비전공자 학습자들은 이를 통해 창의적인 가능성을 넓혀갈 수 있으며, 자신의 음악 작업물을 구체화하고 발전시킬 수 있었다. 본 연구를 통해 이러한 교육 프로그램의 설계와 실행 과정을 분석하고, 교육 사후 조사에 대한 참여자들의 의견 평가를 통해 향후 AI 기반 음악 교육의 가능성과 발전 방향을 모색하는 것을 목적으로 한다.

2. 연구 배경

2017년 기계 번역을 수행하는 것에 대하여 트렌스포머 모델이 제시된 이후, BERT, GPT-3 등 자연어 처리(Natural Language Processing, NLP) 관련 모델들이 많이 등장했으며 멀티모달의 접근이 가능해진다[4]. 멀티모달이 발전하면서 텍스트 기능과 더불어 여러 가지 유형의 데이터를 처리하기 시작했고, 이처럼 생성형 인공지능은 대규모 언어 모델(Large Language Model, LLM)과 맞물려 개발된다. 인공지능을 활용하는 서비스나 플랫폼의 입-출력 과정은 대부분 입력단에 사용자의 요청 텍스트가 들어가고 출력단에 결과물이 생성되는 방식으로 사용자의 텍스트가 창작하고자 하는 글, 이미지 혹은 영상의 요소로 매핑되고 있으며 음악도 예외는 아니다.

현재 음악 산업계에 큰 화두로 떠오르고 있는 수노(SUNO)나 유디오(UDIO) 모두 Text to Music 서비스로, 짧은 시간 내에 그럴듯한 음악을 생성해 낸다. 사용자는 음악 장르, 특성, 요소들을 글로 써야하고, 음악 생성 시 가장 큰 요인으로 작용하는 가사에 집중하여 창작활동이 이뤄진다. 이러한 서비스는 음악 창작의 과정을 자동화하고 단순화하는 데 기여하지만, 사용자에게 충분한 창작 가능성을 제공하지 못한다는 한계가 있다. 특히, 음악을 전공하지 않은 비전문가가 텍스트로 음악을 지시하는 과정에서 음악적 표현을 구체적으로 다루기 어렵고, 생성된 음악은 사용자의 의도와 일치하지 않을 가능성도 높으며, 수정이 어렵다. 이것은 사용자와 AI 간의 협업보다는 AI가 주도하는 창작의 형태로 볼 수 있으며, 이는 창작의 본질적인 즐거움과 작업에 대한 효능감을 제한하는 요소가 될 수 있다.

반대로 사용자의 텍스트에 얽매이지 않고, 순수하게 음악 데이터만을 활용하여 수집, 학습, 예측의 과정을 거친 프로젝트들(예를들어, Google의 Magenta 프로젝트나 OpenAI의 Jukebox 등)은 그 기능을 ‘음악적으로’ 충분히 발휘하지 못하거나, 비전공자 대상으로 일반적인 음악 창작의 과정을 보여주기가 어렵다고 판단하여 실습 교육에서 활용되지 않았다. 교육은 학습자들이 AI와의 상호작용을 통해 주체적으로 음악적 아이디어를 구체화하는 능력을 키우는 데 중점을 두었기 때문에 LLM 중, ChatGPT-4o 모델을 중심으로 실습 과정이 설계되었으며 완성형 음원을 출력하는 Text to Music 서비스도 활용되지 않는다.

3. 프로그램 개발

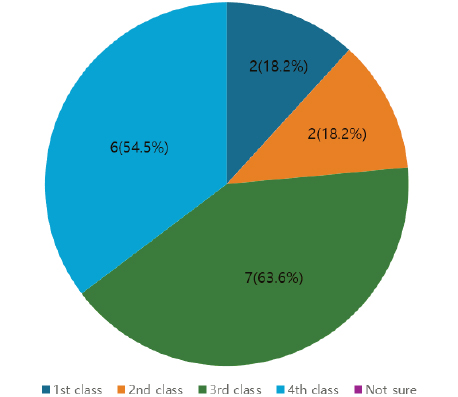

개발된 인공지능 기반 음악 창작 실습 프로그램은 2024년 8월 21일부터 9월 11일까지 매주 수요일, 4회차 동안 진행된 교육으로, 다음의 세 가지의 제약이 있는 12인(음악 비전공자)을 대상으로 한다. 1) 다루는 악기가 없다. 2) 전문적인 DAW(Digital Audio Workstation) 프로그램이 없다. 3) 음악 기초 이론에 대한 개념이 부족하다. 학습 목표는 인공지능과 협업하여 AABA~ 이상의 곡 구조를 만드는 것으로, 음악 작업에 필요한 음악 기초 이론을 다루고 다양한 플랫폼을 활용하여 제작 실습을 병행한다. 음악을 주도적으로 창작할 수 있는 능력을 함양시키기 위해 인공지능 서비스를 창작의 보조적 도구로 활용하는 과정으로 설계되었으며, 전반적인 교육 구성은 다음의 <Table 1>과 같다.

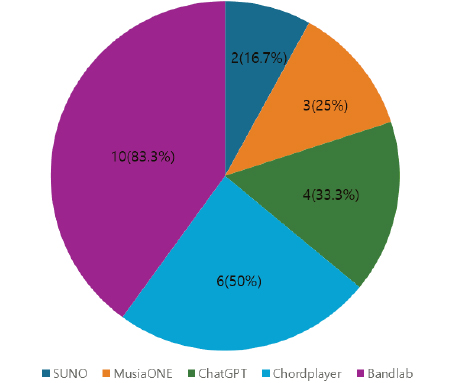

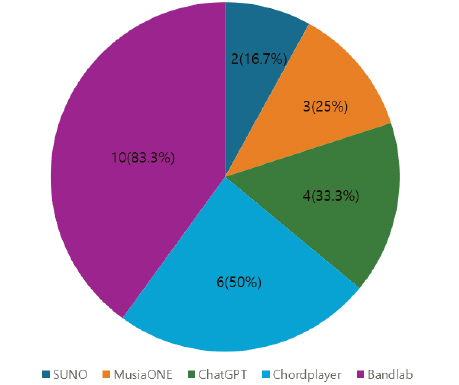

<Table 1>에 따른 차시별 교육 내용은 다음과 같다. 1차시에서 가장 중요한 학습 목표는 음악을 구성하는 MIDI 데이터에 대한 이해이고, 현재 산업에 큰 영향을 미치고 있는 Text to Music에서 SUNO를 간략히 알아보며, 최종 출력의 파일 형태(오디오 파일, 미디 파일) 비교를 통해‘나만의 음악을 만들 때 필요한 MIDI 데이터’의 중요성을 이해하고 A파트를 작업하는 데 필요한 음악 기초 이론을 진행한다. 2차시에서는 총 32마디 작업을 위해 ChatGPT와 대화를 하며 전체 코드(Chords)를 디자인하는 수업이다. 또한 악기를 다루지 못하는 학습자들과 수업하기 때문에 GPT와 대화하면서 생성한 코드를 Chord Player라는 온라인 플랫폼에서 듣고 수정할 수 있도록 한다. 3차시는 본격적으로 DAW를 배우는 차시로, 온라인에서 무료로 활용 가능한 Bandlab을 사용한다. Bandlab에서 제공하는 템플릿 음악을 샘플로 두고 이전 차시에서부터 만들어 온 자신의 MIDI 데이터를 치환하는 과정을 통해 툴을 익히고 음악을 구조화해 본다. 4차시는 본격적으로 자유 창작 시간으로 다양한 툴 기능과 제작 방법을 학습한다. Text to Voice를 통해 노래 가사를 입력하여 보이스를 입히는 작업을 Voxfactory에서 해보고 Bandlab에서 다양한 아이디어를 얻을 수 있는 여러 트랙과 제너레이터(코드, 아르페지오)를 살펴본다. 자유 창작은 지난 시간과 같이 템플릿에 제공된 샘플 곡을 활용하거나 Song Starter 기능을 통해 학습자들 개개인이 원하는 방향으로 이끌고 가보는 실습을 한다. 다음의 <Table 2>는 전체 수업 과정에서 활용된 플랫폼들을 간략히 정리한 것이다.

<Table 2> 표에서 볼 수 있듯이, ChatGPT-4o 모델을 활용하여 음악의 분위기나 코드를 대화로 구성해 나간다는 점은 언어를 활용하여 음악 창작에 접근할 수 있다는 강점이 있기 때문에 음악을 전공하지 않은 일반인 대상으로 적합하다. 다만 교수자는 음악에서 통용되는 단어나 개념을 학습자에게 충분히 설명하고, 개인화된 음악을 설계할 수 있도록 프롬프팅 방식을 제공한다. 1) 조성(Key), 템포(Tempo) 2) 전조 (Modulation) 3) 모달인터체인지(Modal Interchange), 리하모니제이션(Reharmonization) 등 음악의 분위기를 유도할 수 있는 음악적 장치들을 함께 이해하고 프롬프팅에 적용한다.

음악은 악기 연주가 기본이 되어야 하므로 오랜 시간이 투자되어야 하는 예술이지만, 그것의 한계를 보완하기 위해 Musia One, Chord Player 같은 툴이 활용된다. Musia One은 인공지능이 도입된 온라인 프로그램으로 비트(Beat), 멜로디(Melody), 리듬(Rhythm), 코드(Chords)를 제공한다. Chord player 같은 경우, 인공지능이 도입된 프로그램은 아니지만 사용자가 쉽게 코드를 디자인 할 수 있으며, 다양한 반주법으로 음악을 재생시킨다. 따라서 두 프로그램 모두 악기 연주를 못하는 학습자를 대상으로 ‘미디 데이터’를 얻어 음악 소스로 활용하기 위해 활용되었다.

전체 실습 과정은 온라인 공유 플랫폼을 통해 기록되며, 총 4차시의 과정은 일련의 음악 작곡 과정을 경험하게 한다. 이러한 공유 플랫폼을 활용하여 교수자는 차시별로 학습자의 참여도나 진행 상황을 파악할 수 있으며 개인 프로젝트 진행에 맞춰 코멘트를 주고 구체화 되는 과정을 돕는다. 다음의 <Figure 1>은 학습자들끼리의 작업 과정이 공유된 자료이며, 전반적인 작곡의 과정을 담고 있다. <Table 3>에서는 어떠한 플랫폼과 연계되어 전반적인 작곡의 과정(기존 곡 탐색 – 작업 착수 및 표현 감정 – 초안/디벨롭 – 구체화)이 어떤 회차에서 어떠한 툴을 활용하여 시도되었는지 볼 수 있다.

4. 평가 내용 및 결과

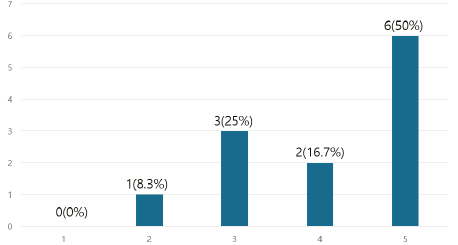

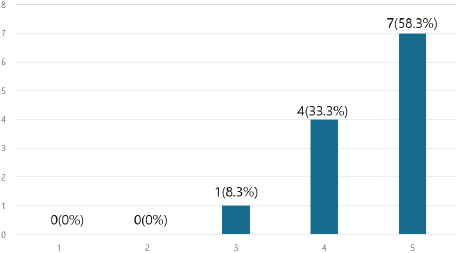

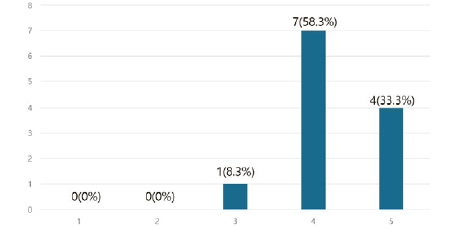

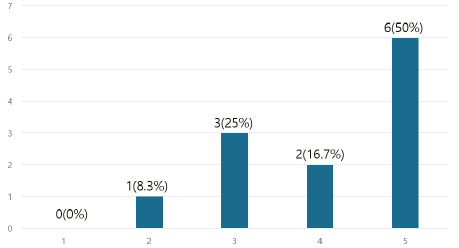

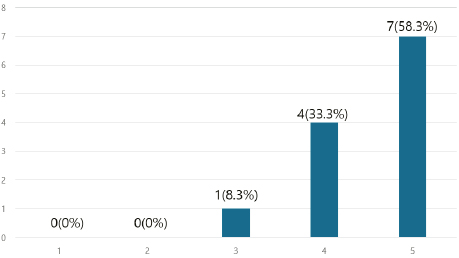

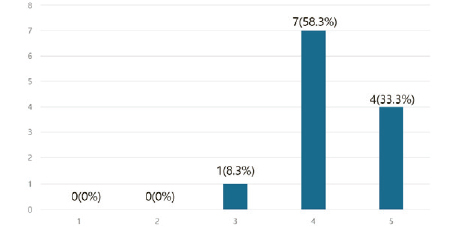

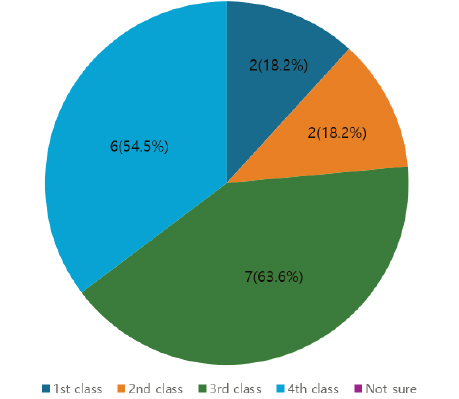

다음의 <Table 4>는 설문 조사의 평가 항목이며, 각 항목은 수업에서 배운 툴에 대한 향후 활용 가능성과 인공지능에 대한 전반적인 의견을 서술하는 방식으로 구성된다. 특히 본 수업을 통해 음악 창작의 즐거움 혹은 만족감을 느낄 수 있었는지, 있었다면 어느 차시에서 가장 만족감이 컸는지를 조사한다. <Table 5>는 주요 문항(2, 4, 7, 9, 10)에 대한 결과로, 이를 통해‘음악 창작의 즐거움’을 어느 차시에서 느낄 수 있었는지 파악하고 어떠한 요인으로 그러한 결과가 나왔는지 유추하고자 한다.

결과에 따르면, 학습자들은 전반적으로 인공지능을 활용한 음악 창작 과정에 대해 대체로 긍정적인 반응을 보였다. 특히, 비전공자 대상으로 한 수업에서는 음악적인 기초 지식이 없어도 결과물을 쉽게 만들어낼 수 있는 것과 시간과 비용을 절감하여 실제 작업에 대한 전반적인 과정을 경험한 것에 만족감이 컸다. 또한 다양한 온라인 무료 플랫폼을 통해 실습이 진행되기 때문에 컴퓨터 활용 능력에 따라 수업을 받아들이는 정도가 달라졌으며, 이것은 창작의 즐거움/만족도 결과로 이어졌다. ChatGPT와 대화하며 코드를 디자인하고 Chord player에서 수정해 나가는 과정보다 Bandlab에 개별 트랙과 악기 소리 변형을 통해 음악 전개나 구조, 음색적인 것을 제어할 때 ‘음악 창작의 즐거움’을 느낀다고 대답했으며, 이것은 즉각적으로 변화한 것을 들을 수 있는 것과 아닌 것의 차이점이 작용했다고 볼 수 있다. ChatGPT로 생성한 코드는 Chord player에서 옮겨 들어야 하는 과정에 있어 음악적인 감각, 감정적인 교류가 한번 끊기는 데 반해, Bandlab에서 하는 실습 과정들은 ‘사용자의 조작에 따라 음악이 실시간으로 변화하고 있음’을 즉각적으로 감지할 수 있으며, 이것이 학습자들에게 창작 과정의 즐거움을 느끼게 한 요인으로 작용한 것으로 보인다.

5. 결론

음악교육에서 제공되어야 할 것은 음악 이론이나 규칙이 아니라 초보자들이 음악적 구조를 보다 잘 인식할 수 있게 하는 구조화된 경험의 순차적 배열이다[5]. 본 수업에서는 음악적 경험이 전혀 없는 사람들을 대상으로 실습 교육이 진행되기 때문에 다양한 소프트웨어를 활용하는 만큼 사용자들에게 ‘지금 단계에서 이 소프트웨어를 왜 사용해야 하는지’에 대한 이해가 중요하다. 음악 비전공자를 대상으로 인공지능을 활용하여 창작활동을 하는 것은 큰 비용과 더불어 긴 시간이 투자되어야 하는 것들에 대한 제약을 뛰어넘게 한다. 그러나 인공지능을 어떠한 수준의 사용자가 어떠한 방식으로 활용하느냐에 따라 결과물의 수준이 달라지며, 사용자에게 피드백되어 돌아오는 영향은 ‘적은 비용과 시간’이라는 장점을 가지고 단순하게 긍정적으로만 생각할 수 없는 문제이다.

결과적으로 이번 수업을 통해 학습자들에게 창작적 성취감을 제공할 때 고려해야 하는 점들을 다음과 같이 세 가지 요소로 정리할 수 있다. 1) 학습자들의 컴퓨터 활용 능력 2) 사용자와 예술 매체의 실시간 상호작용 정도: 활용 도구의 접근성 및 직관성 3) 교수자 – 학습자 간의 즉각적인 피드백은 학습자들이 창작적 성취감을 느낄 수 있도록 하는 중요한 기반을 마련하며 향후 창작 교육 프로그램 설계 시 참고될 수 있다. 인공지능을 창작의 보조적 도구로 활용하고, 인간이 창작의 주체가 되어 능동적인 탐색을 끌어내는 데는 단순한 기술 습득, 플랫폼, 툴 사용 방식에 대한 설명을 넘어 학습자가‘주도적으로’ 무언가를 만들어 내려는 과정이 중심이 되어야 한다. 앞으로의 ‘인공지능 + x 교육 프로그램’은 이러한 접근 방식을 강화하여 더 개개인의 창의성을 배양하고 창작적 성취감을 경험할 수 있도록 세 가지 요인을 고려하여 설계해야 할 것이다.

기계로 만들어진 미술, 문학, 음악에 종사하는 이들의 궁극적인 목표는 지금까지 알려진 인간이 만든 장르나 인간의 상상을 뛰어넘는 작품을 창조하는 것이다[6]. 그러나 기존 데이터가 무엇보다도 중요한 요소로 작용하는 인공지능의 작동 방식을 벗어나지 않는다면, ‘적어도 음악 분야’에서 완전히 새로운 것을 창작하는 것에 대한 한계가 지속될 것으로 보이며 ‘완전히 새로운 것’을 창작했더라도, 인간이 그러한 결과물을 심미적, 예술적, 감각적으로 수용할 수 있는지가 큰 관문이다. 따라서 인간 학습자의 창의성을 부각하여 주도적으로 무언가를 만들어가나는 능력을 함양시켜야 하며, 궁극적으로 인공지능과 협업하는 프로세스를 익혀 나가는 것이 무엇보다도 중요하다.

References

- Choi, E.. Choi, M.. & Moon, K.. (2014). The Historical Developments of Technology in Music Education: Based on the Related Literatures in MEJ. Journal of Music Education Science, 20(2). 17-38. G704-002202.2014..20.002

- Oh, H.. Lee, D.. Ahn, C.. kwak, D.. Chun, H.. & Won, W.. (2022). AI and posthumanist aesthetics in music. Monopoly. ISBN 9788991952690

-

Yun, G. (2021). A Study of Teaching Instruction for Creative Music Class in Music Subjects using Artificial Intelligence(AI). Journal of Educational Research, 80(18). 369-385.

[https://doi.org/10.17253/swueri.2021.80..018]

- Park, J. (2022, December 21). About Transformer and Multimodal. Tech Blog of Junyoung. Retrieved from https://junia3.github.io/blog/trnmultimodal

- Holland, S. (2000). Artificial Intelligence in music education: A critical review. Contemporary Music Studies, 20.

-

Miller, A. I. (2019). The Artist in the Machine: The World of AI-Powered Creativity. The MIT Press.

[https://doi.org/10.7551/mitpress/11585.001.0001]

Appendix

저자 소개

· 2015년 숙명여자대학교 음악대학 작곡전공(학사)

· 2018년 동국대학교 멀티미디어학과 컴퓨터음악(석사)

· 2020년 동국대학교 멀티미디어학과 컴퓨터음악(박사수료)

· 2020년 ~ 현재 아트센터나비미술관 교육팀 연구원

관심분야 : 인공지능, 음악, 멀티미디어, 미디어아트

ehrud131@naver.com