생성형 인공지능의 연령별 등급제한 필요성과 기준 제안

초록

생성형 인공지능이 제공하는 콘텐츠가 실시간으로 달라지는 특성 때문에, 출시 시점에 심사하는 전통적인 완성형 콘텐츠(영화, 게임 등)의 등급 분류 체계만으로는 미성년자를 충분히 보호하기 어려운 실정이다. 본 연구에서는 생성형 AI에 특화된 등급 분류 체계를 마련하기 위하여 완성형 콘텐츠 등급 분류 체계를 참고하되, 전문가 심층 면접(FGI)을 통해 5개의 연령 구간과 14개의 분류 항목을 도출하였다. 설문조사를 통하여 기술통계분석, 상관분석을 진행하여 생성형 AI 등급 분류 체계를 검증하여 제안하였다. 이 기준은 기존의 허락되지 않은 미성년자에 대한 전면 금지 규제와 비교해 점진적 허용을 통한 접근성을 높이는 방법으로 규제를 완화하는 차별점을 가지고 있다. 이를 활용하여 미성년자를 보호하고 AI 기술이 사회적으로 적용 가능한 방향으로 발전할 수 있는 정책·기술적 함의를 제안하며, 향후 실제 서비스 환경에서 이 기준을 적용하기 위한 기술 개발 연구 및 제도적 입법 논의에 출발점이 될 수 있다.

Abstract

Because the content generated by Generative Artificial Intelligence changes in real time, it is difficult to adequately protect minors using only the traditional rating classification system—designed for completed content such as films and games, which is assessed at the time of release. In this study, in order to establish a rating classification system specialized for Generative AI, we referred to existing rating systems for completed content while conducting in-depth expert interviews (FGI). Through this process, we derived five age groups and fourteen classification items. Through a survey, we conducted descriptive statistical analysis and correlation analysis to validate and propose a generative AI rating classification system. Compared to the previous regulation, which imposed a blanket ban on minors without permission, this standard distinguishes itself by gradually allowing access, thereby easing restrictions and improving overall accessibility. Building on this, we suggest policy and technical implications for protecting minors and guiding the development of AI technology in a socially acceptable direction. It can also serve as a starting point for future technology development research and institutional legislative discussions to apply the guidelines in real-world service environments.

Keywords:

인공지능, 생성형 AI, 연령별, 제한, 미성년자, 콘텐츠키워드:

Artificial intelligence, generative AI, age, restrictions, minors, content1. 서론

최근 인공지능(AI) 기술 중 하나인 생성형 AI(Generative AI)가 빠른 속도로 발전하면서, 글·그림·영상·음성 등 다양한 양질의 콘텐츠를 비전문가가 실시간으로 대량 생성·공급하는 사례가 늘어나고 있다. 이러한 기술 발전은 사용자에게 창의적인 아이디어를 제공하거나 생산성을 높이는 등 긍정적인 효과를 가져온다. 하지만 동시에, 생성형 AI가 만들어낸 콘텐츠가 일부 사용자(특히 아동·청소년)에게 유해(모방 위험, 선정성, 심리적 영향, 신뢰 인증 등)하게 작용할 가능성도 함께 커지고 있다[1-4].

전통적인 완성형 콘텐츠(영화, 게임, 만화, 도서 등)는 콘텐츠가 완성된 이후 관련 법령을 기준으로 사전 심의를 거쳐 등급이 부여되므로, 연령별 또는 이용 환경별로 제한을 두는체계가 비교적 확립되어 있다[5, 6]. 반면 생성형 AI는 사용자의 입력과 모델 학습 데이터에 따라 결과가 실시간으로 달라지므로, 기존의 일회성 심의·분류 방식만으로는 부적절한 콘텐츠 노출을 효과적으로 막기 어려운 실정이다[7].

세부적으로는 미성년자의 생성형 AI 사용을 제한하는 기준은 있지만, 점진적 허용에 관련된 해외 및 국내의 규제 제도와 연구자료를 거의 찾아볼 수 없는 상황이다. 이에 본 연구는 생성형 인공지능 사용자 규제가 미성년자를 효과적으로 보호할 수 있도록, 규제에 관한 정책적 관점을 제시하려는 목적에서 기획되었다. 이하에서는 우선 논의의 출발점으로서 생성형 AI의 연령별 등급 제한 필요성에 관해 살펴보고, 기존 완성형 콘텐츠 등급제도의 사례와 관련 법·제도(국내외)를 검토하고, 생성형 AI의 특성을 반영한 새로운 연령별 등급제한 기준을 제안하고자 한다.

2. 이론적 배경

2.1 생성형 AI 현황

생성형 AI란 학습데이터를 기반으로 사용자의 요구사항에 따라 글, 그림, 음성, 영상 등 다양한 형태의 콘텐츠 산출물을 짧은 시간에 대량으로 생성할 수 있는 기술이다[8, 9]. 이는 날씨예측이나 이미지 분류 등 특정 기능만을 수행하는 AI 모델들과 구별되는 개념이다[10]. 생성형 AI는 사용자가 요구한 산출물을 생성하기 위해 스스로 데이터를 찾아서 학습하고 이를 조합하여 결과물을 제시한다[11]. 이를테면 자연어처리 분야에서는 대규모 언어 모델(Large Language Models)을 통해 질문에 대한 답변이나 새로운 글을 생성(ChatGPT 등)할 수 있다[12]. 그림분야 또한 딥러닝 기반으로 예술 작품이나 만화, 사진과 유사한 이미지를 만들어내는 모델(Midjourney 등)이 존재한다[13]. 음성 분야에서는 학습된 사람의 음성을 모방하여 주어진 텍스트를 읽거나, 제공된 가사에 어울리는 장르의 음악을 작곡(AIVA 등)한다[14]. 영상 분야에서는 샘플 이미지와 텍스트로 장면을 설명하여 스토리보드 작성하면, 이를 준수하여 영상을 제작(Pictory 등)한다[15].

2.2 완성형 콘텐츠 연령별 등급 제한 동향

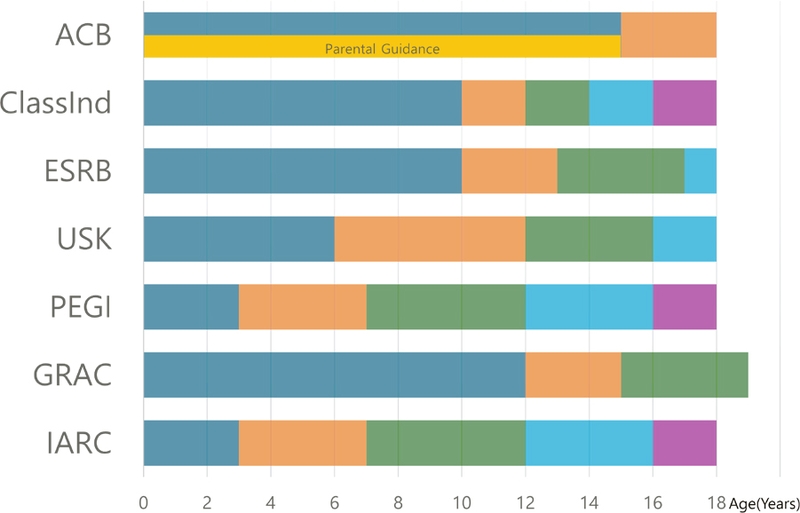

완성형 콘텐츠의 연령별 등급 제한 제도는 이미 국내외에서 오랜 역사를 지니고 있다. 한국의 경우 영화·비디오물은 영상물등급위원회(KMRB)에서, 게임은 게임물관리위원회(GRAC)에서 각각 등급을 분류한다[16, 17]. 미국은 Motion Picture Association(MPA)과 Entertainment Software Rating Board(ESRB)를 운영 중이다[18, 19]. 브라질에는 Brazilian advisory rating system(ClassInd)에서 영화, 게임, TV 프로그램을 분류하고 있다[20]. 호주에서는 Australian Classification Board(ACB), 캐나다에서는 Entertainment Software- Rating Board(ESRB), 독일에서는 Unterhaltungs Software Selbstkontrolle(USK), 유럽과 이스라엘에서는 Pan-European Game Information(PEGI)가 담당하며, 국제적인 게임 등급 기준으로는 INTERNATIONAL AGENCY FOR RESEARCH ON CANCER(IARC)도 사용된다[21-24]. Fig. 1은 기관별 콘텐츠 제한 기준 중 일부를 연령 범위로 색상을 구분하여 나타낸 것이다.

대부분 18세를 기준으로 완성형 콘텐츠를 제한하고 있지만, 한국(GRAC)의 경우 19세를 기준으로 하고 있음을 볼 수 있다. 고등학교 졸업 기준(19세)과 동일한 것으로 확인할 수 있는데, 최근 투표권 등을 만18세 기준으로 부여하는 것 보면 해당 나이에 합리적 의사 표현이 가능하다고 인정하고 있기에, 한국도 18세 기준으로 변경될 여지가 있다[25]. 특이한 점은 ACB의 경우 첫 등급이 15로 매우 넓은 편인데, 보호자의 관리가 필요한 콘텐츠와 그렇지 않은 콘텐츠로 명확하게 구분하여 규제하는 것을 볼 수 있다. 이들 제도는 완성된 콘텐츠를 배포 이전에 정해진 기준으로 심의하여 연령별 이용에 대한 허용·제한을 결정한다. Table 1은 다양한 기관별 2개 이상 중첩되는 항목들을 표로 나타낸 것이다. 체크가 되지 않은 분야도 대부분 유사한 항목에서 내포하여 점검하고 있다.

2.3 생성형 AI 규제 동향

생성형 AI에 대한 제한의 공통적 특징은 허가와 금지로만 구분되는 것에 있다. 미국의 경우 아동 인터넷 개인정보보호법(COPPA)에 따라 만 13세 미만 어린이들은 사용이 제한되며, 만13세 이상, 18세 미만의 학생은 부모 혹은 법적 보호자의 동의하에 사용할 수 있어서 대부분의 생성형 AI 서비스 제공 기업들은 이를 약관에 표시하고 있다. 우리나라는 생성형 AI 이용지침, 생성형 AI 윤리 가이드북, 생성형 AI 윤리 가이드라인 등을 제작하여 허가받지 못한 미성년자의 사용 제한을 안내하고 있다[26-28]. 이와 관련하여 한국지능정보사회진흥원에서는 분기마다 지능정보 윤리 리포트를 발간하여 지속적인 관심을 나타내고 있다[29]. Table 2는 생성형 AI 서비스 제공 기업별 미성년자 사용 기준을 정리한 것이다.

3. 생성형 AI 연령별 등급 제한 기준 연구

3.1 연구 방법

생성형 AI 연령별 등급 제한 기준을 연구하기 위하여 국내외 완성형 콘텐츠 연령별 등급 제한 기준, 연구기관의 연구 보고서, 관련 학술지 논문, 서비스 제공 기업 약관, 관련 사례 분석 등을 바탕으로 생성형 AI가 미성년에게 미칠 수 있는 위험성과 악영향을 분석하였다. 분석을 통하여 정리된 내용을 중심으로 10인의 전문가 심층 면접(FGI: Focus Group Interview)을 2차에 거처 진행하였다. FGI는 대면 및 비대면으로 진행하였다.

FGI를 통해 최종적으로 도출된 미성년자 보호를 위한 생성형 AI 사용을 제한하는 5개의 연령 구간과 14개의 분류 항목에 대한 상관관계를 검증하기 위해 41명의 이해 관계자를 대상으로 설문 조사를 진행하였다. 설문 조사를 활용하여 기술통계분석(Descriptives), 분류 항목별 상관분석(Correlation Analysis) 등을 진행하여 제안한 기준을 복합적으로 검증하고자 하였다.

3.2 전문가 심층 인터뷰(FGI)

전문가 심층 인터뷰에 참여한 전문가는 총 10명이었으며, 2차에 거쳐 의견을 수렴하고 분류하여 기존 기준을 도출하였다. 참여한 전문가는 이 연구에 이해 관계자로 AI분야 박사 3명, AI 분야 박사과정 2명, AI융합교육 석사학위 취득 교사 3명, 학부모 2명으로 구성하였으며 세부 정보는 Table 3과 같다.

1차 전문가 심층 인터뷰에서는 국내외 완성형 콘텐츠 연령별 등급 제한 기준을 각 기관에서 제공하는 문서를 정리하여 설명하였다. 또한 생성형 AI가 완성형 콘텐츠 등급제한 기준을 적용할 수 없는 이유를 관련 문헌 분석 결과를 바탕으로 설명하고, 새롭게 제안하는 생성형 AI 연령별 등급 제한 기준과 항목을 배포한 뒤 기준에 문제점과 가능성, 고려사항 추가 항목 등을 도출하였다. 도출된 연령 범위는 7세~11세, 12세~15세, 16세~17세 18세 이상으로 IARC(국제 연령 등급 연합)의 연령 범위를 준용하기로 하였으며, 세부 항목은 기존 항목들을 종합하여 선정성, 폭력성, 공포, 약물, 언어, 모방위험, 노출, 범죄, 사행성 등을 기본으로 하고 추가로 생성형 AI 규제에 필요하다고 생각되는 차별, 사용자 정보 수집, 심리적 영향(가치관 변화)등을 도출하였다. 또한 생성형 AI를 미성년자가 사용하기 위해서는 사전에 위험성 및 올바른 활용에 대한 교육이 필요하다고 의견을 모았다. 규제 방법은 기준에 일치하는 생성형 AI를 개발하는 것은 지양하고, 프로그램은 범용으로 사용하되 용도에 맞는 검증된 데이터를 학습하거나, 산출 콘텐츠를 생성하는 시점에서 사용자의 연령에 맞는 기준의 콘텐츠를 생성하는 메커니즘을 개발사가 추가한 것을 점검하는 방식을 도입하기로 하였다.

2차 전문가 심층 인터뷰는 1차 인터뷰 결과를 사전에 배포한 후 진행하였다. 1차 때 연령 범위 외에 교육적, 문화적, 보안적, 역사적 등의 사유로 보호자의 동의가 있을 때 콘텐츠 생성에 대해 규제 예외를 적용하고자 하였는데, 인터뷰 결과 노출, 범죄, 차별, 사용자 정보 수집에 항목에 대해서는 예외를 두지 않기로 의견을 모았다. 사행성, 차별, 범죄, 폭력성은 나이별 제한 기준이 너무 관대하다고 판단되어 더욱 엄격하게 변경하였다. 그리고 생성형 AI의 고질적 문제인 환각에 대하여 비판적 사고가 없는 미성년자를 위해 신뢰 인증(출처 표기)을 항목에 추가하기로 하였다. 대체 적으로 학생 집단은 규제 완화를, 교사와 부모집단은 규제 강화를 요구하였으며, 이를 통해 규제의 영향을 받는 집단 간에 이해충돌이 생기는 것을 알 수 있었다. 특히나 교육청 지원으로 인공지능융합교육 석사학위를 취득한 교사 집단이 인공지능이 효과를 많이 경험한 만큼 위험성도 크게 인지하고 있어서 매우 엄격한 규제 강화를 요구하였다. Table 4 는 이를 정리한 표이다. 세부 의견으로는 연령별 규제가 아닌 인지발달 수준에 맞는 분류 기준을 추가하자는 의견이 있었으나 나이와 다르게 인지발달은 변화가 개별적 특성에 따라 다르기에 사용 때마다 검사해야 하는데, 효율적 어려움이 크다고 토의를 통해 판단되어 반영하지 않았다.

4. 설문조사 분석

4.1 조사 방법 및 대상

설문조사를 위한 문항은 전문가 심층 인터뷰에서 정리된 생성형 AI 연령별 등급 제한 기준을 검증 가능하도록 구성하였다. 미성년자 제한 연령 기준 구간을 7세, 12세, 16세, 18세로 하고 예외 조항을 포함하여 선정성, 폭력성, 공포, 약물, 언어, 모방위험, 노출, 범죄, 사행성, 차별, 사용자 정보 수집, 심리적 영향, 신뢰 인증, 사용료 등 14가지 분류 기준에 대한 적합성을 5점 척도(매우 그렇지 않다, 그렇지 않다, 보통, 그렇다, 매우 그렇다.)로 4점 이상일 경우 긍정 평가를 의미하는 것으로 구성하였다. 분류 별 연령 구간에 따를 기준에 대한 설문 결과를 상관관계 분석과 요소별 기술통계를 분석할 수 있도록 분리하여 진행하였다. 조사 대상은 인공지능 분야 전문가집단, 교사, 학부모를 고르게 선정하여 설문하였다.

설문에 참여한 인원은 총 41명이며 인구통계학적 특성은 Table 5와 같다. 40대가 52.2%로 가장 많고, 생성형 AI 활 용도는 67.4%가 주 1시간 이상을 사용하고 있었으며, 9.8% 주 5시간 이상을 사용하고, 25.8%는 유료로 사용하는 생 성형AI 서비스가 있었다. 80%가 업무에 활용하고 있었고, 53.7 %는 일상생활에도 사용하고 있었다. 설문 참여자 중 사용하지 않는 비율은 단지 12.2%만 나타나는 것을 보면 생성형 AI가 우리 일상생활에 매우 밀접해졌다고 판단된다.

4.2 구성요소별 기술통계 분석

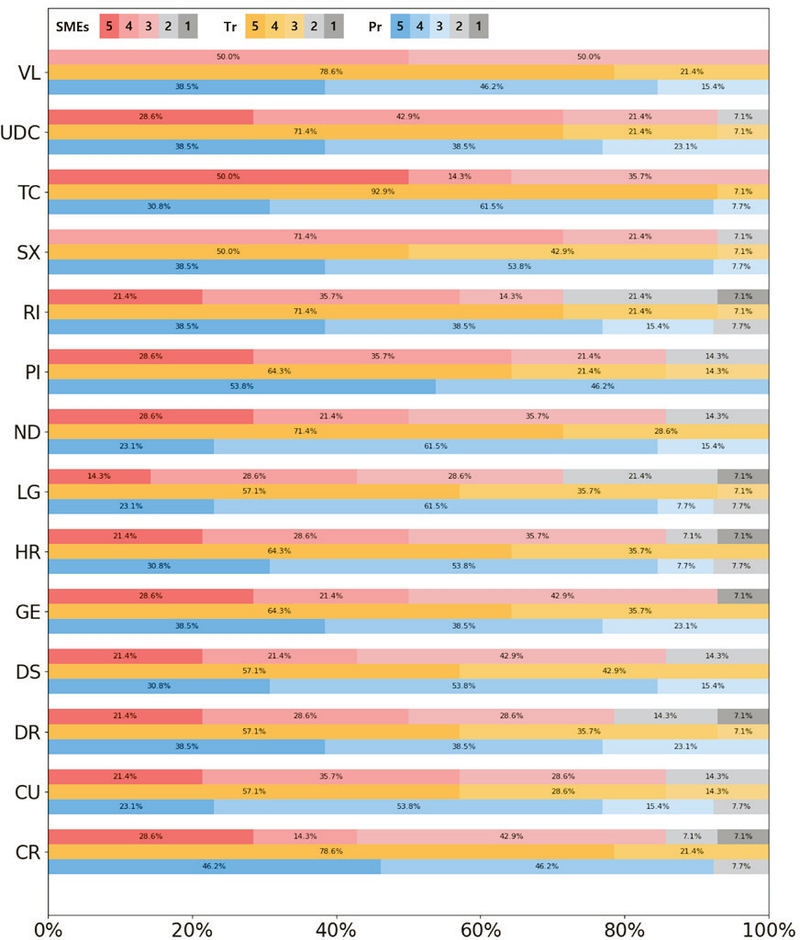

그룹별 최소 유의미한 CVR 값은 전체(41명) 0.297, 전문가(14명) 0.571, 교사(14명) 0.571, 학부모(13명) 0.538로서 해당 값 이상일 때 유의미하다고 볼 수 있다[30]. Table 6의 결과를 확인해 보면 전체적으로 유의미한 CVR 값과 평균값(4.0 이상)을 나타내고 있다. Fig. 2의 항목별 그룹 평가(1:매우 그렇지 않다 ~ 5: 매우 그렇다) 결과 비율(%)을 연관 지어 보면 전문가집단의 부정적 평가로 표준편차가 발생하고 있고, 다른 집단은 표준편차가 비교적 낮아서 일관성을 유지하고 있다. 그룹별로는 교사그룹이 가장 높은 긍정 응답을 보이며, 학부모 그룹이 다음으로 높은 긍정 응답으로 교사그룹과 유사한 견해를 가지고 있다. 전문가집단은 전반적으로 긍정 응답이 낮으며, 항목에 따라서는 부정적인(음수) 경향을 보인다. 이는 해당 항목에 보통 이하를 응답한 응답자가 더 많다는 것을 의미한다. 전문가집단에는 해당 분야 연구자와 개발자가 포함되어 있는데, 규제의 신설은 자칫 발전을 저해하는 요인이 될 수 있기에 부정적인 결과가 나온 것으로 분석되었다.

4.3 표본 적합도 및 신뢰도 분석

Table 7과 같이, 데이터의 표본 적합도 및 신뢰도 분석을 하였다. KMO(Kaiser-Meyer-Olkin)는 0.82로, 데이터가 요인 분석에 매우 적합함을 나타낸다. 등분산 검정(Bartlett’s Test)결과 p-value ≈ 0으로, 유의수준(0.05)을 만족함으로 변수 간 상관관계가 유의미하게 존재함을 알 수 있다. 마지막으로, 신뢰도 분석(Cronbach’s Alpha) 결과는 0.95로, 매우 높은 수준의 신뢰도를 나타내며, 데이터 항목 간 응답이 일관성 있게 나타났다.

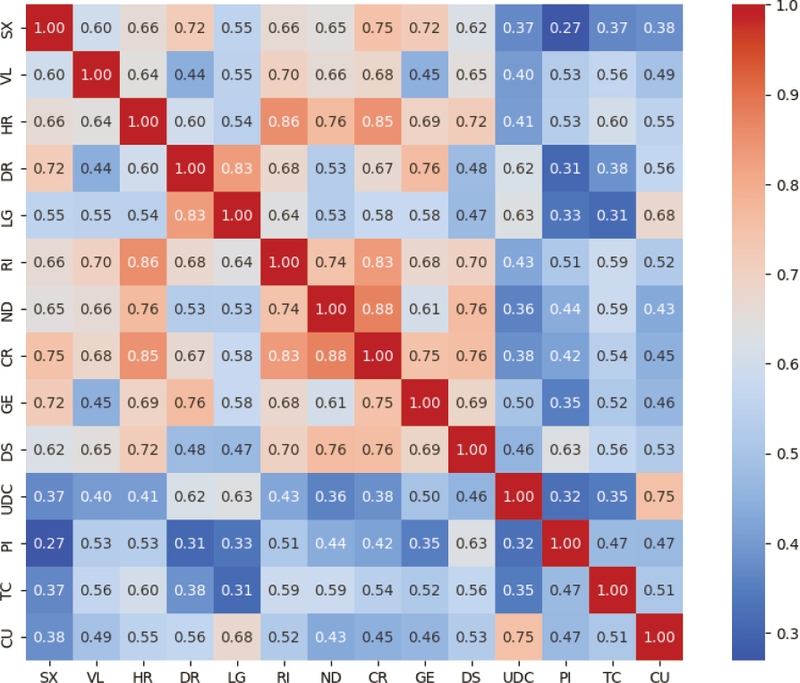

Fig. 3 상관관계 히트맵의 주목할 만한 점은 범죄(CR)는 누드(ND)와 0.88, 선정성(SX) 및 도박(GE)과 0.75로 상관관계가 높으며, 이것으로 범죄와 누드, 성적, 도박 콘텐츠를 비슷한 유해요소로 판단하는 경우가 많음을 알 수 있다. 사용자 데이터 수집(UDC)과 사용료(CU)도 0.75의 상관관계를 보이는데 사용료를 납부받기 위해서 사용자 정보를 입력해야 하는 과정 때문에 동일시되는 것으로 해석된다.

4.4 연구결과

생성형 AI 기술이 급속도로 발전하면서 사용자에게 창의적인 아이디어를 제공하거나 생산성을 높이는 긍정적인 효과를 가져오고 있으나 아직 보호가 필요한 미성년자에게 규제 없는 콘텐츠 생산은 여러 위험성을 가지고 있다. 완성형 콘텐츠 제도의 연령 등급 제한 제도를 사용하고자 하지만 생성형 AI의‘실시간 유동적 콘텐츠 생성’이라는 특징 때문에, 출시 시점의 검증만으로는 유해 정보 노출을 막기 어렵다. 따라서 다층적 접근(학습 데이터 → 모델 접근 → 질문 입력 → 생성 결과 검수)이 필수적이며, 이 과정에서 기술적·법적 기반이 마련되어야 한다. 본 연구는 다양한 기관의 완성형 콘텐츠 연령 등급 제한 기준을 기반하여 국내 외 생성형 AI 사용 가이드라인, 정책, 사용지침, 논문 등 다양한 문헌을 분석하여 미성년 사용자 보호를 중심으로 자료 분석과 2차의 FGI와 델파이 설문조사를 실시하여 기술 통계 분석, 요인 분석, 표본 적합도 분석, 신뢰도 분석, 상관관계 분석 등을 통해 생성형 AI 연령별 등급 제한 기준을 개발하였다. 전문가 심층 인터뷰와 설문 조사를 통해 완성된 AI 연령별 등급 제한 기준은 5단계의 연령 구간에 14개의 항목으로 구성되었다.

5. 결론

본 연구는 완성형 콘텐츠 등급제도를 기반으로, 생성형 AI의 특성에 맞게 연령별 등급제한 기준을 새롭게 구성하고 제안하였다. 선정성, 폭력성, 공포, 약물, 언어, 모방위험, 노출, 범죄, 사행성, 차별, 사용자 정보 수집, 심리적 영향, 신뢰 인증, 사용료 등 14개 항목을 마련하고, 미성년자의 연령은 7세, 12세, 16세, 18세 구간으로 분류하여 각각 제한 기준을 두는 방식으로 세분화하였다. 이를 통하여 생성형 AI에게 요청한 콘텐츠가 생성되는 시점에 검수 절차를 실행하여 사용자의 기준에 따라 필터링하거나 재생성 요청 혹은 공개 제한을 하는 구조로 콘텐츠 결과물을 제공하는 것으로, 동일한 생성형 AI 모델의 프로그램이라도 성인에게는 최상의 성능과 표현의 자유를 제공하고, 미성년자에게는 점진적인 보호 기능을 제공하여 바람직한 생성형 AI 생태계를 구축하려는 시도이다.

그러나 본 연구는 설문조사 참여자와 반복 횟수가 부족하고, 기준을 준수하는 실제 검증 프로그램을 제작하여 테스트를 진행하고 결과를 분석하는 과정을 하지 못해 실제 적용되었을 때 다양한 상황에 대응이 다소 부족할 수 있는 완성도를 가진다고 할 수 있다. 규제 기준에 관한 연구이지만 대상자인 미성년자의 의견이 반영되지 못했다는 것도 미흡한 부분이다. 후속 연구에는 실제 생성형 AI 서비스에서 연령별 필터링 알고리즘을 적용하여 다양한 연령대 다수 사용자를 대상으로 콘텐츠 제작 경험을 조사하여 통계적 근거를 제시하는 연구를 진행해야 한다. 법·제도적 환경에서도 본 기준을 적용하려면 더 구체적이고 세분화시킨 기준이 추가로 필요하다.

그럼에도 불구하고 본 제안은 기존의 허가 및 금지로만 제한하는 일괄적 규제 방식에서 벗어나, 연령별로 점진적 허용 기준을 확대하여 미성년자의 활용 가능성을 높이고자 한다. 이는 생성형 AI 시대에 필요한 새로운 차원의 등급제도에 대한 기반을 마련했다는 데 의의가 있다. 향후 후속 연구를 통하여 AI 기업, 정부기관, 학계, 시민단체가 협력하여 유해 콘텐츠 방지와 창의적 활용이 균형을 이룰 수 있는 체계를 확립해 나가길 기대한다.

References

- Oh, D. H. (2024, April 27). An AI that keeps beating around the bush, but eventually reveals how to make a bomb. newsis. https://www.newsis.com/view/NISX20240415_0002700345

- Jeong, J. J. (2024, May 30). Since early last year, the use of AI-generated images in spreading false information has surged. KBS news. https://news.kbs.co.kr/news/pc/view/view.do?ncd=7975913

- Choi, J. M. (2025, January 2). Can It Even Control Human Decision-Making?... How Advanced Will AI Be in 2025?, wikileaks-kr. http://www.wikileaks-kr.org/news/articleView.html?idxno=161894

- Park, B. G. (2025, January 30). Shocking Photo Turns Out to Be Me... The Culprit Was Just a Teenager. herald. https://biz.heraldcorp.com/article/10407820

- Ministry of Culture, Sports and Tourism. (2024, October 22). Game Industry Promotion Act (Act No. 20485, Partially Amended).

- Ministry of Culture, Sports and Tourism. (2024, May 1). Act on the Promotion of Films and Videos (Act No. 19800, Partially Amended on October 31, 2023).

- Kim, B. Y. (2024). Legal Issues and Regulatory Discussions in Generative AI. Informatization Policy Academic Journal, 31(3), 3–33.

-

Feuerriegel, S., Hartmann, J., Janiesch, C. et al. (2024). Generative AI. Bus Inf Syst Eng, 66(1), 111–126.

[https://doi.org/10.1007/s12599-023-00834-7]

-

Jovanović, M. & Campbell, M. (2022). Generative Artificial Intelligence: Trends and Prospects, Computer, 55(10). 107-112.

[https://doi.org/10.1109/MC.2022.3192720]

-

Hacker, P., Engel, A. & Mauer, M. (2023). Regulating ChatGPT and other large generative AI models. Proceedings of the 2023 ACM Conference on Fairness, Accountability, and Transparency.

[https://doi.org/10.1145/3593013.3594067]

- Yang, J. & Yoon, S. (2023). Going beyond ChatGPT to the era of Generative AI: Media and Content Generative AI Service Case and How to Secure Competitiveness. Media Issue & Trend Domestic Report, 55, 62-70. https://www.kca.kr/Media_Issue_Trend/vol55/KCA_ebook/index.html

- OpenAI. (2025). ChatGPT [Large language model]. OpenAI. https://chat.openai.com

- Midjourney. (2025). Midjourney [AI image generation tool]. https://www.midjourney.com

- AIVA Technologies. (2025). AIVA [AI music composition tool]. https://www.aiva.ai

- Pictory. (2025). Pictory [AI video creation tool]. https://pictory.ai

- Korea Media Rating Board. (2025). Video content rating system. Ministry of Culture, Sports and Tourism. https://www.kmrb.or.kr

- Game Rating and Administration Committee. (2025). Video content rating system. Ministry of Culture, Sports and Tourism. https://www.grac.or.kr

- Motion Picture Association (MPA). (2021, November 19). Motion Picture Association age rating system. https://www.motionpictures.org

- Entertainment Software Rating Board (ESRB). (2013, August 2). Entertainment Software Rating Board age rating system. https://www.esrb.org

- Brazilian Advisory Rating System (ClassInd). (2014, September 29). Classificação Indicativa age rating system. https://www.classificacaoindicativa.gov.br

- Australian Classification Board (ACB). (2022, July 30). Australian Classification Board age rating system. https://www.classification.gov.au

- Unterhaltungssoftware Selbstkontrolle (USK). (2009). Unterhaltungssoftware Selbstkontrolle age rating system. https://www.usk.de

- Pan-European Game Information (PEGI). (2019, May 26). Pan-European Game Information age rating system. https://www.pegi.info

- International Age Rating Coalition (IARC). (2023). International Age Rating Coalition. https://www.globalratings.com

- National Election Commission. (2021, December 31). Public Official Election Act (Act No. 18588, Partially Amended). South Korea.

- Park, J. H. (2023, August 29). Guidelines for the Use of Generative AI by School Level. Seoul Metropolitan Office of Education.

- National Information Society Agency. (2024, January 1). Generative AI Ethical Guidelines. Dysfunction Response Team. https://www.nia.or.kr/site

- Seoul Digital Foundation. (2023. November 13). Seoul Metropolitan Government Generative AI Ethics Guidelines. AI & Big Data Team. https://sdf.seoul.kr

- National Information Society Agency. (2025, January 2). Intelligent Information Ethics Issue Report, Winter 2024 (Vol. 5, No. 4). Dysfunction Response Team.

-

Lawshe, C. H. (1975). A quantitative approach to content validity. Personnel Psychology, 28(4), 563-575.

[https://doi.org/10.1111/j.1744-6570.1975.tb01393.x]

Appendix

부 록

· 2011년 목원대학교 컴퓨터교육과 (학사)

· 2023년 성균관대학교 인공지능융합교육전공 (석사)

· 2025년 성균관대학교 컴퓨터교육학과 (박사수료)

· 2011년 ~ 현재 세명컴퓨터고등학교 정보·컴퓨터 교사

관심분야 : SW교육, 인공지능 활용, 교육과정 설계, 정보보안

mail@leeday.net

· 1988년 성균관대학교 정보공학과 (학사)

· 1990년 성균관대학교 정보공학과 (석사)

· 1998년 성균관대학교 정보공학과 (박사)

· 1990년 ~ 1995년 KIST/SERI 연구원

· 1996년 정보통신기술사

· 1999년 3월 ~ 현재 성균관대학교 컴퓨터교육과 교수

관심분야 : 네트워크, 정보보안, SW교육, 인공지능 윤리

sjahn@skku.edu