생성형 AI 기반 질문 중심 수업 지원 코스웨어 설계 및 개발 연구

초록

본 연구는 생성형 AI를 활용하여 초등학생의 자발적 질문 생성과 협력적 탐구 활동을 지원할 수 있는 웹 기반 질문 중심 코스웨어(Q-Class)를 설계하고 개발하는 것을 목적으로 하였다. 이를 위해 설계기반연구 방법을 적용하고 전문가 델파이 조사와 학생 대상 사용성 평가를 통해 총 세 차례에 걸쳐 프로토타입을 반복적으로 개선하였다. 연구 결과, Q-Class는 AI 기반 질문 생성과 피드백, 마인드맵 시각화, 협력적 질문 놀이, 직관적인 사용자 인터페이스를 통해 학습자가 스스로 질문을 작성하고 공유하며 탐구할 수 있도록 실질적인 지원을 제공함을 확인하였다. 또한 교사는 질문 데이터와 학습 활동 기록을 실시간으로 분석하여 맞춤형 수업 설계와 피드백 제공이 가능하였다. 본 연구는 생성형 AI 기반 질문 중심 학습 도구 설계에 대한 시사점을 제공하며 향후 실제 수업 맥락에서의 학습 효과성을 실증적으로 검증할 필요가 있다.

Abstract

This study aimed to design and develop a web-based question-centered courseware (Q-Class) utilizing generative AI to support elementary students’ self-directed question generation and collaborative inquiry activities. A design-based research method was applied, and iterative improvements were made through expert Delphi surveys and usability evaluations with students, resulting in three prototype versions. The findings indicated that Q-Class effectively provided practical support for students to independently generate, share, and explore questions through AI-based question generation and feedback, mind map visualization, collaborative question games, and an intuitive user interface. In addition, teachers were able to monitor and analyze question data and learning activity logs in real time, facilitating customized lesson planning and feedback. This study offers practical implications for designing question-centered learning tools based on generative AI and suggests that further empirical research should be conducted to verify its effectiveness in real classroom contexts.

Keywords:

generative AI, question-centered learning, courseware, design-based research, delphi survey키워드:

생성형 AI, 질문 중심 수업, 코스웨어, 설계기반연구, 델파이 조사1. 서론

최근 인공지능 기술이 빠르게 발전함에 따라 교육 분야에서도 생성형 AI를 활용한 교수학습 지원 방안에 대한 관심이 높아지고 있다[1]. 특히 대규모 언어 모델을 기반으로 하는 생성형 AI는 학습자의 발문 활동을 지원하고, 교사의 발문 설계 부담을 덜어줄 수 있는 도구로 활용 가능성이 주목되고 있다[2]. 이러한 기술적 변화는 학생의 단순 정보 수용을 넘어서 개별 학습자가 스스로 질문을 생성하고 동료와 공유하며 확장하는 질문 중심 학습 환경을 구현할 수 있는 가능성을 제공한다[3].

질문 중심 수업은 학습자가 주체적으로 지식의 구조를 탐구하고 사고의 폭을 넓히도록 돕는 교수 전략으로 오래전부터 강조되어 왔다[4]. 그러나 실제 교실에서는 학생 스스로 질문을 구성하고 이를 발전시키는 기회가 제한적이며 주로 교사 주도의 발문에 따라 학습이 진행되는 경우가 많다. 이는 학생 질문의 수준이 표면적 사실 확인에 머물고, 개별 질문이 심층적 탐구로 연결되지 못하는 원인으로 작용한다[5][6].

이러한 문제를 해결하기 위해서는 교사와 학습자가 동시에 활용할 수 있는 디지털 기반 질문 지원 도구가 필요하다. 특히 최근 연구에서는 생성형 AI를 보조 도구로 활용하여 학습자의 질문 생성 부담을 줄이고, 질문의 질과 다양성을 확보하려는 시도가 이루어지고 있다[2]. 그러나 질문 생성이 자동화되거나 튜터(또는 AI)가 제공한 질문만 수용할 경우 학생의 주도성이 줄어들고, 사고가 피상적일 수 있다는 우려가 제기된다[5].

이에 본 연구에서는 생성형 AI의 자동화 기능과 학습자 주도의 질문 활동이 상호 보완적으로 작동할 수 있도록 설계한 웹 기반 질문 중심 코스웨어(Q-Class)를 개발하였다. Q-Class는 학생용 모듈과 교사용 모듈로 구성된다.

학생용 모듈은 스스로 질문을 생성하고 AI 피드백을 받거나 AI가 자동으로 생성한 질문을 편집할 수 있는 질문 생성 기능을 포함한다. 또한 선택한 질문을 단계적으로 탐구할 수 있는 질문 탐구 활동 기능, 생성한 질문과 아이디어를 공유하고 피드백을 주고받을 수 있는 질문 공유 기능, 질문을 기반으로 릴레이 방식의 토론을 진행할 수 있는 질문 놀이 기능으로 구성된다. 이를 통해 학생은 AI의 지원을 받으면서도 주체적으로 질문을 작성하고 탐구하며 동료와 협력적으로 상호작용할 수 있다.

교사용 모듈은 AI를 활용하여 교과 내용과 학습 단계에 따라 질문을 설계할 수 있는 질문 중심 수업 설계 기능을 제공한다. 또한 학생별 질문 작성 현황과 탐구 활동 데이터를 실시간으로 파악하고 관리할 수 있는 학생 관리 기능, 수업에 필요한 자료를 공유하고 관리할 수 있는 자료 공유 기능, 질문 놀이 활동을 모니터링하고 관리할 수 있는 질문 놀이 관리 기능으로 구성된다. 이를 통해 교사는 학급 전체와 개별 학생의 질문 활동을 체계적으로 지원하고, 즉각적인 피드백을 제공함으로써 질문 중심 수업의 효과를 극대화할 수 있다.

본 논문은 Q-Class의 설계 원리와 주요 기능을 상세히 제시하고, 생성형 AI를 활용한 질문 중심 수업 지원 방안의 교육적 의의와 실천 가능성을 논의하고자 한다.

2. 이론적 배경

2.1 질문 중심 학습의 의의와 필요성

질문은 학습자의 인지적 충돌을 유발하고 문제 해결 과정에 적극적으로 참여하도록 만드는 촉매 역할을 한다[7]. 여러 연구에서 질문은 학습자의 호기심을 자극하고 새로운 지식 구조를 형성하도록 돕는 핵심 매개로 제시된다[4][8]. 하지만 전통적인 교실 수업에서는 질문 중심 학습의 효과가 기대만큼 발휘되지 못하는 사례가 많다. 이는 교사의 발문 빈도는 높으나 학생의 자발적 질문은 낮은 수준에 머무르고, 상위 사고력을 요하는 질문은 드물게 나타나기 때문이다[5][6]. 따라서 학생이 질문을 스스로 생성하고 이를 탐구로 확장할 수 있는 구조적 지원이 요구된다.

2.2 생성형 AI의 교육적 활용

최근 ChatGPT와 같은 생성형 AI는 학습자에게 개인화된 질문과 즉각적인 피드백을 제공하여 학습 이해도를 높이고, 교사의 발문 설계 부담을 경감하는 보조 도구로 주목받고 있다[9][10]. Munaye et al.(2025)은 ChatGPT를 활용한 교육에 대한 체계적 고찰을 통해 정보의 정확성 보장과 표절 방지 등 윤리적 쟁점이 함께 고려되어야 함을 강조하였다[9]. Fan et al.(2024)은 생성형 AI가 학습자에게 적절한 예시와 힌트를 제공하여 메타인지적 전략 사용과 문제 해결 과정의 구조화를 촉진할 수 있으나 과도한 의존은 오히려 메타인지적 수동성을 초래할 수 있음을 실험적으로 제시하였다[11]. Lee & Zhai(2024)는 예비 초등교사를 대상으로 한 과학 수업 설계 분석을 통해 ChatGPT가 발문 아이디어 생성과 교수·학습 전략 구체화에 기여하지만 일부 교사가 ChatGPT의 정보 정확성과 기능 활용 한계에 대해 우려를 갖고 있음을 밝혀내었다[12]. Yang et al.(2024)는 미국 초등교사를 대상으로 한 읽기 수업 사례에서 ChatGPT를 활용하여 고차원 발문을 손쉽게 설계할 수 있음을 보고하였다[2]. 또한 영국의 NFER와 Education Endowment Foundation(2024)의 무작위 통제 실험에서는 ChatGPT를 활용한 교사 집단이 전통적 방법을 사용하는 교사 집단보다 수업 준비 시간을 단축하면서도 자료의 질을 유지할 수 있음을 입증하였다[13].이러한 선행연구들은 생성형 AI가 교사와 학습자 모두에게 학습 편의성과 효과성을 제공할 수 있는 보조 도구로서의 가능성을 보여주는 동시에 정보 신뢰성 확보와 학습자 의존성 방지 등 윤리적 고려사항이 함께 논의되어야 함을 시사한다. 본 연구는 이러한 시사점을 바탕으로 생성형 AI의 자동화 기능을 학습자의 자기주도적 질문 생성과 탐구 활동을 촉진하는 보조 도구로 활용하고자 웹 기반 질문 중심 코스웨어를 설계·개발하였다.

3. 연구 방법

본 연구는 생성형 AI 기반 질문 중심 코스웨어(Q-Class)의 설계 및 개선 과정을 통해 그 타당성과 실효성을 검증하기 위해 설계기반연구(Design-Based Research, DBR) 방법을 적용하였다. 설계기반연구는 실제 교육 현장에서 발생할 수 있는 다양한 문제를 해결하기 위해 이론과 실천을 연계하고, 반복적인 설계와 평가 과정을 통해 최적의 결과를 도출하는 데 목적이 있다[14][15].

연구 절차는 Reeves와 McKenney 및 Bannan의 제안에 따라 분석–설계·개발–실행·평가의 형성적 순환 절차를 기반으로 진행되었다[15][16]. 먼저, 분석 단계에서는 생성형 AI를 활용한 질문 중심 수업 설계의 요구와 선행연구를 검토하여 코스웨어의 기본 구조와 기능을 정의하였다. 이어 설계 및 개발 단계에서는 OpenAI에서 제공하는 GPT-4o 모델을 API 방식으로 연동하여 Next.js를 기반으로 웹 애플리케이션 형태의 Q-Class 1차 프로토타입을 개발하였다.

개발된 1차 프로토타입은 Table 1과 같이 전문가 패널을 대상으로 1차 델파이 조사를 통해 검토되었으며, 도출된 의견을 반영하여 2차 프로토타입으로 개선하였다. 이어 2차 프로토타입에 대해서도 전문가를 대상으로 2차 델파이 조사를 실시하여 기능의 적합성과 사용성을 반복적으로 검증하고 수정하였다.

이후 실행 및 평가 단계에서는 최종 개선된 2차 프로토타입을 활용하여 초등학교 4~5학년 학생들을 대상으로 사용성 평가를 실시하였다. 사용성 평가를 통해 수집된 학생들의 실제 사용 경험과 의견을 분석하여 기능적 불편 사항과 개선점을 도출하였으며, 이를 반영하여 Q-Class의 프로토타입을 최종적으로 개발하였다. 이러한 절차를 통해 생성형 AI 기반 질문 중심 코스웨어의 설계 완성도를 높이고, 실제 교육 현장에서의 활용 가능성과 효과성을 확인하고자 하였다.

4. 연구 결과

4.1 시스템 개요

본 연구에서 개발한 코스웨어는 Table 2와 같이 Next.js 14를 기반으로 SSR과 라우팅을 구현하였으며 TypeScript를 사용하여 유지보수성과 안정성을 확보하였다. OpenAI GPT-4 API는 코스웨어에서 질문 유형별 자동 생성, 탐구 주제 및 질문 추천, 탐구 방법 안내, 표준 보고서 작성 지원, 질문 흐름형 수업 설계와 맞춤 피드백 제공 등 지능형 학습 지원 기능을 수행하였다. Firebase Authentication과 Firestore로 사용자 인증과 실시간 데이터 처리를 구현하였다. Vercel을 통한 안정적 배포와 Firebase Analytics를 활용한 사용자 활동 분석 기능을 포함하여 시스템의 실용성을 높였다.

4.2 1차 프로토타입 개발 및 델파이 1차 조사 결과

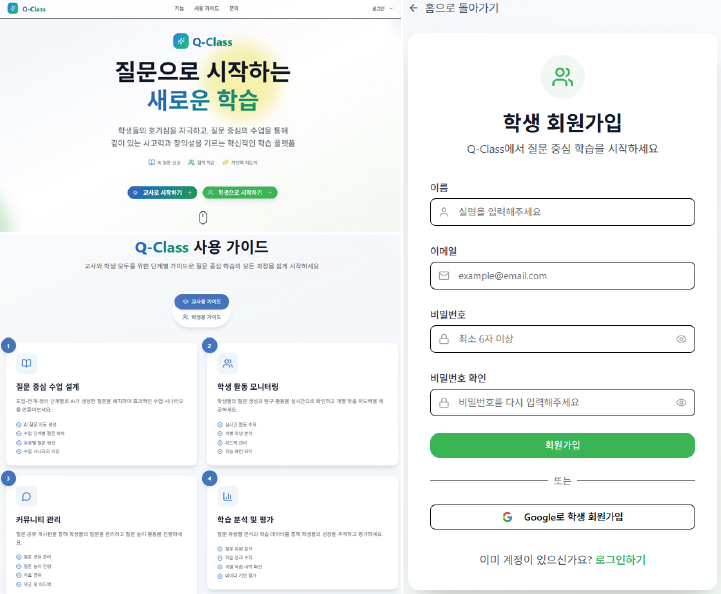

1차 프로토타입의 첫 번째 설계 요소는 Q-Class의 진입점인 랜딩 페이지였다. 랜딩 페이지는 Fig. 1과 같이 플랫폼의 핵심 가치와 사용 방법을 간결하게 소개하였다. 사용자는 메인 페이지에서 회원가입 혹은 로그인을 선택할 수 있으며 이메일 및 비밀번호 인증을 통해 안전한 접근 권한을 확보하도록 하였다. 인증 절차 완료 시 사용자는 자동으로 권한(교사 또는 학생)에 맞게 각 대시보드로 연결된다.

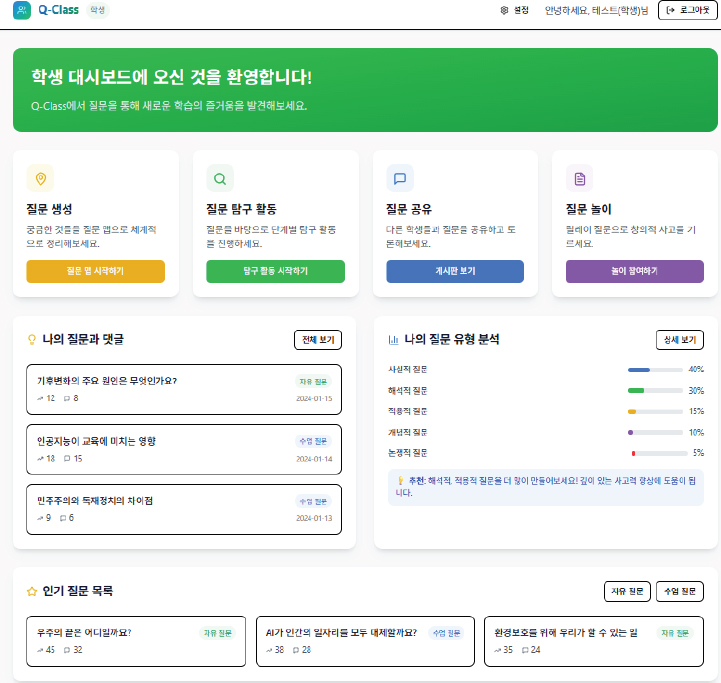

학생 대시보드는 Fig. 2와 같이 사용자가 자신의 학습 활동 현황을 한눈에 확인할 수 있는 공간으로 설계되었다. 대시보드에는 학생이 작성한 질문 목록과 댓글 기록이 최신순으로 정리되어 표시되며, 자유 질문 게시판과 수업 질문 게시판에서의 인기 질문이 ‘새로워요’ 수와 댓글 수를 기준으로 자동으로 선별되어 보여진다. 특히 질문 유형별 통계 차트를 통해 학생은 자신의 질문 생성 패턴을 분석할 수 있고, 이를 통해 사고 유형을 자가 진단할 수 있다. 주요 기능으로는 질문 생성기, 탐구 활동, 질문 공유, 나의 질문 목록에 빠르게 접근할 수 있는 바로가기 메뉴가 제공된다.

Student dashboard(Displays students’ recent activities, question statistics, and quick access to core functions.)

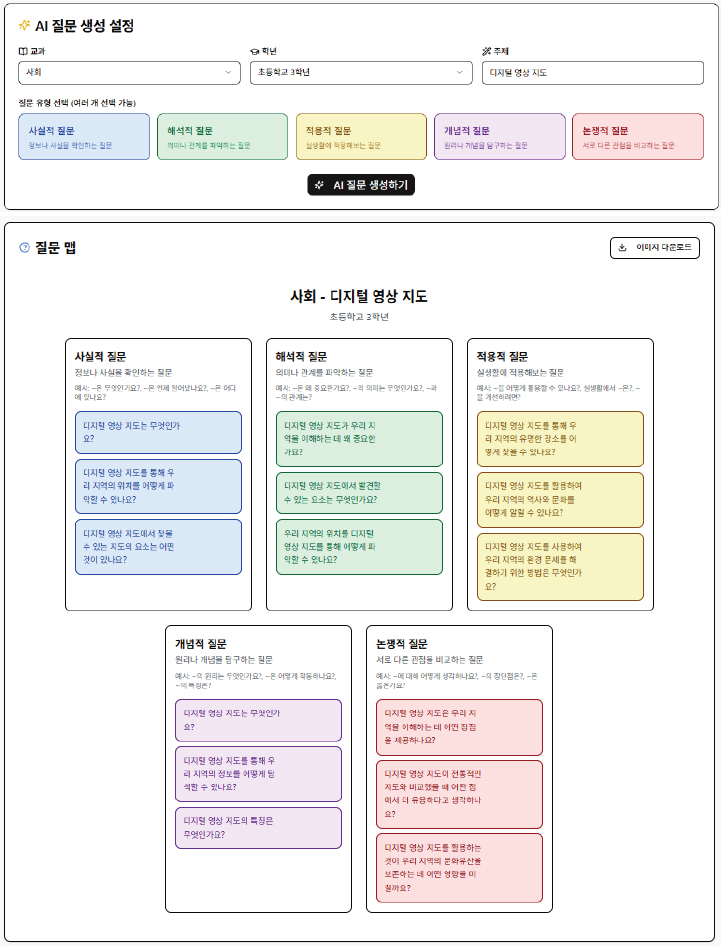

질문 생성 페이지는 Fig. 3과 같이 교육학적 이론에 따라 사실적, 해석적, 적용적, 개념적, 논쟁적 질문을 자동 생성하는 AI 기반 질문 생성기를 중심으로 구성되었다. 사용자는 교과, 학년, 주제를 입력하면 OpenAI GPT-4o API가 조건에 맞는 질문을 자동으로 생성한다. 각 질문은 카드 형태로 나타나며 드래그 앤 드롭 기능으로 자유롭게 재배치할 수 있고, AI가 생성한 질문과 내용을 학생이 무비판적으로 수용하지 않도록 수정, 삭제, 복사 기능도 지원된다. 완성된 질문 맵은 이미지화하여 파일로 다운로드할 수 있다.

Question generator(Enables students to create questions manually or with AI assistance, and receive feedback.)

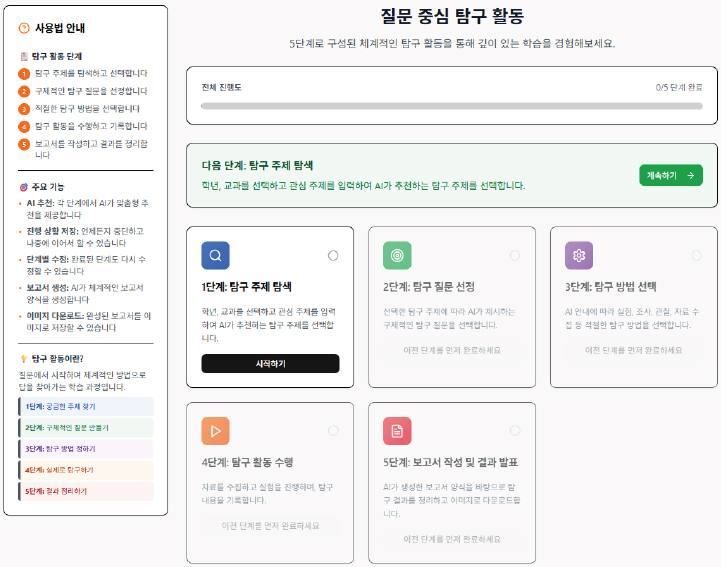

질문 탐구 활동 페이지는 Fig. 4와 같이 학생이 질문을 중심으로 심화 탐구를 수행할 수 있도록 5단계 프로세스로 설계되었다. 1단계에서는 학년과 교과를 선택하고 관심 주제를 입력하면 AI가 적절한 탐구 주제를 제안한다. 2단계에서 탐구 질문을 선택하고, 3단계에서는 AI가 제공하는 실험, 조사, 관찰 등 탐구 방법 중 하나를 선택한다. 4단계에서는 탐구 결과를 기록하고 정리할 수 있으며 5단계에서는 AI가 제공하는 표준화된 보고서 양식을 활용해 최종 탐구 보고서를 완성한다. 그리고 각 단계마다 AI가 생성한 질문과 내용을 학생이 무비판적으로 수용하지 않도록 편집 기능을 제공하였다.

Inquiry inquiry activity(Supports step-by-step scientific inquiry processes based on studentgenerated questions.)

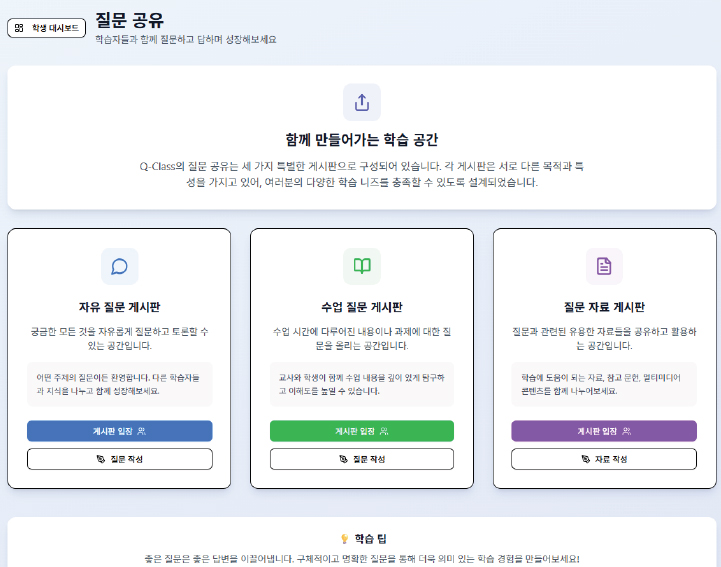

질문 공유 페이지는 Fig. 5와 같이 학급과 학생 간 지식과 아이디어를 자유롭게 공유하도록 설계되었다. 플랫폼은 자유 질문 게시판, 수업 질문 게시판, 질문 자료 게시판으로 구분된다. 각 게시판은 게시글 작성, 수정, 삭제가 즉시 반영되며 댓글 기능과 좋아요(‘새로워요’) 기능이 탑재되어 상호 피드백과 활발한 토론이 가능하다. 학생은 텍스트와 이미지가 포함된 질문 자료를 쉽게 작성할 수 있다.

Share questions(Allows students to post and view questions in different categories and interact with peers.)

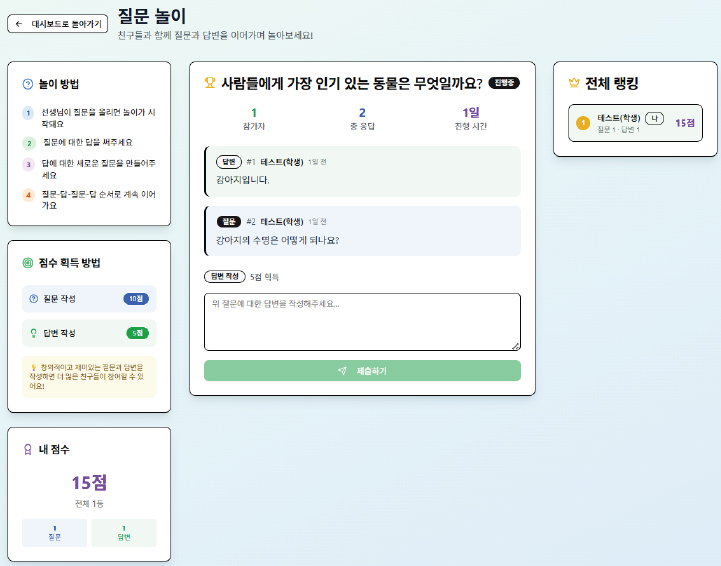

질문 놀이 페이지는 Fig. 6과 같이 교사나 학생이 선택한 질문을 중심으로 릴레이 댓글로 질문 체인을 확장하는 협력적 학습 활동 공간이다. 교사가 놀이에 활용할 질문을 선택하면 학생들은 해당 질문에 대해 추가 질문이나 관련 아이디어를 댓글로 이어 붙일 수 있다. 이를 통해 학생들은 다양한 관점을 탐색하고 비판적 사고와 창의성을 자연스럽게 기를 수 있도록 설계하였다.

Question play(Facilitates collaborative question chaining activities through turn-based student responses.)

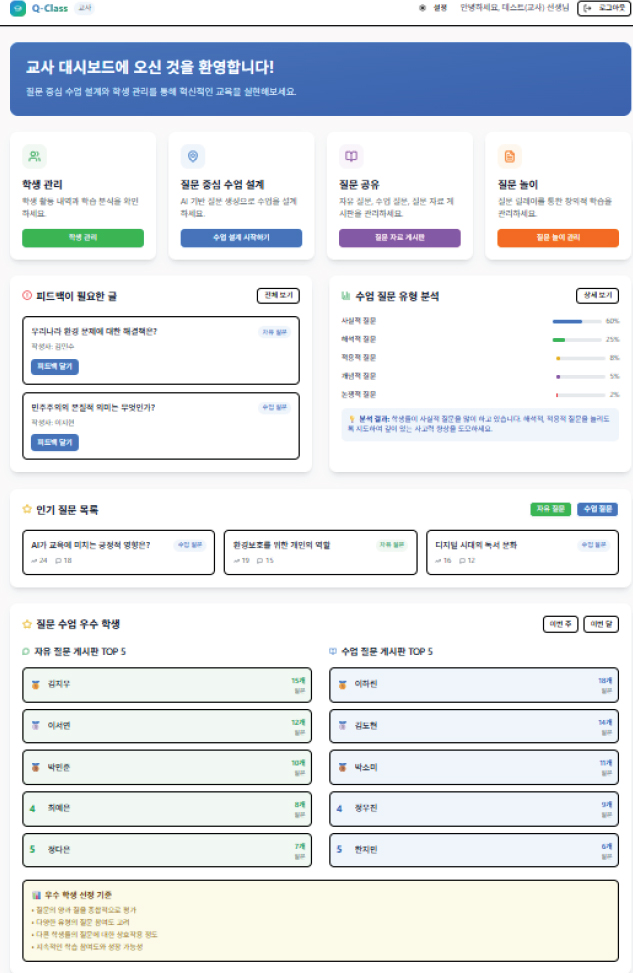

교사 대시보드는 Fig. 7과 같이 학급 전체의 학습 상황을 모니터링하고 효율적으로 관리할 수 있도록 구성되었다. 대시보드에는 전체 학생들의 질문 생성 빈도와 유형 분포가 그래프로 시각화되어 제공되며 피드백이 필요한 게시글 목록이 상단에 표시되어 교사가 우선적으로 확인하고 개입할 수 있다. 인기 질문 순위와 활발한 참여 학생 목록은 교사가 학급 내 참여도를 진단하고 격려할 수 있는 자료로 활용된다.

Teacher dashboard(Summarizes classroom-level activity data and highlights student contributions requiring feedback.)

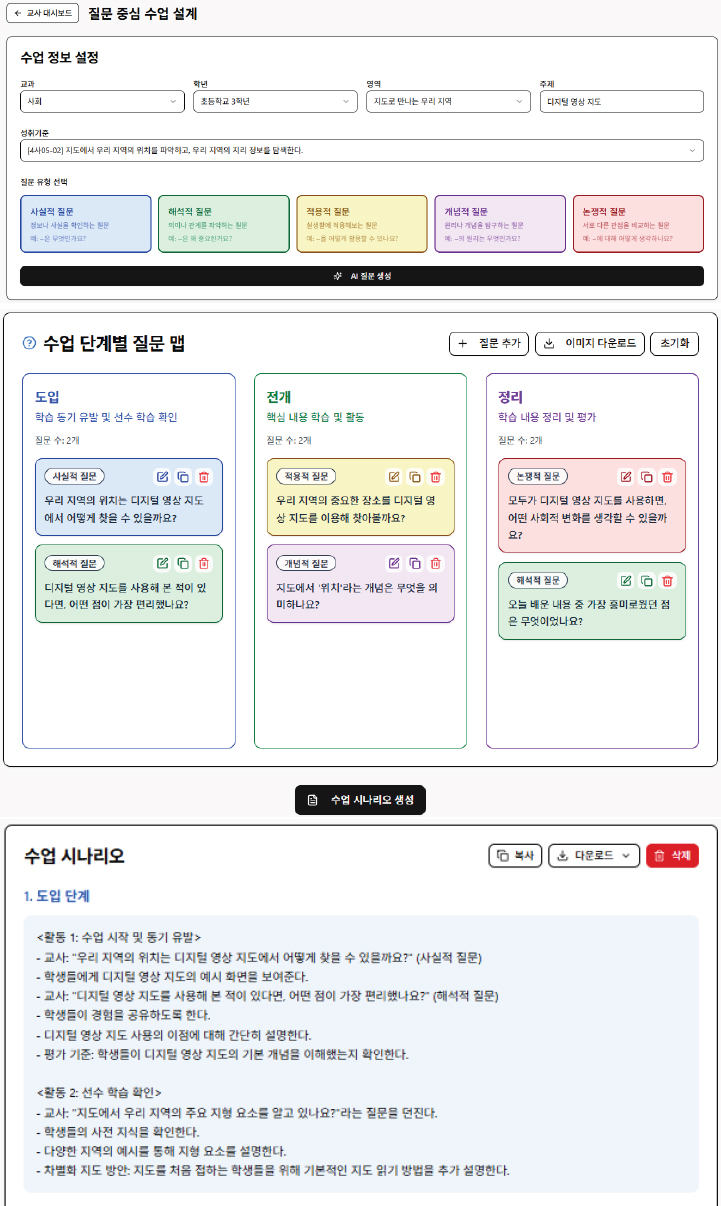

질문 중심 수업 설계 페이지는 Fig. 8과 같이 교사가 AI 기반으로 생성된 질문을 활용하여 단계별 수업 시나리오를 작성할 수 있는 공간이다. 교사는 교과, 학년, 성취기준, 질문 유형을 선택하고 학습 주제를 입력하면 선택한 질문 유형의 예시 질문들을 카드 형태로 생성하고 이를 도입, 전개, 정리 단계별로 배치하여 수업 흐름을 계획할 수 있다. 생성된 수업 시나리오는 워드 혹은 텍스트 파일로 다운로드할 수 있어 수업 자료로 즉시 활용할 수 있다.

Question-centered lesson design(Supports teachers in planning lessons using AI-generated questions aligned with curriculum topics.)

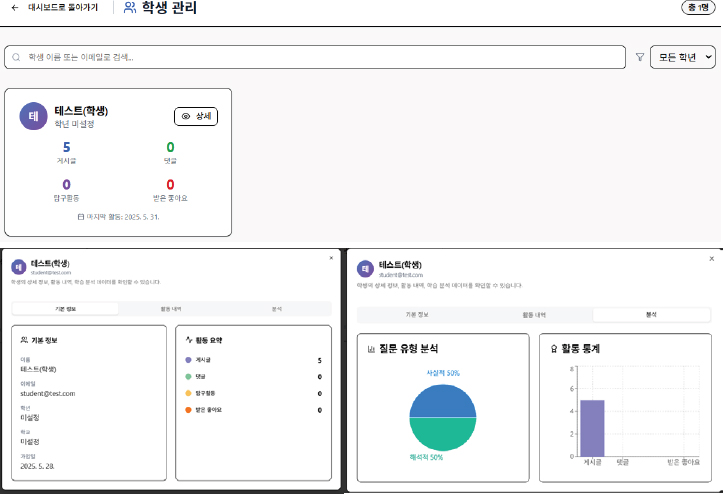

학생 관리 페이지는 Fig. 9와 같이 교사가 학급 구성원 개개인의 학습 활동을 상세히 확인할 수 있도록 설계되었다. 각 학생의 로그인 상태는 실시간으로 표시되며 이름 검색 기능을 통해 특정 학생을 신속하게 찾을 수 있다. 개별 프로필에는 질문 작성 빈도, 탐구 활동 참여 횟수, 게시판 활동 내역 등이 차트와 표로 제공되며 이를 통해 교사는 학습자의 질문 성향과 참여도에 맞는 맞춤 피드백 전략을 수립할 수 있다.

Student management(Provides access to individual student profiles, activity logs, and question preference analytics.)

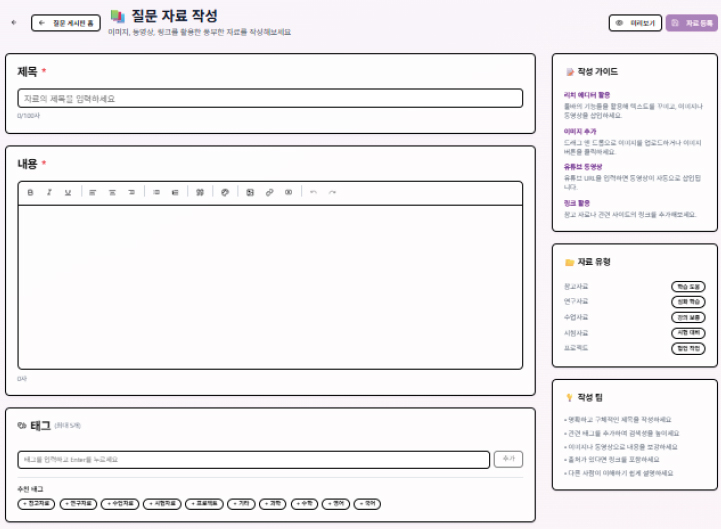

자료 공유 페이지는 Fig. 10과 같이 교사 간 또는 교사와 학생 간 학습 자료와 수업 콘텐츠를 효율적으로 공유할 수 있는 공간이다. 교사는 자신이 제작한 수업 자료나 참고 자료를 업로드하고 게시판 형태로 공유할 수 있으며 이를 통해 수업 준비에 필요한 시간을 절약하고 자료 활용의 일관성을 높였다.

Question material(Offers teachers a space to upload and manage instructional resources related to student questions.)

질문 놀이 관리 페이지는 Fig. 11과 같이 교사가 학생들의 질문 놀이 활동을 체계적으로 운영할 수 있도록 돕는다. 교사는 놀이에 사용할 질문을 선택하고 놀이 진행 상황을 실시간으로 모니터링할 수 있으며 릴레이 댓글 흐름과 참여 학생 리스트를 확인할 수 있다. 이를 통해 교사는 활동 중 적절한 시점에 개입하거나 피드백을 제공하며 학생 간 협력 학습을 촉진할 수 있다.

Question play management(Enables teachers to monitor and guide student participation in question-based learning games.)

프로토타입의 타당성 평가는 정민영(2024)의 연구와 Bevan & Macleod(1994)의 질문지를 참고하여 본 연구의 목적에 맞게 수정한 5점 Likert 척도 문항지를 활용하여 이루어졌다[17][18]. 이를 통해 프로토타입에 대한 전문가 검토 문항을 구성하였으며 각 문항은 Table 3에 제시되어 있다.

델파이 조사를 통해 수집된 자료의 분석은 사분범위, 수렴도(Degree of convergence), 합의도(Degree of agreement)와 같은 통계와 델파이 전문가 의견을 종합적으로 수렴·정리하여 이루어졌다. 평균은 Likert 5점 척도 기준으로 4.0 이상, 표준편차는 .8 미만일 경우를 타당도 판단 기준으로 하였다. 또한 평균이 4.0 이상인 문항은 타당도가 있는 것으로 보았고, 본 연구에 참여한 패널의 수는 10명으로 CVR값이 .62 이상일 경우 문항은 타당도를 확보했다고 보았다. 수렴도 판단 기준은 0~.50로 설정하였으며, .75 이상의 합의도를 판단 기준으로 정했다.

1차 델파이 조사 결과, Table 4와 같이 전체 12개 항목 중 8개 항목은 CVR 값이 0.8 이상으로 높게 나타났으며 수렴도와 합의도 또한 안정적인 수준을 보였다. 이는 대다수 항목이 전문가 집단 간 의견 일치도가 높고 내용 타당성이 확보되었음을 시사한다. 다만, ‘질문 중심 수업 참여도 향상’과 관련된 일부 항목(항목 2, 4, 8, 10)은 CVR 값이 0.6으로 상대적으로 낮게 나타났으며, 수렴도와 합의도 지표도 일부 기준에 미치지 못하는 것으로 확인되었다.

이에 따라 CVR 값이 낮거나 수렴도, 합의도가 기준치에 미달한 항목은 전문가 의견을 종합하여 2차 프로토타입 개발에 반영하고 문항 내용을 일부 수정·보완하였다. 또한 프로토타입 개선에 대한 전문가 의견은 학생 친화적인 질문 작성 지원, AI 피드백 제공, 질문 목록의 시각적 명료성 확보, AI 사용에 대한 올바른 안내, 교사의 학생 데이터 관리 기능 강화 등이 제시되었다. 이러한 전문가 의견은 이후 2차 프로토타입 개발에 반영되어 웹의 기능과 설계 완성도를 높이는 데 기여하였다.

4.3 2차 프로토타입 개발 및 델파이 2차 조사 결과

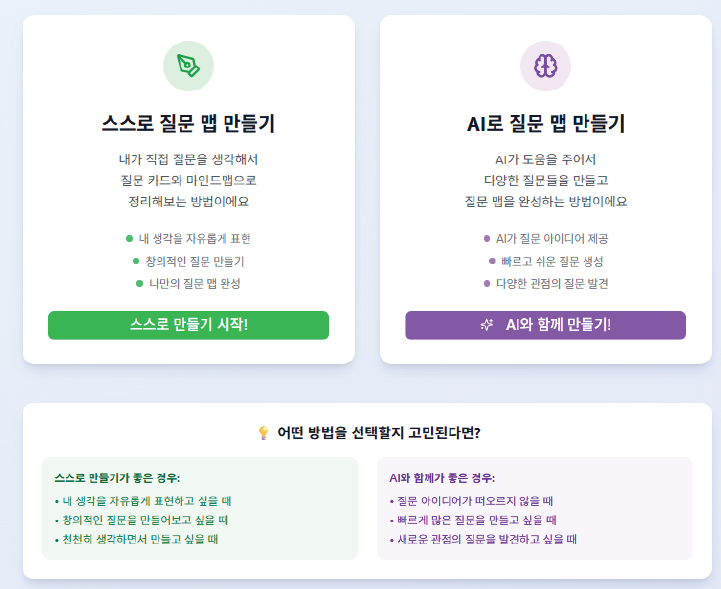

델파이 조사에서 학생 친화적 질문 작성에 대한 필요성이 강조됨에 따라 2차 프로토타입에서는 기존 질문 생성기에 ‘스스로 질문 만들기’ 기능을 Fig. 12와 같이 추가하였다. 이를 통해 학생은 AI가 제안하는 질문에 의존하지 않고 직접 질문을 작성하고, 생성한 질문을 유형별로 선택하여 관리할 수 있도록 개선하였다. 이 기능은 자기주도 학습력과 창의적 질문력 향상을 동시에 지원한다.

Create your own questions(Allows students to formulate and categorize their own questions without AI assistance.)

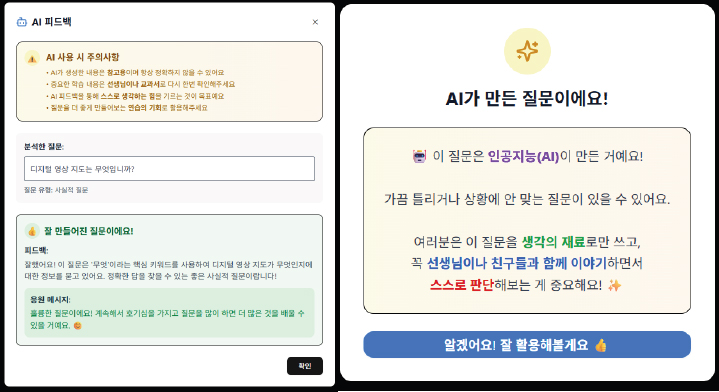

전문가 의견 중 학생의 질문 명확성을 높여야 한다는 지적을 반영하여 OpenAI GPT-4o 기반의 AI 피드백 기능을 Fig. 13과 같이 새로 도입하였다. 학생이 입력한 질문은 AI가 즉시 분석하여 명확성, 적합성, 개선 방향에 대한 피드백을 제공한다. 또한 AI가 자동으로 내용을 생성할 때마다 경고 메시지를 통해 생성된 정보의 한계와 책임 있는 사용 방법을 안내하기 위해 경고 메시지 시스템을 추가하였다. 이를 통해 학생이 AI를 보조 도구로 활용하면서도 자기주도적 사고를 유지할 수 있도록 유도하였다.

AI feedback and warning message(Provides automated feedback on student-generated questions with guidance for responsible AI use.)

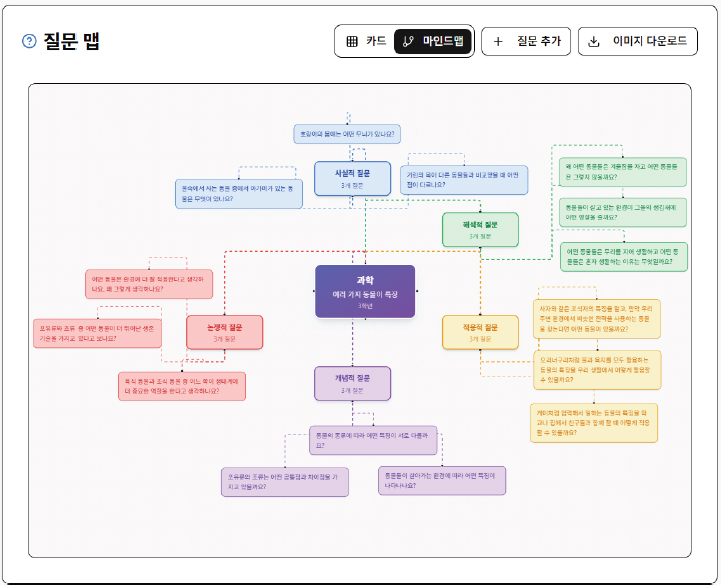

질문 목록이 실제 마인드맵처럼 시각화되지 않아 혼란을 준다는 의견을 반영하여 기존 질문 카드 형식에 마인드맵 뷰를 Fig. 14와 같이 새롭게 추가하였다. 사용자는 생성된 질문을 중심 주제를 기준으로 방사형 그래프로 시각화해 질문 간 관계를 쉽게 파악할 수 있으며, 이를 통해 학습자가 주제별 사고 흐름을 직관적으로 탐색할 수 있도록 개선하였다.

Mind map view(Visualizes question connections in a radial layout to support divergent and convergent thinking.)

2차 델파이 조사 결과, Table 5와 같이 전체 4개 항목 중 4개 항목 모두 CVR 값이 0.8 이상으로 높게 나타났으며 수렴도와 합의도 또한 안정적인 수준을 보였다. 이는 대다수 항목이 전문가 집단 간 의견 일치도가 높고 내용 타당성이 확보되었음을 시사한다.

4.4 최종 프로토타입 개발 및 사용성 평가

개발된 Q-Class 프로토타입의 실제 적용 가능성과 사용자 친화성을 확인하기 위해 초등학교 4~5학년 학생 32명을 대상으로 사용성 평가를 실시하였다. 사용성 평가는 Nielsen(1993)과 Bevan & Macleod(1994)의 사용성 평가 이론과 함께 SUS(System Usability Scale) 문항을 참고하여 본 연구 목적에 적합하도록 수정된 5점 Likert 척도 기반의 9개 항목으로 구성되었다. 평가 문항은 사용 편의성, 학습성, 만족도 등 전반적인 사용성 등을 포함하였다.

분석 결과, Table 6과 같이 전 문항의 평균은 3.56에서 4.16 범위로 나타났으며 중위수는 모든 문항에서 4.0으로 확인되어 참가 학생들이 Q-Class의 전반적 사용성을 긍정적으로 평가하였음을 보여주었다. 이러한 결과는 Q-Class가 초등학생의 자발적 질문 생성과 협력적 탐구 활동을 효과적으로 지원할 수 있는 웹 기반 도구로서의 실용성과 사용 편의성을 갖추고 있음을 시사한다.

개선 의견으로는 질문 놀이 활동 중 여러 명이 동시에 답변을 작성할 때 이전 답변이 혼재되어 표시되는 문제가 지적되었으며 각 질문별 답변 흐름이 명확히 구분되도록 개선할 필요성이 제기되었다. 또한 일부 학생은 대시보드와 게시판에서 질문 작성 버튼의 위치를 찾기 어렵다는 의견을 제시하며, 직관적인 아이콘과 버튼 디자인 개선이 요구되었다.

이러한 의견을 반영하여 최종 프로토타입에서는 질문 놀이 페이지의 데이터 처리 안정성을 강화하고, 답변 간 연결 관계를 쉽게 파악할 수 있도록 개선하였다. 대시보드와 질문 작성 버튼은 사용자가 직관적으로 인지할 수 있도록 직관적인 모양의 아이콘으로 변경하고, 반응형 UI와 메뉴 시각 요소를 개선하여 전반적인 사용자 경험을 고도화하였다.

최종 개발된 프로토타입은 사용자 인증 계층을 통해 교사와 학생으로 역할이 구분되며, 각 역할별로 필요한 기능 모듈이 유기적으로 연동되도록 설계되었다. 학생 모듈은 질문 생성, 질문 탐구 활동, 질문 공유, 질문 놀이 등의 학습 활동을 지원한다. 생성된 질문은 문서 저장소를 거쳐 저장된다. 또한 OpenAI API 연동 기능을 통해 생성형 AI 기반 질문 생성을 실현하였다. 그리고 교사 모듈은 질문 중심 수업 설계, 학생 관리, 자료 공유, 질문 놀이 관리 기능 등을 포함하여 수업 설계와 학급 운영을 지원한다. 특히 교사는 놀이 진행 데이터를 실시간으로 파악하고, 학생 관리 시스템을 통해 학생별 질문 데이터와 분석 결과를 활용하여 맞춤형 피드백을 제공할 수 있다.

모든 사용자 데이터는 공유 게시판과 실시간 데이터베이스를 통해 Firebase Firestore에 연동되어 저장·분석되며, 이를 통해 학생의 활동 정보는 분석 데이터베이스에 누적되어 학습 분석이 가능하다. 이와 같은 구조는 질문 중심 수업과 협력적 탐구 활동을 촉진하는 데 필요한 학습 흐름과 데이터 흐름을 통합적으로 지원한다. 최종 개발된 프로토타입의 플로우 차트는 부록과 같다.

5. 결론 및 제언

본 연구에서는 생성형 AI 기술을 활용하여 학생의 자발적 질문 생성과 협력적 탐구 활동을 지원하는 웹 기반 질문 중심 코스웨어(Q-Class)를 설계·개발하였다. 설계기반연구 방법을 적용하여 전문가 델파이 조사와 초등학생 대상 사용성 평가를 통해 총 세 차례에 걸쳐 프로토타입을 반복적으로 개선하며 완성도를 높였다.

연구 결과, Q-Class는 AI 기반 질문 생성과 피드백, 마인드맵 시각화, 협력적 질문 놀이, 직관적인 사용자 인터페이스를 통해 초등학생이 주도적으로 질문을 생성하고 탐구할 수 있는 실질적 지원 기능을 제공함을 확인하였다. 또한 교사는 학생별 질문 데이터와 학습 활동 기록을 실시간으로 관리·분석하여 맞춤형 피드백과 수업 설계에 활용할 수 있었다.

본 연구는 생성형 AI를 활용한 질문 중심 학습 도구 설계에 대한 실천적 시사점을 제공하며, 향후 다양한 학년과 교과로의 확장성과 현장 적용 가능성을 뒷받침하는 기초 자료로 활용될 수 있다. 다만 본 연구에서는 GPT-4o 모델을 사용하였으나 향후에는 KoGPT, Claude 3 등 다양한 모델을 비교 분석이 필요하다. 또한 본 연구는 주로 시스템 설계와 사용성 평가에 초점을 두었기 때문에 향후 연구에서는 교과별 적용 연구를 통해 플랫폼의 범용성과 수업 효과성을 더욱 정교하게 검증할 필요가 있다.

References

- Holmes, W., Bialik, M., & Fadel, C. (2019). Artificial Intelligence in Education: Promises and Implications for Teaching and Learning. Center for Curriculum Redesign.

-

Yang, S., Trainin, G., & Appleget, C. (2024). Teacher use of generative AI for read‑aloud question prompts. The Reading Teacher. 78(4), 230-235.

[https://doi.org/10.1002/trtr.2366]

-

Lee, C. (2025). Exploring elementary teachers’ educational intentions in selecting generative AI as curriculum content. The Journal of Curriculum and Evaluation, 28(1), 1–25.

[https://doi.org/10.29221/jce.2025.28.1.1]

-

King, A. (1994). Guiding knowledge construction in the classroom: Effects of teaching children how to question and how to explain. American Educational Research Journal, 31(2), 338–368.

[https://doi.org/10.3102/00028312031002338]

-

Graesser, A. C., & Person, N. K. (1994). Question asking during tutoring. American Educational Research Journal, 31(1), 104–137.

[https://doi.org/10.3102/00028312031001104]

- Banilower, E. R., Smith, P. S., Malzahn, K. A., Plumley, C. L., Gordon, E. M., & Hayes, M. L. (2018). Report of the 2018 NSSME+. Horizon Research, Inc.

-

Simons, K. D., & Klein, J. D. (2007). The impact of scaffolding and student achievement levels in a problem-based learning environment. Instructional Science, 35(1), 41–72.

[https://doi.org/10.1007/s11251-006-9002-5]

-

Chin, C., & Osborne, J. (2008). Students’ questions: a potential resource for teaching and learning science. Studies in Science Education, 44(1), 1–39.

[https://doi.org/10.1080/03057260701828101]

-

Munaye, Y. Y., Admass, W., Belayneh, Y., Molla, A., & Asmare, M. (2025). ChatGPT in Education: A Systematic Review on Opportunities, Challenges, and Future Directions. Algorithms, 18(6), 352.

[https://doi.org/10.3390/a18060352]

-

Kim, J., Kang, D., & Ko, Y. (2023). A study on educative utilization of generative AI: Focusing on ChatGPT utilization. Journal of The Korean Association of Information Education, 27(6), 691–704.

[https://doi.org/10.14352/jkaie.2023.27.6.691]

-

Fan, Y., Tang, L., Le, H., Shen, K., Tan, S., Zhao, Y., ... & Gašević, D. (2025). Beware of metacognitive laziness: Effects of generative artificial intelligence on learning motivation, processes, and performance. British Journal of Educational Technology, 56(2), 489-530.

[https://doi.org/10.1111/bjet.13544]

-

Lee, G. G., & Zhai, X. (2024). Using ChatGPT for science learning: A study on pre-service teachers' lesson planning. IEEE Transactions on Learning Technologies. 17, 1643-1660.

[https://doi.org/10.1109/TLT.2024.3401457]

-

Roy, P., Poet, H., Staunton, R., Aston, K., & Thomas, D. (2024). ChatGPT in Lesson Preparation: A Teacher Choices Trial. In Technical Report. Education Endowment Foundation London, UK. http://www.mmiweb.org.uk/gaiandre/literature/EEF.pdf

[https://doi.org/10.1186/ISRCTN13420346]

- Reeves, T. C., & McKenney, S. (2013). Computer assisted language learning and design-based research: Increased complexity for sure, enhanced impact perhaps. In Design-based research in CALL (pp. 9-21). Computer Assisted Language Instruction Consortium (CALICO).

- Bannan, B. (2009). The integrative learning design framework: An illustrated example from the domain of instructional technology. An introduction to educational design research, 53-73.

-

Jung, M. Y. (2024). Development of the Empathy Instruction Support Application Prototype for Elementary School [Doctoral dissertation, Department of Education, Pusan National University].

[https://doi.org/10.23172/pusan.000000163152.21016.0000489]

-

Bevan, N., & Macleod, M. (1994). Usability measurement in context. Behaviour & information technology, 13(1-2), 132-145.

[https://doi.org/10.1080/01449299408914592]

-

Nielsen, J. (1993). Usability Engineering. Morgan Kaufmann.

[https://doi.org/10.1016/B978-0-08-052029-2.50009-7]

- Brooke, J. (1996). SUS-A quick and dirty usability scale. Usability evaluation in industry, 189(194), 4-7.

· 2011년 전주교육대학교 초등교육과

· 2022년 한국교원대학교 교육대학원 소프트웨어교육과

· 2022년~한국교원대학교 초등컴퓨터교육과 박사과정

관심분야 : AI 융합 교육, 컴퓨터 교육, 정보 교육과정

sojung27@hanmail.net

· 1998년 KAIST 전기및전자공학과 (공학사)

· 2000년 KAIST 전자전산학과(공학석사)

· 2019년 KAIST 전기및전자공학부(Ph.D).

· 2000년~2005년 LG 데이콤 주임연구원

· 2005년~2020년 ETRI 실장, 책임연구원

· 2020년~현재 한국교원대학교 인공지능융합교육 전공교수

· 2006년~현재 ITU-T SG11 Rapporteur, Editor

· 2022년~현재 한국AI융합교육연구소 소장

· 2024년~현재 교육정보원 원장

관심분야 : 인공지능융합교육, AI디지털교과서, 지능형 에지컴퓨팅, 강화학습

kimkh@knue.ac.kr