생성형 AI 교육 환경에서 학생 개인정보 보호를 위한 교사 역할 연구

초록

이 연구는 생성형 AI 교육 가이드라인 분석을 통해 학생 개인정보 보호를 위한 교사 역할을 규명하였다. 22개 가이드라인에서 추출한 76개 역할 문장의 지향적 질적 내용분석 결과, 교사 역할은 교육자, 수문자, 보호자, 감독자, 옹호자의 5가지로 유형화되었다. 학생의 자기 보호 역량을 강화하는 교육자 역할(40.8%)이 가장 강조되었고, 수문자(30.3%), 보호자(26.3%), 감독자(21.1%) 순으로 나타났다. 반면 옹호자 역할(1.3%)은 현저히 낮아 교실 수준의 대응에 집중됨을 보여준다. 이 연구는 교사의 개인정보 보호 역할을 유형화하여 교사 교육과 학교 정책 수립의 실천적 기반을 제공한다.

Abstract

This study identified teachers' roles in protecting student data privacy through the analysis of generative AI educational guidelines. A directed qualitative content analysis of 76 role statements from 22 guidelines revealed five role types: Educator, Gatekeeper, Guardian, Monitor, and Advocate. The Educator role (40.8%) emphasizing students' self-protection capabilities was most prominent, followed by Gatekeeper (30.3%), Guardian (26.3%), and Monitor (21.1%) roles. In contrast, the Advocate role (1.3%) was minimal, indicating a focus on classroom-level responses. This study provides a typology of teachers' privacy protection roles, offering a practical foundation for teacher education and school policy development.

Keywords:

Generative AI, Student Data Privacy, Teacher Roles, K-12 Education, Guideline Analysis키워드:

생성형 AI, 학생 개인정보 보호, 교사 역할, K-12 교육, 가이드라인 분석1. 서론

2022년 11월 ChatGPT 출시 이후 K-12 교육 현장에 생성형 AI의 급속한 확산이 이루어졌다. 미국 청소년의 학업용 ChatGPT 활용률이 2023년 13%에서 2024년 26%로 1년 사이 두 배 증가했으며[1], 한국청소년정책연구원의 2024년 조사에서 국내 중·고교생의 67.9%가 생성형 AI 사용 경험이 있는 것으로 나타났다[2]. 이러한 확산은 생성형 AI가 개인화된 학습 경험 제공, 비판적 사고 및 문제 해결 능력 함양 등 교육적 잠재력을 인정받으며 교육 현장의 핵심 도구로 부상하고 있음을 보여준다[3].

생성형 AI의 빠른 확산과 동시에 프라이버시 위험이 주요 쟁점으로 대두되고 있다. 2024년 방송통신위원회 조사에서 생성형 AI 비이용자의 절반 이상(58.9%)이 '개인정보 유출 우려'를 주요 장벽으로 인식하는 것으로 나타났다[4]. 실제로 2023년 ChatGPT에서 약 10만 명의 계정 정보가 다크 웹에 유출되었고[5], Nasr 등(2023)은 대규모 언어 모델의 학습 데이터에서 개인정보 추출이 가능함을 실증하였다[6]. 2024년 이탈리아 개인정보 보호 당국은 미성년자 보호 장치가 부재하다는 점을 근거로 OpenAI에 1,500만 유로의 제재금을 부과하였으며, 이는 생성형 AI의 데이터 수집 관행에 대한 법적·윤리적 문제를 공론화하는 계기가 되었다[7].

기존의 개인정보 보호법은 생성형 AI가 야기하는 새로운 위험에 대응하는 데 명백한 한계를 드러낸다. 미국의 FERPA, COPPA, 유럽의 GDPR, 한국의 개인정보 보호법 등 현행법들은 데이터 '저장'과 '활용'이 분리된 방식을 전제로 설계되었다[8-11]. 그러나 일부 생성형 AI는 사용자의 입력 데이터를 모델 학습에 활용하며, 훈련 과정에서 저장된 개인정보를 출력하거나 개별 데이터들을 병합하여 노출하는 위험을 초래한다[6]. 이러한 개인정보의 재생성 및 예측 불가능한 재조합은 기존 법제가 예상하지 못한 새로운 유형의 프라이버시 침해 위험을 제기한다. 특히 교육 현장에서 저학년 아동은 생성형 AI와 같은 상업적 맥락에서 자신의 데이터가 어떻게 처리되고 활용되는지 충분히 인지하지 못한 채 이름, 학교, 개인적 고민 등을 입력할 위험에 노출된다[12].

이러한 기술적·법적 공백 속에서 교육 현장의 실천적 보호 전략이 요구되며, 교사의 역할이 핵심이다. UNESCO, ISTE 등 주요 교육 기관들은 생성형 AI 활용 가이드라인을 발표하며, 교사가 교실에서 AI 도구와 학생을 매개하고 학생을 보호하는 핵심적 역할을 수행해야 함을 강조하고 있다[13]. 하지만 이들 가이드라인이 교사에게 구체적으로 어떤 역할을 부여하는지, 그리고 그 역할들을 어떻게 유형화할 수 있는지에 대한 실증적 분석 연구는 부재한 실정이다.

이 연구는 국내외 생성형 AI 교육 가이드라인의 체계적 분석을 통해 학생 개인정보 보호를 위한 교사의 역할을 규명하고자 한다. 연구 질문은 다음과 같다. 첫째, 생성형 AI 교육 가이드라인은 학생 개인정보 보호를 위해 교사에게 어떠한 역할을 부여하는가? 둘째, 이러한 교사 역할은 어떤 유형으로 분류되며, 각 유형의 특성과 강조점은 무엇인가?

본 연구는 생성형 AI라는 특정 기술 맥락에서 교사의 개인정보 보호 역할을 가이드라인 분석을 통해 실증적으로 규명했다는 점에서 기존 연구와 차별화된다. 기존 연구들이 AI 윤리나 디지털 시민성을 거시적 관점에서 논의하거나 교사 역할을 일반론적으로 다룬 것과 달리, 본 연구는 국내외 22개 가이드라인을 체계적으로 분석하여 교사의 개인정보 보호 역할을 유형화하고 각 역할의 특성과 상대적 중요도를 규명하였다. 이를 통해 생성형 AI 시대 교사 전문성 개발의 방향을 제시하고, 안전한 AI 활용 교육 환경 조성에 기여하고자 한다.

2. 이론적 배경

2.1 생성형 AI 환경에서의 아동 데이터 프라이버시

생성형 AI의 데이터 처리 메커니즘은 전통적인 프라이버시 보호 방식으로는 대응하기 어려운 특성을 지닌다. Nissenbaum(2004)의 '맥락적 무결성(Contextual Integrity)' 이론은 프라이버시를 '특정 맥락에 적절한 정보 흐름'으로 정의한다[14]. 프라이버시 침해는 정보가 부적절하게 흐를 때 발생하며, '적절성'은 정보 주체, 송신자, 수신자, 정보 유형, 그리고 전송 원칙이라는 규범에 의해 결정된다. 교육 맥락에서는 교사, 학생, 학부모 간의 신뢰를 기반으로 하는 정보 규범이 존재한다. 학생의 학업 성취도, 개인적 고충 등은 교육 목적 아래 공유되지만, 이 정보가 상업적 모델 개발에 사용될 것으로는 예상하지 않는다. 생성형 AI 서비스가 학생의 프롬프트를 모델 재학습에 활용하는 것은 교육이라는 제한된 맥락의 규범을 위반한 정보의 흐름으로 볼 수 있으며, 이는 프라이버시 침해에 해당한다.

이러한 프라이버시 위험은 AI의 데이터 처리 메커니즘에 내재되어 있다. 사용자의 프롬프트와 AI의 응답 기록이 모델 개선을 위한 학습 데이터로 활용될 수 있기 때문이다. 이 과정에서 두 가지 주요 위험이 발생한다. 첫째, 데이터 추출 위험이다. Carlini 등(2021)은 대규모 언어 모델이 학습한 개인정보나 민감 정보를 특정 프롬프트를 통해 그대로 출력할 수 있음을 입증하였다[15]. 둘째, 데이터 재조합 위험이다. Nasr 등(2023)은 모델이 학습한 개별 데이터 조각들을 재조합하여 특정 개인의 정보를 추론해내는 것이 기술적으로 가능함을 보여주었다[6].

생성형 AI가 제기하는 위험은 대상이 아동일 때 더욱 심각해진다. 인지적으로 미성숙한 아동은 '데이터 프라이버시' 개념이나 자신의 정보 공유가 초래할 결과를 예측하는 데 한계가 있다. Stoilova 등(2020)의 연구는 아동이 사적인 대인 관계의 프라이버시 개념은 알지만, 생성형 AI와 같은 상업적·기관적 맥락에서 자신의 데이터가 어떻게 처리되는지에 대해서는 인식이 부족하다는 점을 보여준다[16]. 그러나 생성형 AI와의 대화에서 아동이 실시간으로 입력하는 모든 정보에 대해 개입하는 것은 현실적으로 어려우므로, 아동의 발달 단계를 고려한 교육 현장의 보호 전략이 요구된다.

2.2 교사 역할의 이론적 기반

생성형 AI 환경에서 교사의 개인정보 보호 책무는 기존의 교직 전문성 담론에서 그 이론적 기반을 찾을 수 있다. Strike와 Soltis(2009)는 교사를 단순한 지식 전달자가 아니라, 학생의 이익을 위해 행동할 법적·윤리적 책무를 지닌 전문가로 규정하며, 이를 '전문가적 품행'과 '학생에 대한 헌신'으로 개념화하였다[17]. 이러한 전문가적 책무는 '학생을 위험으로부터 보호할 의무', '학생의 자율성을 존중할 의무', 그리고 '학생이 스스로를 보호할 역량을 기를 수 있도록 교육할 의무'를 포괄한다. 생성형 AI가 야기하는 프라이버시 위험 속에서, 교사가 기술 사용의 안내자를 넘어 적극적인 보호자이자 교육자로 기능해야 하는 당위성은 바로 이러한 전문가적 책무에서 도출된다.

이러한 전문가적 책무는 구체적인 역할 이론을 통해 실천적으로 구현된다. 첫째, '교육할 의무'는 Ribble(2015)의 '디지털 시민성(Digital Citizenship)' 개념으로 구체화된다. 디지털 시민성 교육은 학생들이 온라인에서 책임감 있게 행동하고 스스로를 보호할 수 있는 역량을 기르도록 돕는 것을 교사의 핵심 역할로 규정한다[18]. 이는 학생이 생성형 AI의 위험을 인지하고 자신의 개인정보를 방어할 수 있도록 역량을 강화하는 '교육자(Educator)' 역할의 이론적 근거가 된다.

둘째, '위험으로부터 보호할 의무'는 그 실천 방식에 따라 두 가지 이론적 기반으로 분화된다. 학생의 미디어 사용에 직접 개입하는 방식은 Livingstone과 Helsper(2008)의 '미디어 중재(Media Mediation)' 이론으로 설명된다. 이 이론은 교사의 개입 방식을 '제한적 중재'(규칙 설정과 통제)와 '모니터링'(사용 확인) 등으로 유형화한다[19]. 이는 각각 위험 정보의 입력을 차단하는 '수문자(Gatekeeper)' 역할과 사용 과정을 관찰하고 대응하는 '감독자(Monitor)' 역할의 이론적 기반을 제공한다. 한편, 학생의 안전을 위해 법적·제도적 보호 조치를 수행하는 방식은 '신탁자 모형(Fiduciary Model)'에 근거한다. Matusov(2024)는 교사의 신탁자 의무를 학생의 이익과 목표에 가장 적합한 행동 방침을 선택하도록 돕는 교육학적 관계로 정의한다[20]. 이 모형에서 교사는 위험을 스스로 판단하기 어려운 학생을 대신해 이들의 최상의 이익을 위해 행동할 법적·윤리적 책무를 지닌 '신탁자(fiduciary)'로 규정된다. 이는 교사가 학생의 이익을 대리하여, 이들을 보호하기 위한 전문가적 판단과 법적·제도적 책무를 이행하는 '보호자(Guardian)' 역할의 이론적 토대가 된다.

마지막으로, 교사의 책무가 교실을 넘어 확장되는 근거는 ISTE의 '교육자 표준(Standards for Educators)'과 연결된다. ISTE 표준은 교사를 '리더(Leader)'로 규정하며, 학생의 주도성과 성공을 지원하고 교수 및 학습을 개선하기 위해 리더십 기회를 모색해야 함을 강조한다. 특히 이 표준은 교사가 교육 기술, 디지털 콘텐츠 및 학습 기회에 대한 공평한 접근을 옹호할 책무가 있음을 명시한다[21]. 본 연구는 생성형 AI 시대의 '공평한 접근'을 단순한 기술 활용 기회를 넘어, 프라이버시 침해 위험으로부터 보호받으며 안전하게 사용할 권리까지 포함하는 것으로 해석하였다. 이는 교사가 개별 학생의 보호를 넘어, 학교와 교육 당국 차원에서 학생의 데이터 프라이버시 권리를 정책과 시스템에 반영하기 위해 적극적으로 개입하는 '옹호자(Advocate)' 역할의 이론적 정당성을 제공한다.

2.3 선행 연구 분석 및 연구 공백

생성형 AI 교육에 관한 선행 연구는 크게 세 가지 흐름으로 분류할 수 있다. 첫째, 교육적 효과성을 검증하는 연구이다. Kasneci et al.(2023)은 ChatGPT의 개인화 학습 지원과 즉각적 피드백 기능의 잠재력을 제시하였다[3]. 이러한 연구들은 생성형 AI의 교육적 가능성을 조명하였으나, 학생 데이터 처리 과정이나 이와 관련한 교사의 보호 조치와 같은 프라이버시 쟁점에 대한 논의는 상대적으로 부족하였다.

둘째, AI 윤리 및 기술적 위험을 분석하는 연구이다. Weidinger et al.(2021)은 대규모 언어 모델에 내재된 편향성과 안전성 위험을 체계적으로 분석하였다[22]. 이들 연구는 기술적·철학적 차원에서 중요한 통찰을 제공하지만, K-12 교육 현장에서 교사가 실행 가능한 구체적인 실천 방안으로 연결되기에는 한계가 있다.

셋째, 교육 정책과 교사 역할을 거시적으로 탐색하는 연구이다. Holmes et al.(2022)은 AI와 교육을 인권, 민주주의, 법치 관점에서 비판적으로 분석하며 거시적 정책 방향을 제시하였다[23]. 또한 Yun(2025)은 국내 문헌 고찰을 통해 생성형 AI 시대 교사 역할 재정립의 필요성을 제기하였다[24]. 이러한 연구들은 정책적 담론 형성에 기여했으나, 학생 개인정보 보호라는 특정 맥락에서 교사의 역할을 실증적으로 분석하고 유형화하는 단계까지는 나아가지 못했다.

종합하면, 선행 연구들은 생성형 AI의 교육적 활용 가능성, 윤리적 위험, 정책적 방향성을 제시하였으나, 학생 개인정보 보호를 위한 교사의 실천적 역할을 체계적으로 분석한 연구는 제한적이다. 본 연구는 국내외 가이드라인의 실증 분석을 통해 교사 역할을 구체적으로 유형화함으로써 이러한 연구 공백을 채우고자 한다.

3. 연구 방법

3.1 연구 설계

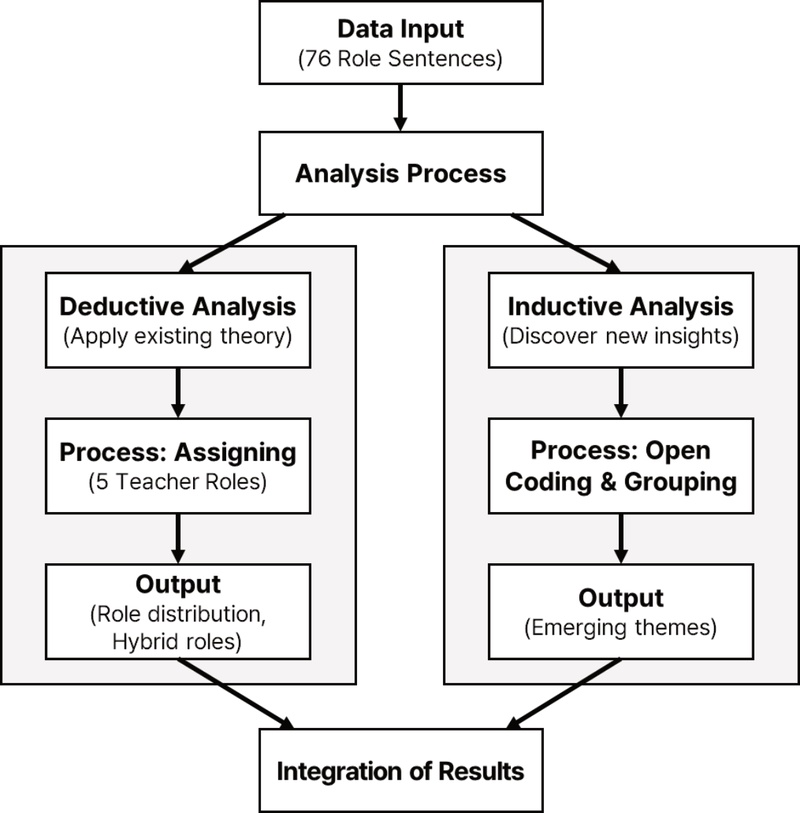

이 연구는 Hsieh와 Shannon(2005)의 지향적 질적 내용분석(Directed qualitative content analysis)을 연구 방법으로 채택하였다[25]. 지향적 질적 내용분석은 기존 이론이나 연구를 바탕으로 초기 코딩 체계를 설정하고, 분석 과정에서 새로운 주제를 귀납적으로 발견하는 방법으로, 본 연구와 같이 생성형 AI 교육 맥락에서 교사 역할 이론을 검증하고 확장하는 데 적합하다.

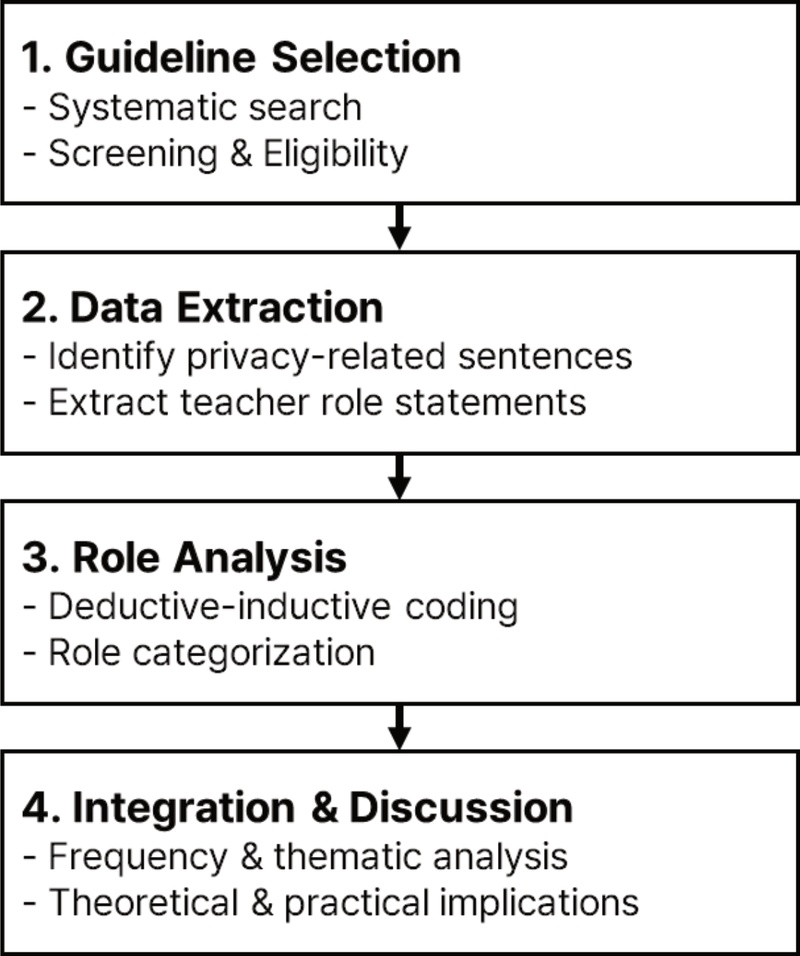

이 연구의 전체 프레임워크는 Figure 1과 같이 4단계로 구성된다. 1단계에서는 체계적 선별 과정을 통해 생성형 AI 교육 가이드라인을 수집하고, 2단계에서는 수집한 문헌으로부터 학생 개인정보 보호와 관련된 교사 역할 문장을 추출하였다. 3단계에서는 추출된 역할 문장에 대해 연역적-귀납적 통합 코딩을 수행하여 교사 역할을 분류하고 확장하였으며, 4단계에서는 빈도 분석과 주제 분석을 결합하여 각 역할의 상대적 중요도와 세부 특성을 규명하는 종합 논의를 진행하였다.

분석 단위는 '교사의 개인정보 보호 역할을 서술하는 문장'으로 설정하였다. "교사는 학생들에게 개인정보를 AI에 입력하지 않도록 교육해야 한다"와 같은 문장이 하나의 분석 단위가 된다. 분석 목표는 수집한 문장들을 역할 유형으로 분류하고, 세부 주제를 도출하며, 역할 간의 관계와 패턴을 규명하는 것이다.

이러한 분석은 연역적 접근과 귀납적 접근을 통합하여 수행하였다. 연역적 분석은 2.2절에서 도출한 이론적 틀을 분석 코드로 설정하여 역할 문장을 체계적으로 분류하고, 각 역할 유형의 상대적 강조점을 파악하는 데 활용되었다. 귀납적 분석은 데이터 자체에서 출발하여, 기존 이론의 범주에 포섭되지 않는 생성형 AI 맥락의 새로운 패턴이나 세부 주제를 발견하는 데 초점을 맞추었다. 이러한 통합적 접근을 통해 이론적 틀을 검증하는 동시에 새로운 주제를 포착하고자 하였다.

연구의 신뢰성과 타당성을 확보하기 위해 다음과 같은 절차로 연구를 수행하였다. 첫째, 코딩의 일관성과 이론적 타당성을 확보하기 위해 2.2절에서 도출한 이론적 틀을 바탕으로 각 역할 유형의 정의와 코딩 기준을 수립하고, 모든 역할 문장에 적용하여 분류하였다. 분류가 모호한 문장의 경우 원문 맥락으로 돌아가 반복적으로 재검토하였다. 둘째, 분석 과정의 투명성을 확보하기 위해 가이드라인 선별 기준, 역할 문장 추출 조건, 코딩 절차를 명시적으로 기술하였으며, 전체 분석 과정은 Microsoft Excel을 활용하여 체계적으로 관리하였다.

3.2 분석 대상 선정

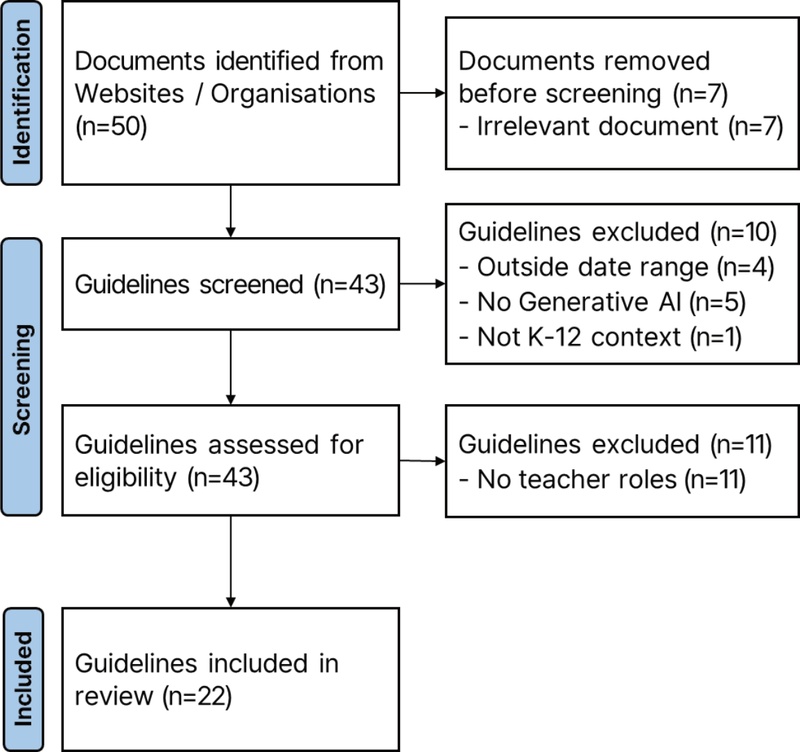

분석 대상 선정을 위해 국제기구, 각국 교육부 홈페이지, Google Scholar 등에서 '생성형 AI', '교육', 'K-12', '가이드라인' 등의 주요 키워드로 관련 문헌을 수집하여 총 50개의 문서를 확보하였다. 이 중 연구 보고서, 법률 원문, 상위 전략문서와 같이 교사의 실천적 지침을 포함하지 않은 7개 문서를 1차 제외하였다.

1차 선별된 43개의 문서를 대상으로 다음과 같은 4가지 선별 기준을 적용하였다. 첫째, 생성형 AI가 본격적으로 확산한 시점인 2022년 11월(ChatGPT 공개) 이후에 발행된 문서여야 한다. 둘째, 'Generative AI', 'GenAI', 'LLM' 등 생성형 AI를 명시적으로 다루어야 한다. 셋째, 'K-12', 'school', 'teacher' 등 초·중등 교육 맥락에 초점을 맞추어야 한다. 넷째, 교사의 학생 개인정보 보호 역할을 기술한 문장을 1개 이상 포함해야 한다. 이때 '교사 역할 문장'은, 문장의 주체(교사), 대상(학생 개인정보), 행위(구체적 보호 행동)라는 3가지 조건을 모두 충족하는 경우로 한정하여 분석의 일관성을 확보하였다.

Figure 2와 같이 선정 절차를 거쳐 최종 22개 가이드라인이 분석 대상으로 확정되었으며, 이 문서들로부터 총 76개의 유효한 역할 문장을 추출하였다.

3.3 분석 절차

분석 절차는 Figure 3과 같이 연역적 분석과 귀납적 분석의 두 단계로 구성된다.

첫 번째 연역적 분석에서는 76개의 역할 문장을 5가지 교사 역할 유형—교육자, 수문자, 보호자, 감독자, 옹호자—으로 분류하였다. 각 문장을 가장 적합한 1개의 유형에 할당하고 빈도와 비중을 산출하여, 가이드라인에서 강조하는 교사 역할의 우선순위를 파악하였다. 또한, 하나의 문장이 두 가지 이상의 역할을 동시에 포함하는 복합 역할이 존재하는지 확인하였다.

두 번째 귀납적 분석은 연역적 분석 틀에 얽매이지 않고 데이터 자체에서 생성형 AI 맥락의 독특한 의미와 패턴을 발견하는 데 목적을 두었다. 76개 문장 각각에 'pii_input_prohibition'(개인정보 입력 금지), 'risk_education'(위험 교육) 등 핵심 의미를 나타내는 코드를 부여하는 개방 코딩을 진행하였다. 이후 부여된 코드들을 지속적으로 비교하고 그룹화하여 각 역할 유형 내의 세부 주제를 도출하였다. 이 과정을 통해 '사전 도구 검토', '학부모 동의 관리' 등 이론적 틀로는 포섭되지 않는 새로운 주제를 발견하였다.

4. 교사 역할별 분석 및 논의

4.1 교사 역할의 유형

총 76개의 역할 문장을 5가지 역할 유형으로 분류한 결과는 Table 1과 같다. 교육자 역할이 31건(40.8%)으로 가장 높은 비중을 차지했으며, 그 뒤를 이어 수문자 23건(30.3%), 보호자 20건(26.3%), 감독자 16건(21.1%) 순으로 나타났다. 반면, 옹호자 역할은 1건(1.3%)으로 가장 낮은 비중을 보였다. 전체 76개 문장 중 13건(17.1%)은 두 가지 이상의 역할을 동시에 포함하는 복합 역할로 식별되어 중복으로 집계하였다.

가장 빈도가 높은 두 역할인 교육자와 수문자를 합한 비중은 71.1%에 달하였다. 이는 현행 가이드라인이 학생의 자기 보호 역량을 강화하는(교육자) 동시에, 교사가 개인정보 입력을 직접 통제·차단하는(수문자) 이중적 접근을 강조하고 있음을 보여준다.

4.2 역할별 세부 주제

교육자 역할의 세부 주제는 74건이 도출되었으며, 상위 3개 주제는 Table 2와 같다. 생성형 AI의 프라이버시 위험성을 직접적으로 알리는 '위험 교육'(23.0%)이 가장 높은 비중을 차지했으며, '개인정보 입력 금지'(9.5%), '프라이버시 교육'(8.1%) 순으로 나타났다. 이는 학생의 자기 보호 역량을 강화하는 것을 우선시하고 있음을 시사한다. 다음으로 '개인정보 입력 금지'가 강조되는 것은, 구체적인 행동 지침을 제공하는 것이 중요하게 다루어지고 있음을 보여준다.

수문자 역할의 세부 주제는 55건이 도출되었으며, 상위 3개 주제는 Table 3과 같다. 교사가 학생의 개인정보 입력을 직접 통제하는 '개인정보 입력 금지'(27.3%)가 가장 강조되었다. 다음으로 '위험 교육'(14.5%)과 '미승인 도구 사용 금지'(5.5%)가 뒤를 이었다. '개인정보 입력 금지'가 가장 높은 비중을 차지한 것은 교사의 즉각적이고 통제적인 개입이 필수적임을 강조한다. '위험 교육'이 중첩적으로 나타나는 것은, 통제와 교육이 함께 수행될 필요가 있음을 보여준다.

보호자 역할의 세부 주제는 46건이 도출되었으며, 상위 3개 주제는 Table 4와 같다. 교사의 법적 책무가 강조되어 '법규 준수'(19.6%)와 'FERPA/COPPA 준수'(10.9%) 항목이 높은 비중을 차지했으며, '학부모 동의 요구'(6.5%)가 뒤를 이었다. 세부 주제가 법적 의무와 직접적으로 연결된 것은, 교사가 학생의 데이터를 책임지는 법정 대리인의 특성이 있음을 의미한다. 이는 '학부모 동의 요구' 항목과도 연결되어, 교사가 학교와 가정 사이의 개인정보 흐름을 관리해야 함을 나타낸다.

감독자 역할의 세부 주제는 39건이 도출되었으며, 상위 3개 주제는 Table 5와 같다. '정책 검토'(17.9%)와 '도구 검토 및 평가'(12.8%)가 주요 항목으로 도출되었고, '법규 준수 확인'(7.7%)이 뒤를 이었다. 감독자 역할의 핵심이 학생의 사용을 지켜보는 사후적 모니터링이 아니라, AI 도구 도입 전 '정책 검토'와 '도구 평가'라는 사전적 위험 관리 활동에 집중된 점이 주목할 만하다. 이는 4.4절에서 논의할 '사전 도구 검토'라는 새로운 책무와도 연관되며, 교사에게 기술적·행정적 전문성이 요구되고 있음을 보여준다.

옹호자 역할의 세부 주제는 총 4건이 도출되었다. '능동적 모니터링', '외부 보고', '규제 당국 문제 제기', '내부 고발'이라는 세부 주제로 이루어져 있다. 이 역할의 빈도가 현저히 낮은 것은 현재의 가이드라인이 교사 개인의 실천(교실 단위의 미시적 대응)에 집중하고, 교사가 학교 정책이나 서비스 제공자에게 시스템적 개선을 요구하는 '개별 교실을 넘어선 대응'은 거의 논의되지 않음을 드러낸다.

4.3 역할 문장의 특성

추출된 76개 역할 문장의 특성을 구속력과 구체성 측면에서 분석하였다. Table 6과 같이, 문장의 구속력은 대부분 '권고' 수준(27.6%)이 아닌 '의무' 수준(72.4%)으로 규정되었다. 또한 Table 7과 같이, 문장의 구체성 역시 '높음'(78.9%) 수준의 서술이 '중간'(19.7%)이나 '낮음'(1.3%)보다 크게 나타났다. 이는 현행 가이드라인이 교사에게 모호한 권고가 아닌, 명확하고 구체적인 실천 행위를 요구하고 있음을 시사한다.

앞서 언급한 13건의 복합 역할에 대한 조합 유형 분석 결과는 Table 8과 같다. '교육자 + 수문자' 조합이 61.5%(8건)로 가장 높은 비중을 차지했으며, '교육자 + 감독자 + 수문자'(15.4%, 2건), '교육자 + 보호자'(7.7%, 1건) 등이 뒤를 이었다. 특히 '교육자 + 수문자' 조합이 복합 역할의 절반 이상을 차지하는 것은, 예방적 교육과 통제적 차단이 분리된 역할이 아니라 동시에 수행되어야 할 통합적 책무로 제시되고 있음을 보여준다.

4.4 귀납적 분석을 통한 새로운 주제

5가지 연역적 역할 범주 외에도, 귀납적 분석 과정에서 생성형 AI의 특수성을 반영하는 새로운 주제들이 도출되었다.

첫째, '사전 도구 검토'는 교사가 AI 도구를 교실에 도입하기 전, 해당 서비스의 개인정보 처리 방침, 데이터 보안 수준, 법규 준수 여부를 사전에 검토하고 평가하는 책무를 의미한다. 이는 '감독자' 역할의 '도구 검토'를 넘어, 도구의 안전성을 평가하고 도입 여부의 결정에 관여하는 복합적 책임이다. 둘째, '학부모 동의 관리'는 단순한 동의서 취합 행위를 넘어, AI 도구의 기능과 내재된 위험을 학부모에게 명확히 설명하고, 동의 여부를 안전하게 기록·관리하는 포괄적인 책임을 지칭한다. 셋째, '데이터 생애주기 관리'는 학생 데이터의 수집부터 폐기까지 전 과정에 교사가 관여하는 책무이다. 여기에는 데이터 최소화 원칙의 적용, 불필요한 데이터의 저장 기간 관리, 서비스 탈퇴 시 안전한 삭제 확인 등이 포함된다.

4.5 교사 역할 모델의 통합

연역적 분석을 통해 도출한 5가지 교사 역할 유형과 귀납적 분석을 통해 발견한 신규 책무를 통합하여, Table 9와 같이 생성형 AI 환경에서의 교사 역할 모델을 제시한다. 이 모델은 이론적 틀에 기반한 연역적 역할과 가이드라인 분석에서 귀납적으로 발견된 새로운 역할을 체계적으로 통합하였다.

4.6 종합 논의

이 연구는 디지털 시대 교사 역할 이론을 생성형 AI라는 새로운 기술 맥락에서 검증하고 확장했다는 점에서 이론적 의의가 있다. 교육자 역할(40.8%)이 가장 높은 비중으로 나타난 것은 Ribble(2015)이 강조한 디지털 시민성 교육이, 기술적 환경의 변화에도 불구하고 여전히 학생 보호의 핵심 기제임을 실증한다[18]. 수문자 역할(30.3%)이 중요하게 다뤄지는 것은 생성형 AI의 데이터 학습 메커니즘이 지닌 위험성으로 인해, 교육을 통한 학생의 역량 강화만으로는 불충분하며 기술적 통제가 필요함을 보여준다. 보호자 역할(26.3%)과 감독자 역할(21.1%)도 상당 부분을 차지하는데, 이는 교사가 법적 책무를 이행하고 AI 도구를 사전에 검토하는 제도적 책임을 수행해야 함을 의미한다.

반면, 옹호자 역할(1.3%)이 현저히 낮게 나타난 것은 현재 논의가 교실 단위의 미시적 대응에 치중되어 있음을 보여준다. 이는 가이드라인 발행 주체가 교사를 정책 이행자로 규정하는 경향, 생성형 AI 도입 초기 단계에서 즉각적 안전조치를 우선시하는 현실, 그리고 교사의 정책적 권한에 대한 제한적 인식이 복합적으로 작용한 결과로 해석된다. 생성형 AI 도입의 최전선에 있는 교사가 학교 정책과 서비스 설계에 개입할 수 있는 제도적 통로 마련이 필요함을 시사한다.

복합 역할에서 '교육자 + 수문자' 조합(61.5%)이 빈번하게 등장하는 것은, 예방적 교육과 통제적 차단이 상호 배타적인 것이 아니라 생성형 AI 환경에서 병행되어야 할 상보적 책무임을 시사한다. 나아가 귀납적으로 발견된 '사전 도구 검토', '학부모 동의 관리', '데이터 생애주기 관리'는, 기존 교사 역할 이론의 틀로는 포섭되지 않는 새로운 책무가 등장했음을 보여주며, 향후 교사 역할 이론의 확장 필요성을 제기한다.

연구 결과는 교사 교육 프로그램의 방향성에 대한 시사점을 제공한다. 학생의 자기 보호 역량을 기르는 교육자 역할과 AI 도구의 기술적 위험을 관리하는 수문자 역할에 대한 교육 내용이 핵심적으로 다루어져야 한다. 또한 '사전 도구 검토', '학부모 동의 관리', '법규 준수 확인'은 학교 현장에서 AI 도구 도입 시 활용할 수 있는 제도적 점검 항목으로 직접 기능할 수 있다. 역할 문장의 72.4%가 '의무' 수준이고 78.9%가 '높은 구체성'을 보인 것은, 현행 가이드라인이 교사에게 상당한 책무를 부과하고 있음을 의미한다. 교사가 이러한 책무를 효과적으로 수행하기 위해서는 교사 교육, 기술 지원, 제도적 뒷받침이 병행되어야 한다.

5. 결론

이 연구는 생성형 AI 교육 환경에서 학생 개인정보 보호를 위한 교사의 역할을 규명하고자 22개 국내외 가이드라인을 지향적 질적 내용분석 방법으로 분석하였다. 총 76개의 역할 문장을 분석한 결과, 교사 역할은 교육자, 수문자, 보호자, 감독자, 옹호자의 5가지 핵심 유형으로 분류되었다.

분석 결과, 생성형 AI 맥락에서 교사의 개인정보 보호 역할은 단일하지 않고 복합적이다. 학생의 자기 보호 역량을 강화하는 교육자 역할(40.8%)이 가장 강조되었으며, 동시에 기술적 위험을 즉각적으로 차단하는 수문자 역할(30.3%) 또한 중요하게 다루어졌다. 두 역할이 모두 높은 비중을 차지하는 것은 예방적 교육과 통제적 접근이 병행되어야 함을 보여준다. 반면, 시스템적 변화를 추구하는 옹호자 역할(1.3%)은 현저히 부족하여, 현행 가이드라인이 교실 수준의 미시적 대응에 집중하고 있음을 확인하였다.

이 연구는 다음과 같은 점에서 학술적·실천적 의의가 있다. 첫째, 생성형 AI 교육 환경에서 교사의 개인정보 보호 역할을 체계적으로 유형화하였다. 교사 역할을 교육자(40.8%), 수문자(30.3%), 보호자(26.3%), 감독자(21.1%), 옹호자(1.3%)의 5가지 유형으로 구체화하고, 상대적 중요도와 역할별 세부 주제를 규명하였다. 둘째, 디지털 시대 교사 역할 이론을 생성형 AI 맥락에서 검증하고 확장하였다. 교육자 역할이 가장 높은 비중으로 나타난 것은 디지털 시민성 교육이 기술 환경 변화에도 여전히 학생 보호의 핵심 기제임을 실증한다. 특히 귀납적 분석을 통해 '사전 도구 검토', '학부모 동의 관리', '데이터 생애주기 관리'와 같은 새로운 책무를 발견함으로써, 생성형 AI 맥락에서 교사 역할의 확장 가능성을 제시하였다. 셋째, 실천적 측면에서 교사 역할 모델은 교사 교육 프로그램 개발과 학교 현장의 AI 도구 도입 절차 수립에 활용될 수 있다. 교사 역할과 세부 주제는 교사 연수 내용 구성의 기반이 되며, '사전 도구 검토', '학부모 동의 관리', '법규 준수 확인'은 AI 도구 도입·운영 시 점검 항목으로 활용할 수 있다.

이 연구는 가이드라인 문서에 기반한 내용분석이라는 방법론적 한계가 있다. 가이드라인은 규범적 지침을 제시하는 문서로서, 실제 교육 현장에서 교사들이 수행하는 역할과 차이가 있을 수 있다. 본 연구에서 도출한 교사 역할 모델에 대한 실증적 검증이 이루어지지 않았으며, 교사 역할에 초점을 맞추어 학교 관리자나 정책 입안자 등 다른 주체들의 역할은 다루지 않았다. 향후 교사 심층 인터뷰나 수업 관찰을 통해 교사 역할 모델이 실제 현장에서 어떻게 구현되는지 검증하는 연구가 필요하다. 또한 5가지 역할 유형과 세부 책무를 기반으로 교사 역량 개발 프로그램을 개발하고 그 효과성을 검증하는 후속 연구가 이루어질 필요가 있다.

생성형 AI의 안전한 활용은 학생 보호를 위한 교사의 전문성에 달려있다. 이 연구에서 규명한 교사의 복합적 역할이 현장에서 효과적으로 수행되기 위해서는, 체계적인 교사 교육과 명확한 제도적 지원이 뒷받침되어야 한다. 이 연구가 학생의 개인정보를 보호하면서도 AI의 교육적 잠재력을 실현하는 안전한 학습 환경을 조성하는 데 기여하기를 기대한다.

Acknowledgments

이 논문은 2025년도 교육부 및 서울특별시의 재원으로 서울RISE센터의 지원을 받아 수행된 지역혁신중심대학 지원체계(RISE)의 결과이며 한국정보통신진흥협회의 협력 및 자문을 통해 수행되었습니다. (2025-RISE-01-018-04)

References

- Park, E., & Sidoti, O. (2025, January 15). About a quarter of U.S. teens have used ChatGPT for schoolwork, double the share in 2023. Pew Research Center. https://pewrsr.ch/4g3Jqt0

- Lee, C. H., Mo, S. H., Bae, S. R., & Lee, S. Y. (2024). A study on the use of generative AI by youth and measures to enhance literacy (청소년의 생성형 AI 이용실태 및 리터러시 증진방안 연구). Korea Youth Policy Institute. https://www.nkis.re.kr/subject_view1.do?otpId=OTP_0000000000015181&otpSeq=0&eoSeq=0

-

Kasneci, E., Sessler, K., Küchemann, S., Bannert, M., Dementieva, D., Fischer, F., Gasser, U., & Kasneci, G. (2023). ChatGPT for good? On opportunities and challenges of large language models for education. Learning and Individual Differences, 103, 102274.

[https://doi.org/10.1016/j.lindif.2023.102274]

- Korea Communications Commission, & Korea Information Society Development Institute. (2025). Results of the 2024 Korean Intelligent Information Society User Panel Survey (2024년 지능정보사회 이용자 패널조사 결과). Korea Communications Commission. https://www.kisdi.re.kr/report/view.do?key=m2101113024770&masterId=3934580&arrMasterId=3934580&artId=1833198

- Nelson, J. (2023, June 23). Hackers Leak Over 100,000 ChatGPT Credentials on the Dark Web. Yahoo Finance. https://finance.yahoo.com/news/hackers-leak-over-100-000-233933341.html

-

Nasr, M., Carlini, N., Hayase, J., Jagielski, M., Cooper, A. F., Ippolito, D., Choquette-Choo, C. A., Wallace, E., Tramèr, F., & Lee, K. (2023). Scalable extraction of training data from (production) language models. arXiv preprint arXiv:2311.17035.

[https://doi.org/10.48550/arXiv.2311.17035]

- Euronews. (2024, December 20). Italy's privacy watchdog fines OpenAI €15 million after probe into ChatGPT data collection. https://www.euronews.com/next/2024/12/20/italys-privacy-watchdog-fines-openai-15-million-after-probe-into-chatgpt-data-collection

- Family Educational Rights and Privacy Act, 20 U.S.C. § 1232g (1974).

-

Children's Online Privacy Protection Act of 1998, 15 U.S.C. §§ 6501-6506 (1998).

[https://doi.org/10.1016/S1353-4858(00)87599-6]

- Regulation (EU) 2016/679 of the European Parliament and of the Council of 27 April 2016 on the protection of natural persons with regard to the processing of personal data and on the free movement of such data, and repealing Directive 95/46/EC (General Data Protection Regulation). (2016). Official Journal of the European Union, L 119/1.

- Korea Legislation Research Institute. (2023). Personal Information Protection Act https://elaw.klri.re.kr/eng_service/lawView.do?lang=ENG&hseq=62389

- UNICEF Office of Global Insight and Policy. (2024, March 13). How can generative AI better serve children's rights? UNICEF. https://www.unicef.org/innocenti/how-can-generative-ai-better-serve-childrens-rights

- UNESCO. (2023). Guidance for generative AI in education and research. UNESCO Publishing. https://www.unesco.org/en/articles/guidance-generative-ai-education-and-research

- Nissenbaum, H. (2004). Privacy as contextual integrity. Washington Law Review, 79(1), 119-157. https://digitalcommons.law.uw.edu/wlr/vol79/iss1/10/

- Carlini, N., Tramèr, F., Wallace, E., Jagielski, M., Herbert-Voss, A., Lee, K., Roberts, A., Brown, T., Song, D., Erlingsson, Ú., Oprea, A., & Raffel, C. (2021). Extracting training data from large language models. Proceedings of the 30th USENIX Security Symposium (USENIX Security 21), Vancouver, Canada. https://arxiv.org/abs/2012.07805

-

Stoilova, M., Livingstone, S., & Nandagiri, R. (2020). Digital by Default: Children's Capacity to Understand and Manage Online Data and Privacy. Media and Communication, 8(4), 197–207.

[https://doi.org/10.17645/mac.v8i4.3407]

- Strike, K. A., & Soltis, J. F. (2009). The ethics of teaching (5th ed.). Teachers College Press.

- Ribble, M. (2015). Digital citizenship in schools: Nine elements all students should know (3rd ed.). International Society for Technology in Education (ISTE).

-

Livingstone, S., & Helsper, E. J. (2008). Parental mediation of children's internet use. Journal of Broadcasting & Electronic Media, 52(4), 581-599.

[https://doi.org/10.1080/08838150802437396]

-

Matusov, E. (2024). The teachers' pedagogical fiduciary duty to their students. Integrative Psychological and Behavioral Science, 58, 1235-1260.

[https://doi.org/10.1007/s12124-022-09690-8]

- ISTE. (2017). ISTE Standards for Educators. International Society for Technology in Education. https://iste.org/standards/educators

-

Weidinger, L., Mellor, J., Rauh, M., Griffin, C., Uesato, J., Huang, P. S., Cheng, M., Glaese, M., Balle, B., Kasirzadeh, A., Kenton, Z., Brown, S., Hawkins, W., Stepleton, T., Biles, C., Birhane, A., Haas, J., Rimell, L., Hendricks, L. A., ... Gabriel, I. (2021). Ethical and social risks of harm from language models. arXiv preprint arXiv:2112.04359, .

[https://doi.org/10.48550/arXiv.2112.04359]

- Holmes, W., Persson, J., Chounta, I. A., Wasson, B., & Dimitrova, V. (2022). Artificial intelligence and education: A critical view through the lens of human rights, democracy and the rule of law. Council of Europe. https://rm.coe.int/1680a956e3

-

Yun, S. (2025). Paradigm Shift in Education in the Era of Generative AI and the Redefinition of Teachers' Roles. Korean Journal of Religious Education, 80, 109-126.

[https://doi.org/10.58601/kjre.2025.03.30.07]

-

Hsieh, H. , & Shannon, S. E. (2005). Three approaches to qualitative content analysis. Qualitative Health Research, 15(9), 1277-1288.

[https://doi.org/10.1177/1049732305276687]

Appendix

부록

논문 작성 보조 도구로 Claude Sonnet 4.5와 Gemini 2.5 pro를 활용하였으며, 모든 연구 내용과 결과 해석은 저자가 직접 수행하고 최종 검증을 완료하였습니다.

· 2020년 인하대학교 행정학과(학사)

· 2022년 인하대학교 산업보안거버넌스전공(석사)

· 2025년~현재 성균관대학교 컴퓨터교육과 박사 과정

관심분야 : 개인정보 보호, 정보보안, 인공지능 윤리, 컴퓨터 교육

jh21park@skku.edu

· 1998년 성균관대학교 정보공학과(공학박사)

· 1990년~1995년 KIST/SERI 연구원

· 1996년 정보통신기술사

· 2022년~현재 기술안보포럼 좌장

· 2023년~현재 한국청소년활동진흥원 자문위원

· 1999년 3월~현재 성균관대학교 컴퓨터교육과 교수

관심분야 : 네트워크관리, AI 윤리, 기술보호, AI 교육

sjahn@skku.edu