형성적 피드백 프레임워크 기반 생성형 AI의 비판적 글쓰기 피드백 효과 및 학생 인식 분석

초록

본 연구는 형성적 피드백 이론을 바탕으로, 생성형 인공지능이 제공하는 비판적 글쓰기 피드백의 교육적 타당성과 학생 인식을 탐색하였다. 연구는 문제 분석, 설계 및 개발, 실행, 평가 단계로 진행되었다. 인공지능 피드백 프롬프트는 비판적 글쓰기 루브릭과 슈츠의 피드백 원칙인 명료성, 구체성, 학습자 중심성 등에 따라 설계되었으며, 실제 정보문화 단원 수업에 적용되었다. 학생 설문과 전문가 타당도 검토 결과, 인공지능 피드백은 글의 구조적 개선 방향을 명확히 제시하고 학습 동기를 높이는 긍정적 효과를 보였다. 이 연구는 생성형 인공지능이 단순한 언어 도구를 넘어 학습을 지원하는 형성적 피드백 도구로 활용될 가능성을 보여준다.

Abstract

This study explored the educational validity of generative AI feedback on critical writing and students’ perceptions, based on formative feedback theory. The research was conducted through the stages of problem analysis, design and development, implementation, and evaluation. The AI feedback was designed according to a critical writing rubric and Shute formative feedback principles—clarity, specificity, and learner-centeredness—and applied in an actual Information Culture unit. Based on student surveys and expert validity reviews, the AI feedback showed positive effects by clearly suggesting directions for structural improvement in writing and enhancing learners’ motivation. The study demonstrates the potential of generative AI to serve not merely as a linguistic tool but as a formative feedback tool that supports learning.

Keywords:

Computer Education, Generative Artificial Intelligence, Formative Feedback, Critical Writing, Information and Media Literacy키워드:

컴퓨터 교과교육, 생성형 인공지능, 형성적 피드백, 비판적 글쓰기, 정보문화1. 서론

2022 개정 교육과정은 디지털 대전환 시대에 대응하여 학생의 주도성과 비판적 사고 역량을 핵심으로 제시하며, 문제해결을 위한 ‘깊이 있는 학습’을 강조하고 있다[1]. 이러한 교육적 변화에 따라, 정보 교과를 포함한 다양한 교과 현장에서는 단순 지식 암기를 넘어 학생 스스로 논쟁적 질문을 탐구하고 자신의 견해를 논리적으로 서술하는 ‘비판적 글쓰기’ 기반의 서·논술형 평가가 확대되는 추세이다. 특히 정보 문화 단원에서의 비판적 글쓰기는 하나의 정답을 도출하지 않는다. 정보 사회에서 발생하거나 또는 발생할 수 있는 문제 상황을 인식하고, 그 문제 상황에 관한 다양한 관점과 근거를 검토하며 자신의 입장을 합리적으로 정당화하는 고차원적인 사고 과정을 요구한다. 정보 문화 단원에서의 비판적 글쓰기는 학생들이 정보 사회의 쟁점과 가치 판단을 실제적으로 탐구하고, 서로 다른 관점의 타당성을 비교·판단하는 경험을 제공함으로써, 정보사회에서 요구되는 의사 결정 능력을 함양할 수 있다[2].

비판적 글쓰기 능력은 고차원적 사고 기능을 촉진하는 핵심 활동이지만[3], 학생이 유의미한 성장을 이루기 위해서는 자신의 현재 수행 수준과 목표 수준 간의 격차를 줄여주는 형성적 피드백(formative feedback)이 필수적으로 요구된다[4]. 효과적인 피드백은 학습자가 자신의 수행을 평가하고 학습을 자기 조절하는 데 필수적인 역할을 한다[5].

하지만 교수자는 한정된 시간과 자원으로 인해 모든 학습자에게 개별화된 피드백을 충분히 제공하기 어려운 실정이다[6]. 이와 같은 제약은 맞춤형 교육 경험 제공에 걸림돌이 되며, 결과적으로 학습자 간의 학업 성취 격차를 더욱 심화시킬 수 있다[7]. 이를 극복하기 위한 대안으로 AI 기반 학습 지원 기술이 주목받고 있으며, 특히 생성형 AI는 교육적 격차 해소에 기여할 수 있는 유망한 도구로 평가받고 있다[8].

선행 연구에 따르면 AI 기반 피드백에는 한계점이 존재한다. 피드백 품질 측면에서는 AI가 제공하는 피드백이 맥락을 충분히 반영하지 못하거나, 정보가 과도하거나 표현이 모호한 경우가 많아 정확성이 떨어질 수 있다. 이에 따라 학습자는 피드백을 효과적으로 활용하지 못할 가능성이 있다[9, 10]. 또한, 학습자의 모호한 반응을 AI가 과도하게 오류로 해석하는 경향[11]이나 결정적인 오류보다 사소한 오류에 지나치게 초점을 맞추는 경향[12, 13] 역시 AI 피드백의 구조적 한계로 지적된다. 시스템적 측면에서는 동일한 입력에도 항상 다른 출력을 생성하는 생성형 AI의 특성 때문에 연구 결과의 재현성을 확보하기 어렵다는 근본적인 제약이 있다[14]. 이러한 한계를 고려했을 때, 생성형 AI 피드백의 효과는 실제 학습 환경의 조건과 맥락에 따라 달라질 수 있으므로, 이를 규명하기 위한 경험적 검증과, 축적된 개별 연구를 통합하여 체계적으로 비교 분석하는 접근이 필요하다[15].

따라서 본 연구는 이러한 한계점을 극복하기 위해, 생성형 AI를 단순한 기술적 도구로 활용하는 것을 넘어, 검증된 Shute의 ‘효과적인 형성적 피드백 가이드라인’을 핵심 프레임워크로 삼아 생성형 AI 피드백 시스템을 설계하였다. Shute의 프레임워크는 피드백이 가져야 할 구체성, 명확성, 정서적 지원 등의 원칙을 명확히 제시하고 있어, 학습자 중심의 교육적 피드백으로 전환하는 생성형 AI 피드백의 핵심 기제로 작용할 수 있다[16].

본 연구의 목적은 형성적 피드백 프레임워크에 기반하여 설계된 생성형 AI 피드백 시스템이 교육 전문가 관점에서 타당성을 확보하는지 검증하고, 실제 정보 문화 단원에서의 비판적 글쓰기 결과에 대한 피드백을 경험한 학생들의 인식을 심층적으로 분석하는 데 있다. 이를 통해 AI 피드백이 정보 교과에서의 비판적 글쓰기 교육에서 교사의 역할을 보완하는 효과적인 보조 도구로 기능할 수 있는지 실증적으로 탐색하고자 한다.

2. 이론적 배경

2.1 슈츠의 형성적 피드백 프레임워크

피드백은 학습자가 현재 수행 수준과 목표 간의 격차를 인지하고 이를 줄여나가도록 돕는 정보로 정의된다. 형성적 피드백은 학습 결과에 대한 평가적 판단이 아니라, 학습자가 목표에 도달하기 위해 다음에 무엇을 어떻게 개선해야 하는지를 안내하는 과정 중심의 피드백이다[4]. 이는 단순 정오 제시나 결과 중심의 피드백과 달리, 학습자의 자기 조절 학습을 촉진하는 데 목적이 있다. 특히 학습 과정에 제공되어 학습의 방향을 수정하고 개선을 유도하는 ‘형성적 피드백’은 학습 성취에 지대한 영향을 미친다[17].

Shute는 방대한 선행 연구 고찰을 통해, 학습을 촉진하는 효과적인 형성적 피드백을 위한 구체적인 가이드라인을 제시하였다. 그는 피드백이 단순히 정오(正誤)를 알려주는 것을 넘어 학습자의 인지적, 정의적 측면을 모두 고려하여 설계되어야 함을 강조한다.

본 연구에서 AI 피드백 설계를 위해 주목한 형성적 피드백 프레임워크의 핵심 원칙은 Table 1과 같다[16].

2.2 생성형 AI 기반 피드백 연구 동향

2022년 말 ChatGPT의 등장 이후로 생성형 AI 기반 피드백 연구가 폭발적으로 증가했다. 생성형 AI 기반 피드백이 학생들의 글쓰기 품질과 참여도를 유의미하게 향상시킨다는 실증적 증거가 축적되었다[18, 19]. 또한 프로그래밍 교육에서는 단순한 정오 채점을 넘어 생성형 AI가 제시한 학생 개별 코드 기반 피드백이 구체적이고, 명확하며, 교정적이며, 학습 향상을 위한 지침으로 효과적임을 증명하였다[20].

그러나 이러한 기술적 진보에도 불구하고, 생성형 AI 피드백의 교육적 적용에는 여전히 명확한 한계점이 지속적으로 보고되고 있다.

첫째, 교육적 맥락 반영의 한계이다. 다수의 AI 시스템은 문법이나 문체 등 표면적 요소에 치중하지만, 학습 목표나 평가 기준과의 연계성, 즉 피드백이 실제 학습 개선으로 이어지도록 하는 형성적 피드백의 질적 정렬성은 충분히 확보되지 못하고 있다[21]. 이는 AI가 생성하는 피드백이 학습의 질적 측면 보다는 기술적 완결성에 초점을 두고 있음을 시사한다.

둘째, 신뢰성과 일관성의 문제이다. 일부 AI 모델은 제한된 정보를 근거로 과잉 추론(over-inference)을 수행하거나, 근거 없이 긍정적인 피드백을 생성하는 과잉 칭찬(overpraise)의 경향을 보인다[18]. 또한 AI가 생성하는 피드백은 프롬프트의 표현이나 구조에 매우 민감하게 반응하여, 입력 문장의 미세한 차이가 피드백의 질에 큰 영향을 미치는 불안정성을 내포한다[21, 22].

셋째, 피드백 제공 주체에 따른 수용도 차이이다. 학습자들은 피드백의 출처가 AI임을 인지할 경우, 해당 피드백의 신뢰도나 진정성을 낮게 평가하는 경향을 보인다[23, 24]. 반면, AI와 교사가 공동으로 생성한 하이브리드 형태의 피드백을 가장 긍정적으로 수용하는 것으로 나타났다[10]. 이는 피드백의 내용뿐만 아니라 피드백 제공 주체에 대한 학습자의 인식이 피드백 수용 과정에 중요한 영향을 미친다는 점을 시사한다.

생성형 AI 기술을 교육 현장에 성공적으로 적용하기 위해서는 단순한 기술적 성능 향상에 의존하기보다, 명확한 교육이론적 프레임워크가 필요함을 보여준다. AI가 교육적으로 타당하고 신뢰성 있는 피드백을 생성하기 위해서는, 교육 목표와 정렬된 체계적 설계와 관리가 필수적이다.

이에 본 연구는 이러한 한계를 극복하고자 형성적 피드백 프레임워크를 기반하여 생성형 AI의 프롬프트 설계 과정에 직접 적용하였다. 이를 통해 AI가 단순한 언어 생성 도구를 넘어, 교육적으로 의미 있고 학습 촉진에 기여하는 형성적 피드백을 제공할 수 있는지를 실증적으로 검증하고자 한다.

3. 연구 설계

3.1 연구 설계 개요

본 연구는 형성적 피드백 프레임워크를 생성형 AI의 피드백 생성 과정에 적용하여, AI 기반 피드백이 학습자의 비판적 글쓰기 능력 향상에 미치는 교육적 효과와 타당성을 탐색하고자 하였다.

이를 위해 이론 기반 설계의 적용과 검증을 중심으로 한 설계기반 연구(DBR: Design-Based Research) 방법을 적용하였다. 설계기반 연구는 실제 교육 현장에서 발생하는 문제를 해결하기 위해 이론적 근거에 기반한 교육적 설계를 개발·적용하고, 그 실행 과정을 반복적으로 검토·개선하며 실천적 지식과 설계 원리를 도출하는 것을 목적으로 한다[25-27].

본 연구에서는 설계와 실행의 순환적 과정 중 단일 주기(single cycle)를 중심으로 진행하여, 형성적 피드백 프레임워크가 생성형 AI 기반 피드백 설계에 어떻게 적용될 수 있는지를 검증하고, 그 교육적 타당성을 확인하고자 하였다.

3.2 연구 절차 및 대상

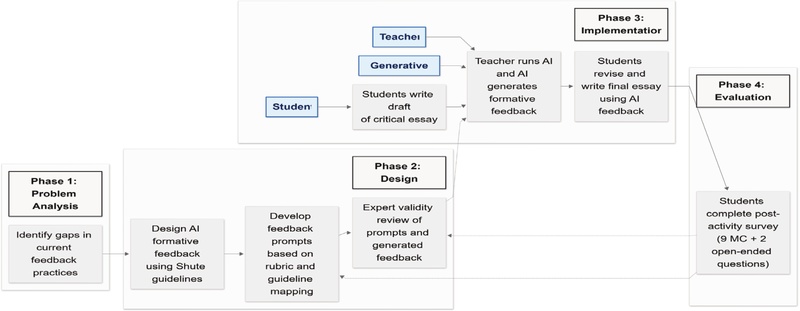

본 연구의 절차는 Reeves의 DBR 모형을 기반으로 Fig. 1 흐름처럼 문제분석, 설계 및 개발, 실행, 평가 및 검증의 네 단계로 구성되었다[27].

문제분석(problem pnalysis) 단계에서는 정보 문화 단원에서의 비판적 글쓰기에 대한 피드백 한계를 분석하고, AI 기반 형성적 피드백 시스템의 필요성을 도출하였다.

설계 및 개발(design and development) 단계에서는 형성적 피드백 프레임워크에 따라 평가 루브릭과 지침을 바탕으로 AI 피드백 프롬프트를 설계하였다.

실행(implementation) 단계에서는 실제 수업 상황에 시스템을 적용하고, 학생들이 AI 피드백을 활용해 글쓰기를 수정하도록 하였다.

평가 및 검증(evaluation and validation) 단계에서는 전문가 검토를 통해 내용 타당도를 검증하고, 학생 설문을 통해 피드백의 인식과 효용성을 분석하였다.

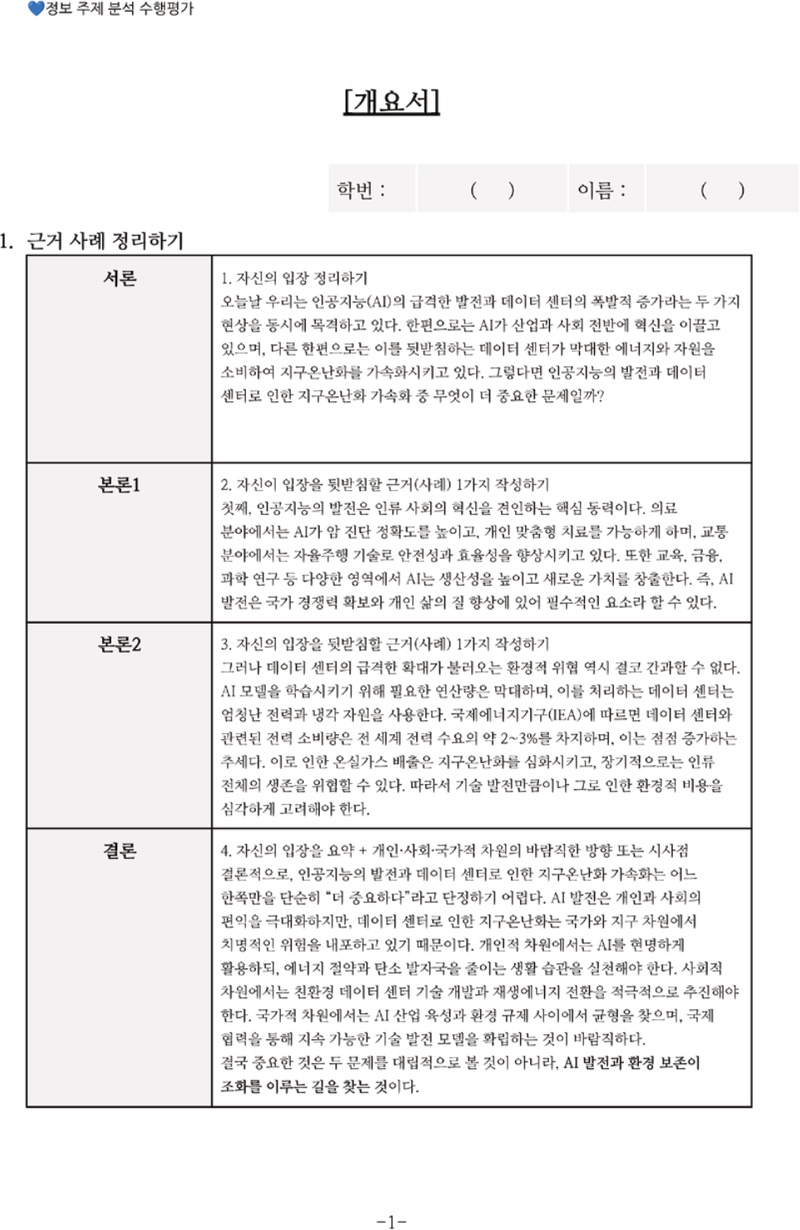

본 연구는 2025년 8월 7일부터 2025년 9월 24일까지 약 8주간 진행되었으며, 대상은 수도권 소재 A 고등학교 2학년에 재학 중인 학생 104명으로 남학생 50명, 여학생 54명으로 구성된다. 본 연구에 적용되는 과목은 고등학교 정보의 ‘정보문화’ 단원에서 실시한 비판적 글쓰기를 대상으로 한다. 과제 수행 과정에서 본 연구에서 설계한 AI 피드백을 제공받았다.

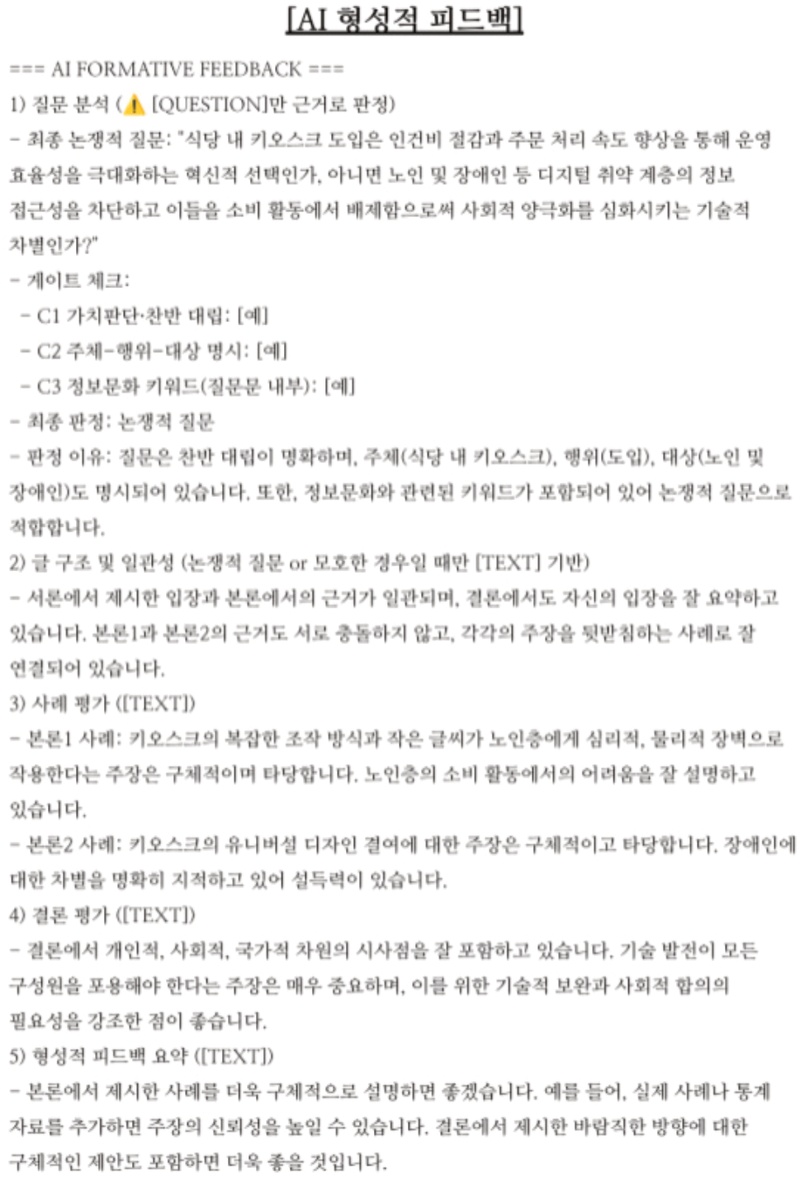

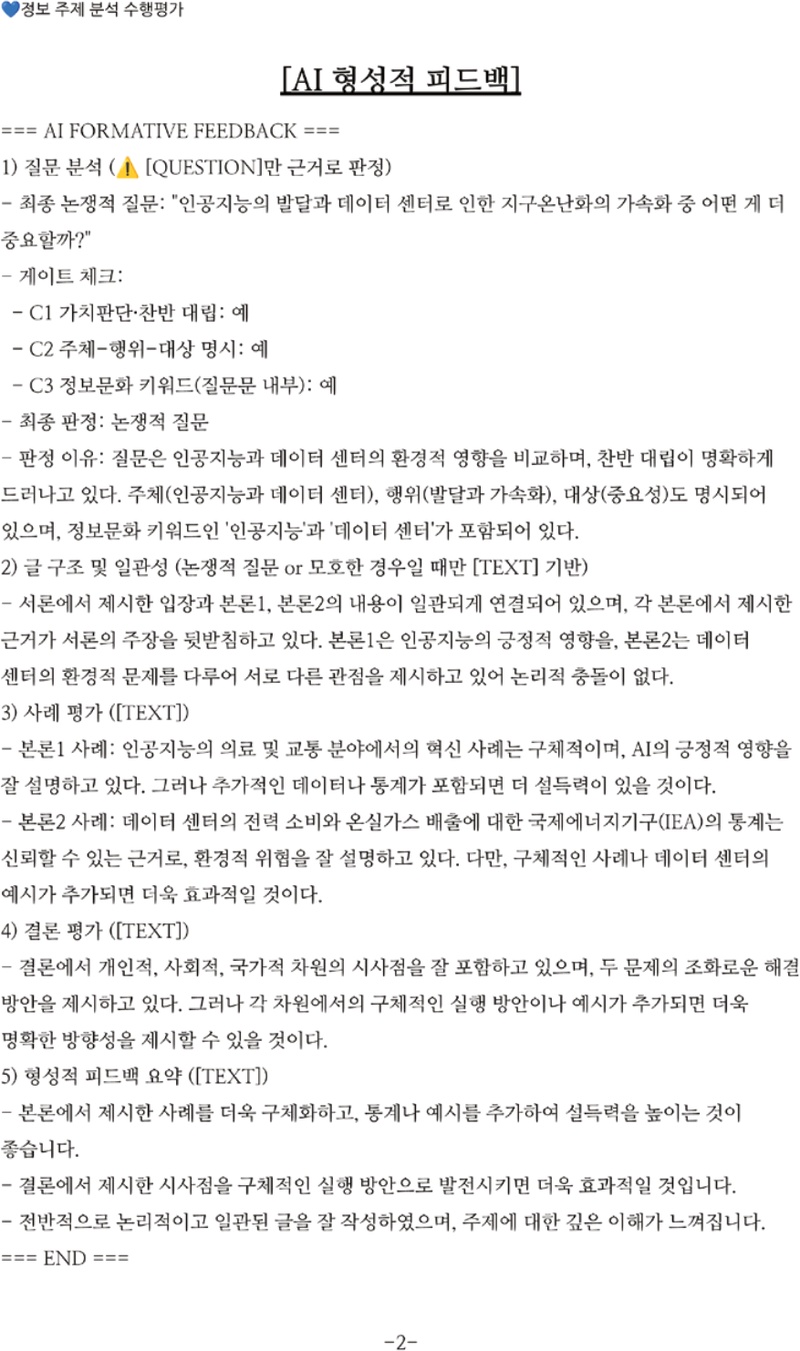

실험 처치는 정보문화 단원의 비판적 글쓰기를 주제로 총 3차시 동안 진행되었으며, 피드백의 즉시성을 확보하기 위해 OpenAI API와 연동된 자동화 도구가 활용되었다. 구체적으로 학생들이 문서 도구에 초안을 제출하면, 시스템이 이를 실시간으로 분석하여 개별 맞춤형 피드백을 전송하고, 학생들은 이를 바탕으로 수정 후 글을 재작성하는 절차를 따랐다.

4. 연구결과

본 연구는 AI 피드백을 설계하고, 결과 분석을 위해 전문가를 대상으로 타당도를 검토 후 학생 대상 인식을 조사하였다.

4.1 형성적 피드백 프레임워크 기반 AI 피드백 시스템 설계

본 연구의 핵심 도구인 AI 피드백 시스템은 생성형 AI 모델인 GPT-4o-mini를 기반으로 구축하였다. 연구의 실험 환경은 학생들이 문서 도구를 활용해 과제를 작성하고, 작성 완료 직후 API 호출을 통해 즉각적인 피드백을 제공받는 형태로 설계되었다. 당시 활용 가능한 모델 후보군(GPT-4o, GPT-4o-mini, GPT-4.5)을 비교 분석한 결과, 제한된 수업 시간 내에 다수 학생의 피드백을 제공하는 상황에서 고성능 모델은 응답 지연 및 높은 비용 문제로 인해 공교육 현장의 지속 가능한 적용에 한계가 있었다. 이에 따라 비판적 글쓰기 피드백에 필요한 논리적 정합성 판단 능력을 갖추면서도, 빠른 처리 속도와 비용 효율성을 보장하는 GPT-4o-mini를 최종 모델로 선정하였다.

선행 연구 분석 결과, 범용적인 생성형 AI 피드백은 문법적 정확성에 치중하거나, 피드백 내용이 모호하여 학습자의 실질적인 수정을 이끌어내지 못한다는 한계가 지적되었다. 이에 본 연구는 피드백 생성 프롬프트를 형성적 피드백 프레임워크에 따라 설계하였다. 이는 AI가 교육 이론적 프레임워크 내에서 작동하도록 통제하기 위함이며, 구체적인 설계 원칙 및 프롬프트 명령어는 Table 2와 같다. 기존 연구의 한계와 본 연구의 해결 방안을 비교하면 Table 3과 같다.

4.2 전문가 타당도 검토

AI 피드백 시스템의 교육적 타당성을 검증하기 위해 정보 교과 교육 경력을 가진 현직 교사 총 8명의 교육 전문가 집단을 구성하였다. AI 피드백의 교육적 타당성은 Lawshe의 내용 타당도 비율(Content Validity Ratio, CVR)을 통해 검증하였다[28]. 전문가 8명을 대상으로 Table 4와 같이 AI 피드백이 ‘루브릭 연계성’, ‘구체성’, ‘정교화 수준’ 등 7개 항목에 대해 '필수적'인지 응답하도록 하였다. CVR 값과 함께 기술 통계(평균, 표준편차)를 분석하였다.

CVR은 ‘필수적’이라고 응답한 전문가의 수(Ne)를 전체 전문가 수(N)로 계산하며, 본 연구(N=8)의 CVR 최솟값은 .75이다.

분석 결과, Table 5와 같이 8개의 모든 평가 문항에서 CVR 값이 .75 또는 1.00으로 나타나 Lawshe의 기준치를 충족시켰다. 이는 본 연구에서 설계한 AI 피드백 시스템이 내용 타당도 측면에서 ‘교육적으로 타당하다’는 전문가들의 합의가 이루어졌음을 의미한다.

CVR 분석과 더불어, 7개 핵심 문항(5점 척도)에 대한 전문가 인식의 기술 통계 분석을 실시하였다. 분석 결과, 모든 문항의 평균이 4.38점 이상으로 전반적으로 높게 나타났다. 특히 ‘구체성 및 명확성’ (M=4.75)과 ‘객관성 및 신뢰성’ (M=4.75) 항목이 높은 평가를 받았다. 이는 AI 피드백이 교사의 주관적 편향을 배제하고, 학생들이 명확하게 개선점을 파악할 수 있도록 구체적인 정보를 제공한다는 형성적 피드백 프레임워크를 성공적으로 구현했음을 시사한다.

‘루브릭 연계성’(M=4.38), ‘정교화 수준’(M=4.63), ‘학습 목표 지향성’(M=4.63) 등 다른 모든 항목에서도 높은 점수를 획득하여, 본 AI 피드백이 교육 이론에 기반하여 교육적 타당성을 확보했음을 실증적으로 확인하였다.

4.3 학생 인식 분석

학생 인식 설문도구는 박민애와 손원숙이 개발한 피드백 리터러시 척도의 하위요인인 피드백 활용능력 문항을 참고하여 본 연구의 목적에 맞게 수정한 5점 Likert 척도 문항지를 활용하여 Table 6과 같이 이루어졌다[29].

학생 인식 설문 도구는 ‘피드백의 구체성’, ‘수정 방향의 명확성’, ‘간결성(이해 용이성)’ 등 총 9개 문항으로 구성하였다. 수집된 데이터(N=104)는 SPSS 26.0을 활용하여 기술통계(평균, 표준편차, 빈도) 및 설문 도구의 내적 일관성을 확인하기 위한 신뢰도 분석(Cronbach's α)을 실시하였다. 분석 결과, Cronbach's α값은 .880으로 나타나 본 설문 도구의 신뢰도를 확인하였다 (기준치 α≥ .80).

AI 피드백의 교육적 효과에 대한 학생 인식 설문(5점 척도)의 기술 통계 결과는 Table 7과 같다. 전체 9개 문항의 평균은 3.83점에서 4.11점 사이에 분포하여, 학생들이 AI 피드백의 효과를 전반적으로 긍정적으로 인식하고 있음을 보여주었다.

가장 높게 나타난 항목은 ‘피드백의 간결성(이해 용이성)’(M=4.11)이었으며, 이는‘관리 가능한 단위(manageable units)’의 피드백이 학생들의 인지적 부담을 줄이는 데 효과적이었음을 시사한다. 또한 ‘피드백의 구체성’(M=4.03), ‘정보의 양’(M=4.06), ‘학습 과정 집중’(M=4.00) 등의 항목도 평균 4.0점 이상으로 높게 나타났다. ‘수정 방향의 명확성’(M=3.96) 항목 역시 4.0점에 근접한 평균을 보였다. ‘피드백의 구체성’ 문항의 빈도 분석 결과, 학생의 55.8%가 ‘4점’, 24.0%가 ‘5점’으로 응답하여 전체 응답자의 79.8%가 AI 피드백이 구체적이라고 인식하고 있었다. ‘수정 방향의 명확성’ 역시 46.2%가 ‘4점’, 26.0%가 ‘5점’으로 응답하여, 72.2%의 학생이 과제 개선 방향을 이해하는 데 긍정적인 도움을 받았다고 응답하였다.

개방형 응답 데이터는 Braun과 Clarke가 제안한 주제 분석 절차에 따라 분석되었다[30]. 1단계로 전체 응답을 반복적으로 읽으며 초기 코드를 생성하고, 2단계로 유사한 코드를 묶어 잠재적 주제를 도출하였다. 3단계에서는 도출된 주제가 피드백 프레임워크와 정합성을 가지는지 검토하여 최종적으로 ‘인지적 명확성’, ‘메타인지 지원’, ‘정의적 지원’의 3가지 핵심 주제로 범주화하였다. AI 피드백의 긍정적 요인과 개선 제언을 분석한 결과, Table 8과 같이 핵심 주제를 도출하였다. 학생들은 AI 피드백이 논술형 과제 수행에 있어 ‘무엇을’,‘어떻게’ 개선해야 하는지에 대한 명확한 방향성을 제공했다는 점을 가장 긍정적으로 평가했다. AI 피드백은 학생이 자신의 글을 한발 물러서서 객관적으로 바라보고, 글의 전체적인 구조를 파악하도록 돕는 메타인지적 도구로 작용하였다. 다수의 학생들은 AI 피드백이 글의 부족한 점을 구체적으로 지적하고, 수정 방향을 명확히 제시해주는 점을 가장 큰 장점으로 인식하였다. 또한 일부 학생들은 AI 피드백이 비판에 대한 부담감을 줄이고, 칭찬과 명료한 안내를 통해 심리적 안정감을 제공한다고 응답하였다. 이는 Barrows 등이 언급한 ‘심리적 안정감’과 일치하는 결과이다[31]. 그러나 소수의 학생은 AI 피드백의 표현이 다소 기계적이거나 이해가 어려웠다고 언급하여, 정의적 측면에서의 한계도 보여주었다.

학생들은 AI 피드백의 유용성을 인정하면서도, 다음 DBR 2주기(cycle 2)의 재설계(redesign)를 위한 핵심 개선점들을 제안하였다. 가장 중요한 개선점으로, AI가 학생의 의도를 정확히 파악하지 못하는 ‘문맥 파악의 한계’를 지적했다. 피드백이 다소 추상적이고 형식적이며, 더 구체적인 대안이나 예시를 요구했다. 양적 분석에서 ‘간결성’(M=4.11)을 높게 평가했음에도 불구하고, 일부 학생은 “글이 너무 길거나 복잡하다”고 응답하여 정보 전달 방식의 개선을 요구했다. 또한 AI의 단호한 어조에 정서적 상처를 받은 학생도 있었다.

4.4 AI 피드백의 한계 및 오류 유형 분석

생성형 AI는 즉각적인 피드백을 제공한다는 장점에도 불구하고, 정보문화 단원 연계 글쓰기라는 특수한 교육적 맥락에서 교과 내용 지식의 적용과 스캐폴딩 제공에 명확한 한계를 드러냈다. 가장 두드러진 문제는 문맥 파악의 오류이다. 학생이 의도적으로 비유적 표현을 사용했음에도 AI가 이를 논리적 비약으로 오인하여 수정을 지시하는 사례가 발견되었다.

또한, 피드백의 질적 측면에서도 구체성과 정 마지막으로, 어조의 경직성이다. 일부 학생들은 AI의 “틀렸다”, “삭제하라”와 같은 단호한 표현에서 심리적 위축감을 느꼈다고 보고하였다. 이러한 오류 분석 결과는 2주기(cycle 2) 설계 시 프롬프트의 ‘톤&매너’조정과 ‘예시 생성(few-shot)’기능 강화에 반영될 필요가 있다.

5. 결론

본 연구는 Shute의 이론적 프레임워크가 생성형 AI 기반 피드백 시스템 설계의 교육적 타당성과 학습자의 인식 변화를 중심으로 탐색하였다. 연구 결과, 전문가들은 본 연구에서 형성적 피드백 프레임워크인 구체성, 정교화, 객관성 등에 기반하여 설계한 AI 피드백이 교육적으로 매우 높은 타당성(CVR ≥.75)을 지닌다고 평가했다. 이는 AI 피드백이 기술적 성능을 넘어 교육학적 기준을 충족할 수 있음을 시사한다. 따라서 본 연구의 결과는 학습 개선을 가능하게 하는 조건과 질적 특성의 검증으로 해석하였다.

또한, 학생 인식 분석 결과, 학생들은 AI 피드백의 ‘구체성’(M=4.03), ‘간결성’(M=4.11) 등을 높게 평가했다. 이는 ‘구체적이고(specific)’, ‘관리 가능한 단위(manageable units)’의 피드백이 학생들의 인지적 부담을 줄이고 명확한 개선 방향을 제시하는 데 효과적이었음을 보여준다.

특히 질적 분석에서 도출된 ‘인지적 명확성’과 ‘정의적 지원(심리적 안정감)’이라는 핵심 주제는 주목할 만하다. 학생들은 AI 피드백을 통해 교사 피드백의 심리적 부담 없이 객관적으로 자신의 약점을 진단받는 경험을 긍정적으로 인식했다[30].

본 연구의 DBR 1주기(cycle 1)를 통해 도출된 핵심 결론은, 생성형 AI 피드백의 교육적 효과가 AI 모델 자체의 성능이 아닌, ‘교육 이론에 기반한 정교한 설계’에 결정된다는 점이다. 형성적 피드백 설계 원리는 AI가 단순한 문법 교정기 수준을 넘어, 학생의 인지적 명확성과 정의적 안정감을 지원하는 교육적 보조 도구로서 기능하게 하는 핵심 설계 원리로 작용하였다.

그러나 본 연구는 DBR의 순환적 연구 설계관점에서 1주기 실행에 한정되었다는 점에서 한계가 있다. 이후 연구에서는 2주기(cycle 2) 이상으로 확장하여, 개선된 피드백 시스템이 학습자의 비판적 글쓰기 성취도 향상에 실제로 미치는 효과를 종단적으로 검증할 필요가 있다.

또한, AI 모델의 버전(GPT-4, GPT-4o-mini, GPT-5 등)에 따라 피드백의 품질이 달라질 수 있다는 점 역시 본 연구의 제약 요인이다. 향후 연구에서는 모델의 발전에 따른 언어 생성 품질 및 피드백 정교화 수준의 변화를 체계적으로 비교 분석할 필요가 있다.

더불어 본 연구는 비교군을 설정하지 않은 단일 집단 설계로 인해, 학생 인식 변화가 일반적으로 AI 피드백 효과인지, 형성적 피드백 프레임워크 설계에 따른 결과인지를 엄밀히 구분하는 데에는 한계가 있다. 이에 따라 후속 연구에서는 비교 집단을 포함한 설계를 통해 프레임워크의 상대적 효과를 검증할 필요가 있다.

마지막으로, 동일한 프롬프트를 사용하더라도 학습자의 글쓰기 내용이나 표현 방식에 따라 피드백 결과가 달라질 수 있는 변동성이 존재한다. 이는 AI 피드백 시스템의 자동화된 특성에 기인한 불가피한 한계로, 향후 연구에서는 텍스트 맥락에 따른 피드백 편차를 최소화할 수 있는 조건 기반 프롬프트 설계나, 교사-AI 협력형 피드백 체계의 보완적 결합이 필요하다.

종합하면, 본 연구는 AI 기반 피드백이 단순한 기술적 도구가 아닌 교육적 설계 기반의 인지·정의적 학습 지원 도구로 발전할 수 있음을 실증적으로 제시하였으며, 향후 주기적 설계 개선과 AI 기술의 발전을 통합적으로 고려한 지속 가능한 AI 피드백 설계 모델의 구축이 필요함을 시사한다.

References

- Ministry of Education. (2022). 2022 Revised National Curriculum: General Guidelines. Ministry of Education, Republic of Korea.

- Lee, E., & Lee, Y. (2011). A plan for information and communication ethics education through argumentative writing. Proceedings of the Korean Association of Computer Education Conference, 15(2), 195–198.

-

Emig, J. (1977). Writing as a mode of learning. College Composition and Communication, 28(2), 122–128.

[https://doi.org/10.58680/ccc197716382]

-

Sadler, D. (1989). Formative assessment and the design of instructional systems. Instructional Science, 18(2), 119–144.

[https://doi.org/10.1007/BF00117714]

-

Hattie, J., & Timperley, H. (2007). The power of feedback. Review of Educational Research, 77(1), 81–112.

[https://doi.org/10.3102/003465430298487]

-

Sutcher, L., Darling-Hammond, L., & Carver-Thomas, D. (2019). Understanding teacher shortages: An analysis of teacher supply and demand in the United States. Education Policy Analysis Archives, 27, 35.

[https://doi.org/10.14507/epaa.27.3696]

- Hanushek, E., Peterson, P., Talpey, L., & Woessmann, L. (2019). The Achievement Gap Fails to Close: Half Century of Testing Shows Persistent Divide between Haves and Have-Nots. Education Next, 19, 8-17.

-

Sim, H., & Park, I. (2025). A meta-analysis of learning effects using generative AI feedback. Journal of Educational Informatics and Media, 31(2), 567–595.

[https://doi.org/10.15833/KAFEIAM.31.2.567]

-

Bubeck, S., Chandrasekaran, V., Eldan, R., Gehrke, J., Horvitz, E., Kamar, E., Lee, P., Lee, Y., Lundberg, S., Nori, H., Palangi, H., Ribeiro, M., & Zhang, Y. (2023). Sparks of artificial general intelligence: Early experiments with GPT-4. arXiv.

[https://doi.org/10.48550/arXiv.2303.12712]

-

Barrot, J. (2020). Integrating Technology into ESL/EFL Writing through Grammarly. RELC Journal, 53(3), 764-768.

[https://doi.org/10.1177/0033688220966632]

- Kakarla, S., Thomas, D., Lin, J., Gupta, S., & Koedinger, K. (2024). Using Large Language Models to Assess Tutors' Performance in Reacting to Students Making Math Errors. ArXiv, abs/2401.03238, . arXiv.

-

Escalante, J., Pack, A. & Barrett, A. AI-generated feedback on writing: insights into efficacy and ENL student preference. International Journal of Educational Technology in Higher Education 20, 57 (2023).

[https://doi.org/10.1186/s41239-023-00425-2]

-

Xu, X., Sun, F., & Hu, W. (2025). Integrating human expertise with GenAI: Insights into a collaborative feedback approach in translation education. System, 129, 103600.

[https://doi.org/10.1016/j.system.2025.103600]

-

Nguyen-Trung, K., Saeri, A., & Kaufman, S. (2024). Applying ChatGPT and AI-powered tools to accelerate evidence reviews. Human Behavior and Emerging Technologies, 2024(1), 8815424.

[https://doi.org/10.1155/2024/8815424]

-

Cavalcanti, A., Barbosa, A., Carvalho, R., Freitas, F., Tsai, Y., Gašević, D., & Mello, R. (2021). Automatic feedback in online learning environments: A systematic literature review. Computers and Education: Artificial Intelligence, 2, 100027.

[https://doi.org/10.1016/j.caeai.2021.100027]

-

Shute, V. (2008). Focus on formative feedback. Review of Educational Research, 78(1), 153-189.

[https://doi.org/10.3102/0034654307313795]

-

Black, P., & Wiliam, D. (1998). Assessment and classroom learning. Assessment in Education: Principles, Policy & Practice, 5(1), 7–74.

[https://doi.org/10.1080/0969595980050102]

-

Chan, S., Lo, N., & Wong, A. (2024). Leveraging generative AI for enhancing university-level English writing: comparative insights on automated feedback and student engagement. Cogent Education, 12(1).

[https://doi.org/10.1080/2331186x.2024.2440182]

-

Guo, S., Latif, E., Zhou, Y., Huang, X., & Zhai, X. (2024). Using generative AI and multi-agents to provide automatic feedback. arXiv preprint arXiv:2411.07407, .

[https://doi.org/10.48550/arXiv.2411.07407]

-

Zhang, Z., Dong, Z., Shi, Y., Price, T., Matsuda, N., & Xu, D. (2024). Students’ perceptions and preferences of generative artificial intelligence feedback for programming. In Proceedings of the Thirty-Eighth AAAI Conference on Artificial Intelligence.

[https://doi.org/10.1609/aaai.v38i21.30372]

-

Aggarwal, D., Sil, P., Raman, B., & Bhattacharyya, P. (2025). I understand why I got this grade : Automatic short answer grading (ASAG) with feedback. arXiv. https://arxiv.org/abs/2407.12818

[https://doi.org/10.1007/978-3-031-98420-4_22]

-

Jacobsen, L., & Weber, K. (2023). The Promises and Pitfalls of ChatGPT as a Feedback Provider in Higher Education: An Exploratory Study of Prompt Engineering and the Quality of AI-Driven Feedback.

[https://doi.org/10.31219/osf.io/cr257]

-

nsen, T., Höft, L., Bahr, L., Fleckenstein, J., Möller, J., Köller, O., & Meyer, J. (2024). Empirische Arbeit: Comparing Generative AI and Expert Feedback to Students’ Writing: Insights from Student Teachers. Psychologie in Erziehung Und Unterricht, 71(2), 80–92.

[https://doi.org/10.2378/peu2024.art08d]

-

Huesca, G., Elizondo-García, M., Aguayo-González, R., Aguayo-Hernández, C., González-Buenrostro, T., & Verdugo-Jasso, Y. (2025). Evaluating the Potential of Generative Artificial Intelligence to Innovate Feedback Processes. Education Sciences, 15(4), 505.

[https://doi.org/10.3390/educsci15040505]

-

Brown, A. (1992). Design experiments: Theoretical and methodological challenges in creating complex interventions in classroom settings. The Journal of the Learning Sciences, 2(2), 141–178.

[https://doi.org/10.1207/s15327809jls0202_2]

-

Collins, A. (1992). Toward a design science of education. In E. Scanlon & T. O’Shea (Eds.), New directions in educational technology. 15–22.

[https://doi.org/10.1007/978-3-642-77750-9_2]

- Reeves, T. (2006). Design research from a technology perspective. In J. van den Akker, K. Gravemeijer, S. McKenney, & N. Nieveen (Eds.), Educational design research. 52–66.

-

Lawshe, C. (1975). A quantitative approach to content validity. Personnel Psychology, 28(4), 563-575.

[https://doi.org/10.1111/j.1744-6570.1975.tb01393.x]

-

Park, M., & Sohn, W. (2019). Development and Validation of Feedback Literacy Scale for Students. Journal of Educational Evaluation, 32(3), 473-495. 10.31158/JEEV.2019.32.3.473

[https://doi.org/10.31158/JEEV.2019.32.3.473]

-

Braun, V., & Clarke, V. (2006). Using thematic analysis in psychology. Qualitative Research in Psychology, 3(2), 77–101.

[https://doi.org/10.1191/1478088706qp063oa]

- Barrows, E., Green, E., & Moore, S. (2023). Psychological safety and student engagement in AI-assisted learning environments. Journal of Educational Technology & Society, 26(2), 112-128.

부 록

본 논문을 준비하는 동안 저자는 언어 개선 및 기본 편집을 위해 Chat GPT 5.2, Gemini 3.0을 사용했습니다. 본 도구를 사용한 후, 저자는 필요에 따라 내용을 검토하고 편집했으며, 게재된 논문의 내용에 대한 전적인 책임을 집니다.

· 2019년 한국교원대학교 컴퓨터교육과, 생물교육과(교육학사)

· 2023년 한국교원대학교 인공지능융합교육전공(교육학석사)

· 2025년~현재 한국교원대학교 컴퓨터교육과 박사과정

관심분야 : 컴퓨터교육학, 정보교과교육, 교육과정 평가

alicepark96@gmail.com

· 2005년 한국교원대학교 컴퓨터교육전공 (교육학박사)

· 2006년~ 021년 서원대학교 컴퓨터교육과 교수

· 2021년~현재 한국교원대학교 컴퓨터교육과 교수

· 2021년~현재 한국교원대학교 정보교육연구소 소장

관심분야 : 컴퓨터교육학, 정보교과교육, 인공지능 교육 등

chj@knue.ac.kr